Écrit par 0xjacobzhao | https://linktr.ee/0xjacobzhao

Dans notre rapport de juin « Le Saint Graal de l'IA Crypto : Exploration de la Formation Décentralisée », nous avons discuté de l'apprentissage fédéré—un paradigme de « décentralisation contrôlée » situé entre l'apprentissage distribué et l'apprentissage entièrement décentralisé. Son principe fondamental est de garder les données locales tout en agrégeant les paramètres de manière centrale, un design particulièrement adapté aux industries sensibles à la vie privée et aux lourdes exigences de conformité telles que la santé et la finance.

En même temps, nos recherches passées ont constamment souligné l'essor des réseaux d'agents. Leur valeur réside dans leur capacité à permettre l'accomplissement de tâches complexes par la coopération autonome et la division du travail entre plusieurs agents, accélérant le passage de « grands modèles monolithiques » à « des écosystèmes multi-agents ».

L'apprentissage fédéré, avec ses fondations de rétention de données locales, d'incitations basées sur les contributions, de conception distribuée, de récompenses transparentes, de protection de la vie privée et de conformité réglementaire, a établi des bases importantes pour la collaboration multipartite. Ces mêmes principes peuvent être directement adaptés au développement de réseaux d'agents. L'équipe de FedML a suivi cette trajectoire: évoluant des racines open-source à TensorOpera (une couche d'infrastructure IA pour l'industrie), et avançant encore vers ChainOpera (un réseau d'agents décentralisé).

Cela dit, les réseaux d'agents ne sont pas simplement une extension inévitable de l'apprentissage fédéré. Leur essence réside dans la collaboration autonome et la spécialisation des tâches entre les agents, et ils peuvent également être construits directement sur des systèmes multi-agents (MAS), l'apprentissage par renforcement (RL), ou des mécanismes d'incitation basés sur la blockchain.

I. Apprentissage fédéré et la pile technologique des agents IA

L'apprentissage fédéré (FL) est un cadre pour l'entraînement collaboratif sans centraliser les données. Son principe fondamental est que chaque participant entraîne un modèle localement et télécharge uniquement des paramètres ou des gradients sur un serveur de coordination pour agrégation, garantissant ainsi que « les données restent dans son domaine » et respectant les exigences de confidentialité et de conformité.

Ayant été testé dans des secteurs tels que la santé, la finance et les applications mobiles, l'FL est entré dans une phase relativement mature de commercialisation. Cependant, il fait encore face à des défis tels qu'une surcharge de communication élevée, des garanties de confidentialité incomplètes et des goulets d'étranglement d'efficacité causés par des dispositifs hétérogènes.

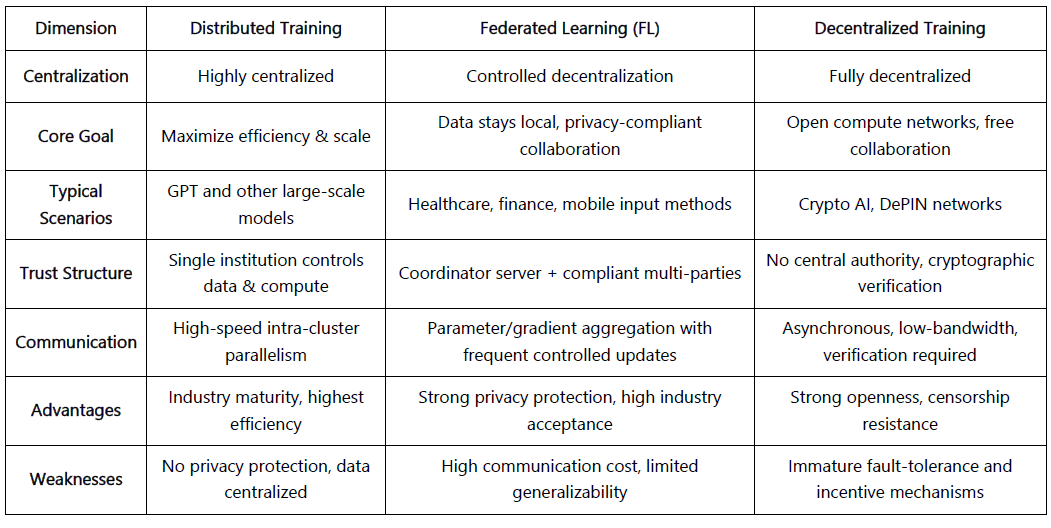

Comparé à d'autres paradigmes d'entraînement:

L'entraînement distribué met l'accent sur les clusters de calcul centralisés pour maximiser l'efficacité et l'échelle.

L'entraînement décentralisé permet une collaboration entièrement distribuée via des réseaux de calcul ouverts.

L'apprentissage fédéré se situe entre les deux, fonctionnant comme une forme de « décentralisation contrôlée »: il répond aux exigences industrielles en matière de confidentialité et de conformité tout en permettant la collaboration inter-institutionnelle, le rendant plus adapté en tant qu'architecture de déploiement transitoire.

Empilement de protocoles d'agents IA

Dans nos recherches précédentes, nous avons catégorisé la pile de protocoles des agents IA en trois couches majeures:

1. Couche d'infrastructure (Couche d'infrastructure des agents)

Le support d'exécution fondamental pour les agents, servant de base technique à tous les systèmes d'agents.

Modules principaux:

Cadre des agents – environnement de développement et d'exécution pour les agents.

OS des agents – planification multitâche à un niveau plus profond et exécution modulaire, fournissant une gestion du cycle de vie pour les agents.

Modules de soutien:

DID d'agent (identité décentralisée)

Portefeuille d'agent & Abstraction (abstraction de compte & exécution de transaction)

Paiement/Règlement d'agent (capacités de paiement et de règlement)

2. Couche de coordination & d'exécution

Se concentre sur la collaboration des agents, la planification des tâches et les systèmes d'incitation—élément clé pour construire l'intelligence collective parmi les agents.

Orchestration des agents: orchestration centralisée et gestion du cycle de vie, allocation des tâches et exécution des flux de travail—adaptée aux environnements contrôlés.

Essaim d'agents: structure de collaboration distribuée mettant l'accent sur l'autonomie, la division du travail et la coordination résiliente—adaptée aux environnements complexes et dynamiques.

Couche d'incitation des agents: Couche économique du réseau d'agents qui incite les développeurs, les exécuteurs et les validateurs, assurant une croissance durable de l'écosystème.

3. Couche d'application & de distribution

Couvre les canaux de distribution, les applications utilisateur final, et les produits orientés consommateur.

Sous-couche de distribution: Lancements d'agents, Marchés d'agents, Réseaux de plugins d'agents

Sous-couche d'application: AgentFi, DApps natifs d'agents, Agent-en-tant-que-Service

Sous-couche consommateur: Agents sociaux/consommateurs, axés sur des scénarios légers pour les utilisateurs finaux

Sous-couche de mèmes: Projets « Agent » motivés par le battage médiatique avec peu de technologie ou d'application réelle—principalement motivés par le marketing.

II. Évaluation de l'apprentissage fédéré: FedML et la plateforme full-stack TensorOpera

FedML est l'un des premiers cadres open-source pour l'apprentissage fédéré (FL) et l'entraînement distribué. Originaire d'une équipe académique de l'USC, il a progressivement évolué vers le produit central de TensorOpera AI grâce à la commercialisation.

Pour les chercheurs et les développeurs, FedML fournit des outils inter-institutionnels et inter-appareils pour l'entraînement de données collaboratives. Dans le milieu académique, FedML est devenu une plateforme expérimentale largement adoptée pour la recherche FL, apparaissant fréquemment lors des meilleures conférences telles que NeurIPS, ICML, et AAAI. Dans l'industrie, il a acquis une forte réputation dans des domaines sensibles à la vie privée tels que la santé, la finance, l'IA de périphérie et l'IA Web3—se positionnant comme l'outil de référence pour l'apprentissage fédéré.

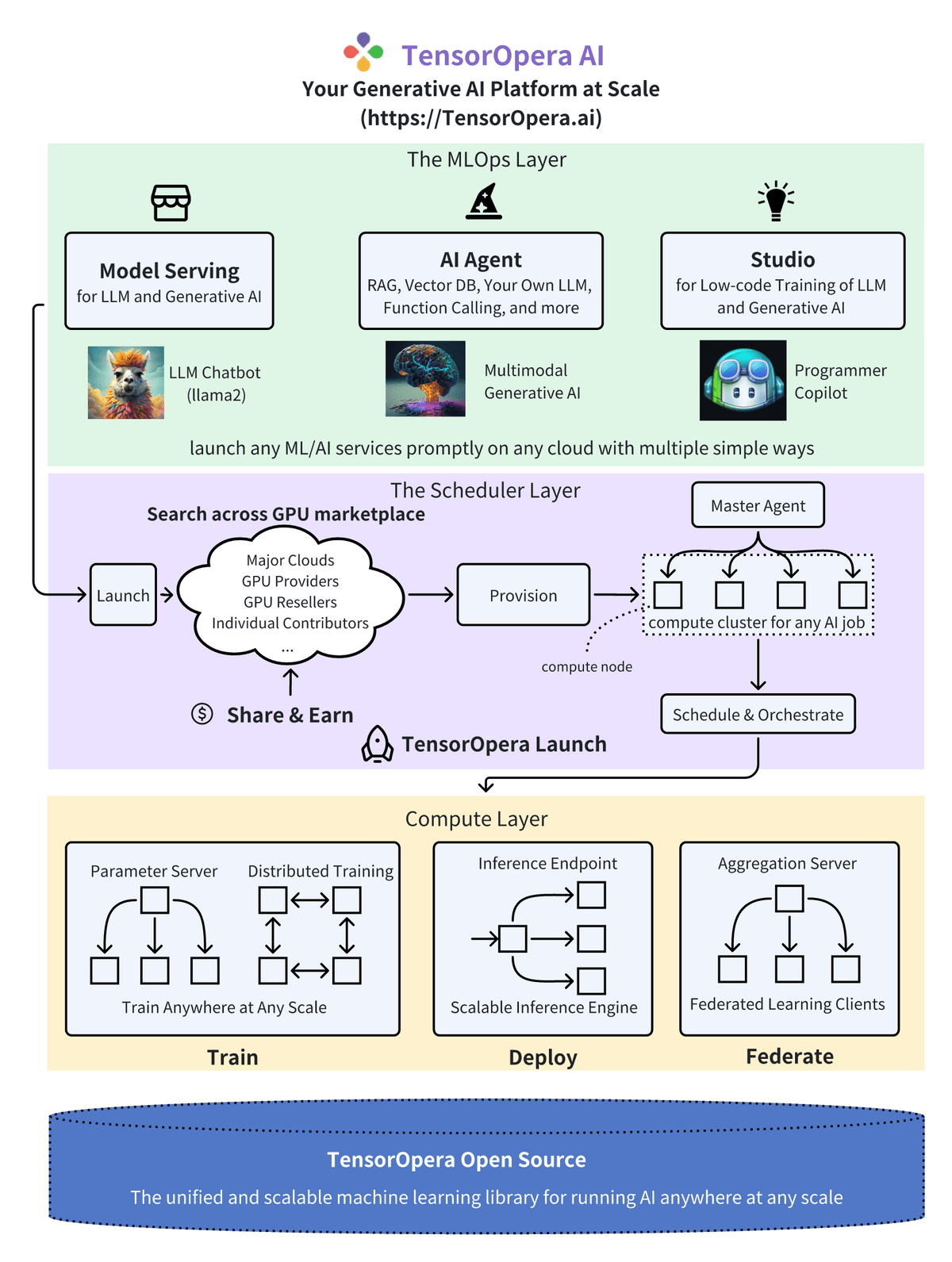

TensorOpera représente l'évolution commercialisée de FedML, mise à jour en une plateforme d'infrastructure IA full-stack pour les entreprises et les développeurs. Tout en conservant ses capacités d'apprentissage fédéré, elle s'étend aux marchés GPU, aux services de modèles et aux MLOps, élargissant ainsi le marché plus large de l'ère LLM et des agents.

Son architecture globale est structurée en trois couches: Couche de calcul (fondation), Couche de planification (coordination) et Couche MLOps (application).

Couche de calcul (Fondation)

La couche de calcul forme l'épine dorsale technique de TensorOpera, poursuivant l'ADN open-source de FedML.Fonctions principales: Serveur de paramètres, Entraînement distribué, Point de terminaison d'inférence et Serveur d'agrégation.

Proposition de valeur: Fournit un entraînement distribué, un apprentissage fédéré préservant la vie privée, et un moteur d'inférence évolutif. Ensemble, ceux-ci soutiennent les trois capacités centrales de S'entraîner / Déployer / Fédérer, couvrant l'ensemble du pipeline de l'entraînement de modèles au déploiement et à la collaboration inter-institutionnelle.

Couche de planification (Coordination)

La couche de planification agit comme le marché de calcul et le hub de planification, composée des modules Marché GPU, Provision, Agent Maître et Planifier & Orchestrer.Capacités: Permet l'allocation de ressources à travers des clouds publics, des fournisseurs de GPU et des contributeurs indépendants.

Signification: Cela marque l'étape pivotale de FedML à TensorOpera—soutenant l'entraînement et l'inférence IA à grande échelle grâce à une planification intelligente et une orchestration, couvrant les charges de travail LLM et d'IA générative.

Potentiel de tokenisation: Le modèle « Partager & Gagner » laisse une interface de mécanisme d'incitation ouverte, montrant sa compatibilité avec DePIN ou des modèles Web3 plus larges.

Couche MLOps (Application)

La couche MLOps fournit des services directs pour les développeurs et les entreprises, y compris le service de modèles, les agents IA et les modules Studio.Applications: chatbots LLM, IA générative multimodale, et outils de copilote pour développeurs.

Proposition de valeur: abstrait les capacités de calcul et d'entraînement de bas niveau en APIs et produits de haut niveau, abaissant la barrière à l'utilisation. Elle offre des agents prêts à l'emploi, des environnements low-code et des solutions de déploiement évolutives.

Positionnement: Comparable aux nouvelles plateformes d'infrastructure IA de génération telles que Anyscale, Together et Modal—servant de pont entre l'infrastructure et les applications.

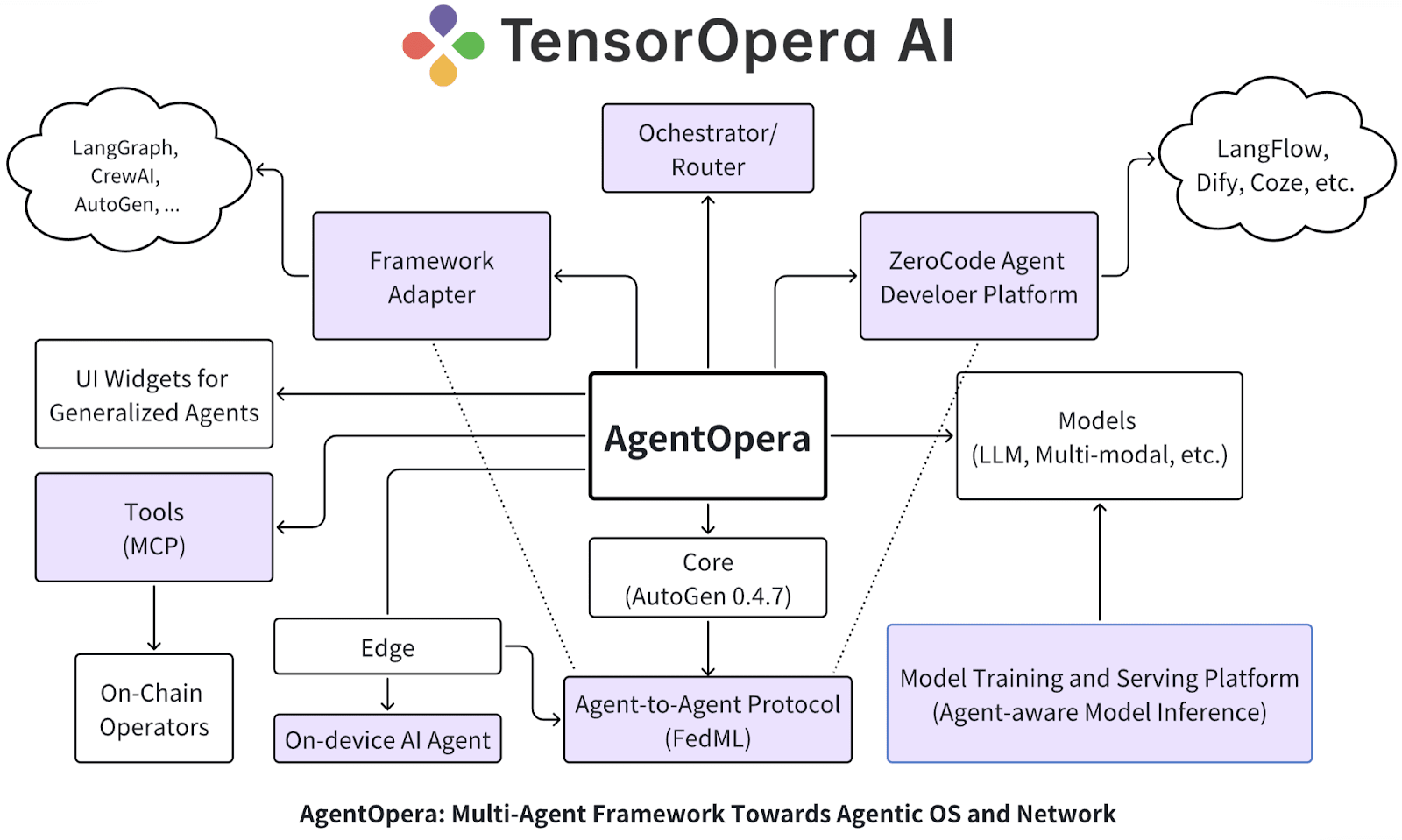

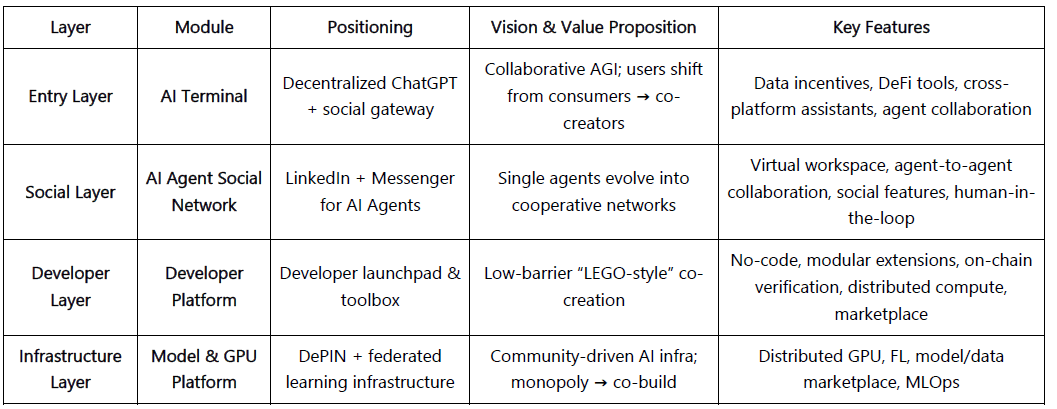

En mars 2025, TensorOpera a été mis à jour en une plateforme full-stack orientée vers les agents IA, avec ses produits principaux couvrant l'application AgentOpera IA, le cadre et la plateforme:

Couche d'application: Fournit des points d'entrée multi-agents similaires à ChatGPT.

Couche de cadre: Évolue en un « OS agentique » à travers des systèmes multi-agents structurés en graphes et des modules Orchestrateur/Routeur.

Couche de plateforme: S'intègre profondément avec la plateforme modèle TensorOpera et FedML, permettant des services de modèles distribués, l'optimisation RAG et le déploiement hybride edge–cloud.

La vision globale est de construire « un système d'exploitation, un réseau d'agents », permettant aux développeurs, entreprises et utilisateurs de co-créer le prochain écosystème Agentique IA de nouvelle génération dans un environnement ouvert et préservant la vie privée.

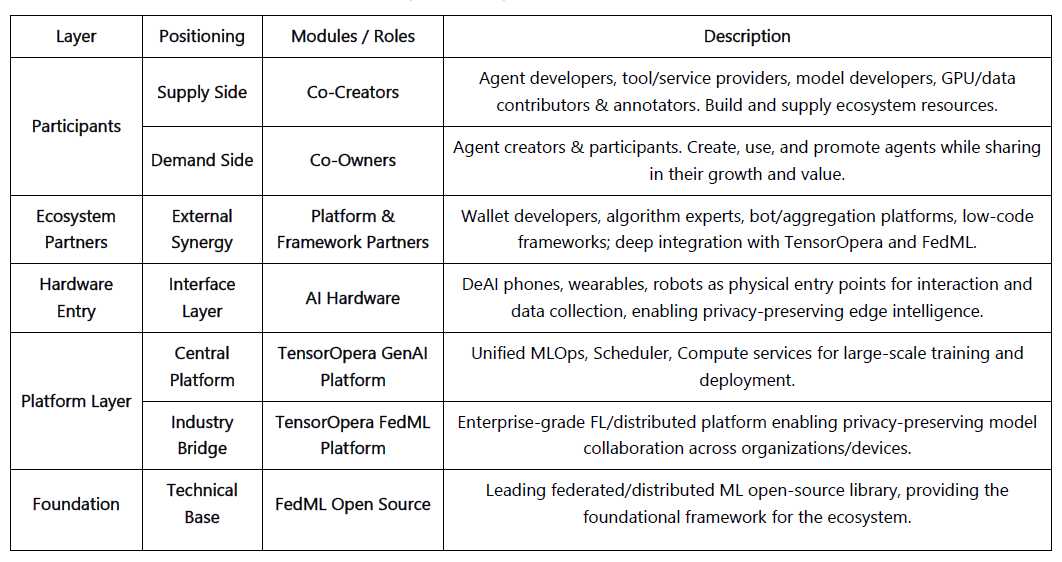

III. L'écosystème AI ChainOpera: Des co-créateurs et co-propriétaires à la fondation technique

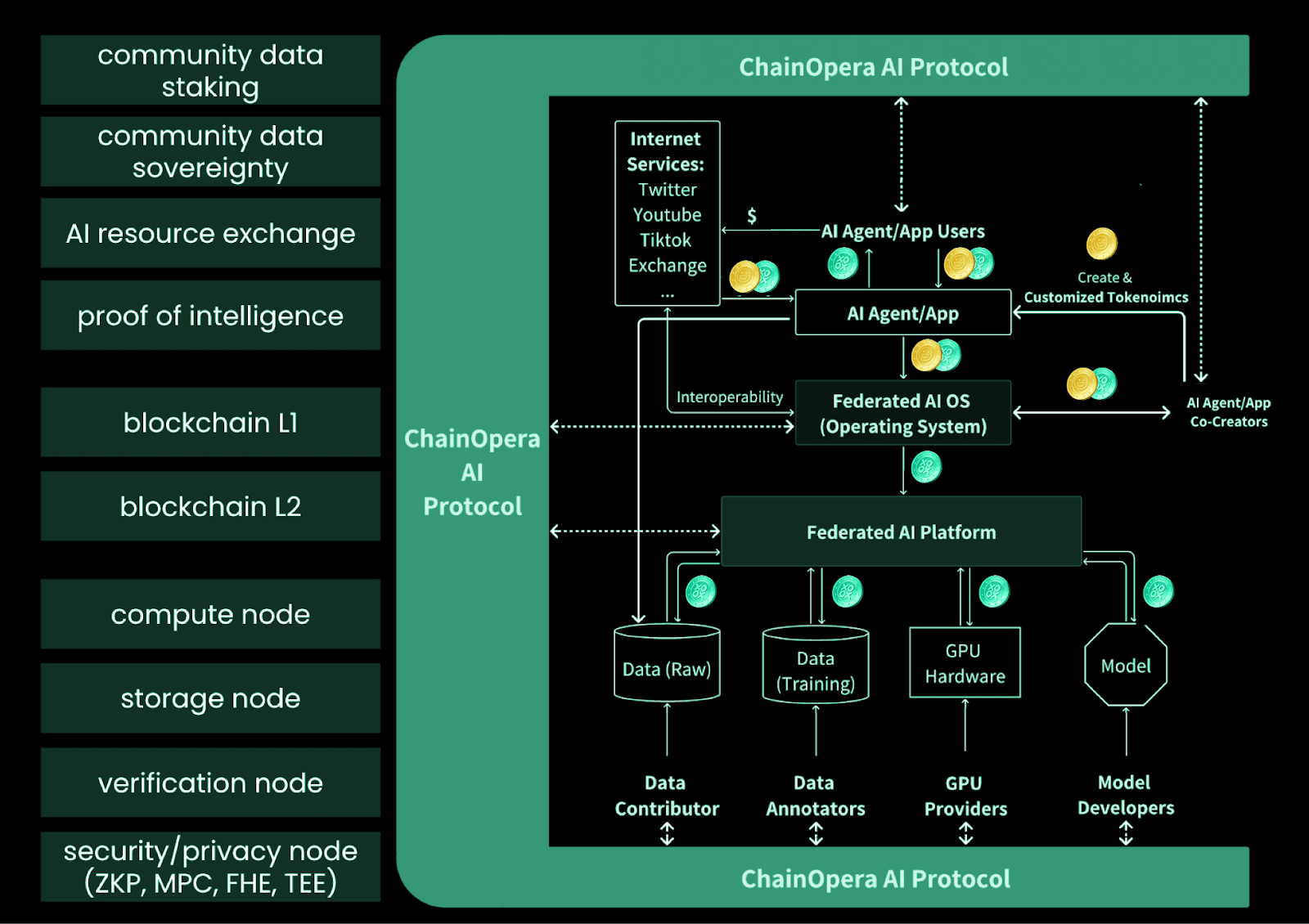

Si FedML représente le cœur technique, fournissant les bases open-source de l'apprentissage fédéré et de l'entraînement distribué; et TensorOpera abstrait les résultats de recherche de FedML en une infrastructure IA commercialisée et full-stack—alors ChainOpera prend cette capacité de plateforme on-chain.

En combinant AI Terminals + Réseaux Sociaux d'Agents + couches de calcul/données basées sur DePIN + blockchains natives à l'IA, ChainOpera cherche à construire un écosystème décentralisé de réseaux d'agents.

Le changement fondamental est le suivant: tandis que TensorOpera reste principalement orienté vers les entreprises et les développeurs, ChainOpera exploite la gouvernance de style Web3 et les mécanismes d'incitation pour inclure les utilisateurs, les développeurs, les fournisseurs de GPU et les contributeurs de données en tant que co-créateurs et co-propriétaires. De cette manière, les agents IA ne sont pas seulement « utilisés » mais aussi « co-créés et co-propriétés ».

Écosystème Co-Créateur

Grâce à sa plateforme de modèles & GPU et à la plateforme d'agents, ChainOpera fournit des chaînes d'outils, des infrastructures et des couches de coordination pour la création collaborative. Cela permet l'entraînement de modèles, le développement d'agents, le déploiement et l'évolutivité coopérative.

Les co-créateurs de l'écosystème incluent:

Développeurs d'agents IA – conçoivent et exploitent des agents.

Fournisseurs d'outils & de services – modèles, MCPs, bases de données, APIs.

Développeurs de modèles – entraînent et publient des cartes de modèles.

Fournisseurs de GPU – contribuent à la puissance de calcul via DePIN ou des partenariats cloud Web2.

Contributeurs de données & Annotateurs – téléchargent et étiquettent des ensembles de données multimodaux.

Ensemble, ces trois piliers—développement, calcul et données—provoquent la croissance continue du réseau d'agents.

Écosystème Co-Propriétaire

ChainOpera introduit également un mécanisme de co-propriété grâce à une participation partagée à la construction du réseau.

Les créateurs d'agents IA (individus ou équipes) conçoivent et déploient de nouveaux agents via la plateforme d'agents, les lançant et les maintenant tout en poussant l'innovation au niveau fonctionnel et applicatif.

Participants d'Agents IA (de la communauté) rejoignent les cycles de vie des agents en acquérant et en maintenant Unités d'Accès, soutenant ainsi la croissance et l'activité des agents par l'utilisation et la promotion.

Ces deux rôles représentent le côté offre et le côté demande, formant ensemble un modèle de partage de valeur et de co-développement au sein de l'écosystème.

Partenaires de l'écosystème: Plates-formes et cadres

ChainOpera collabore largement pour améliorer l'utilisabilité, la sécurité et l'intégration Web3:

L'application AI Terminal combine portefeuilles, algorithmes et plateformes d'agrégation pour fournir des recommandations de services intelligents.

La plateforme d'agents intègre des outils multi-cadres et low-code pour abaisser la barrière de développement.

L'IA TensorOpera alimente l'entraînement de modèles et l'inférence.

FedML sert de partenaire exclusif, permettant un entraînement préservant la confidentialité entre institutions et dispositifs.

Le résultat est un écosystème ouvert équilibrant les applications de niveau entreprise avec des expériences utilisateur natives Web3.

Points d'entrée matériels: Matériel IA & Partenaires

À travers les téléphones DeAI, les dispositifs portables et les partenaires IA robotiques, ChainOpera intègre la blockchain et l'IA dans des terminaux intelligents. Ces dispositifs permettent l'interaction avec dApps, l'entraînement côté périphérique, et la protection de la vie privée, formant progressivement un écosystème matériel IA décentralisé.

Plates-formes centrales et fondation technique

Plateforme GenAI TensorOpera – fournit des services full-stack couvrant les MLOps, le planificateur et le calcul; prend en charge l'entraînement et le déploiement de modèles à grande échelle.

Plateforme FedML TensorOpera – plateforme d'apprentissage fédéré/distribué de qualité entreprise, permettant un entraînement préservant la vie privée inter-organisation/dispositif et servant de pont entre l'académie et l'industrie.

FedML Open Source – la bibliothèque ML fédérée/distribuée de premier plan au monde, servant de base technique de l'écosystème avec un cadre open-source de confiance et évolutif.

Structure de l'écosystème AI ChainOpera

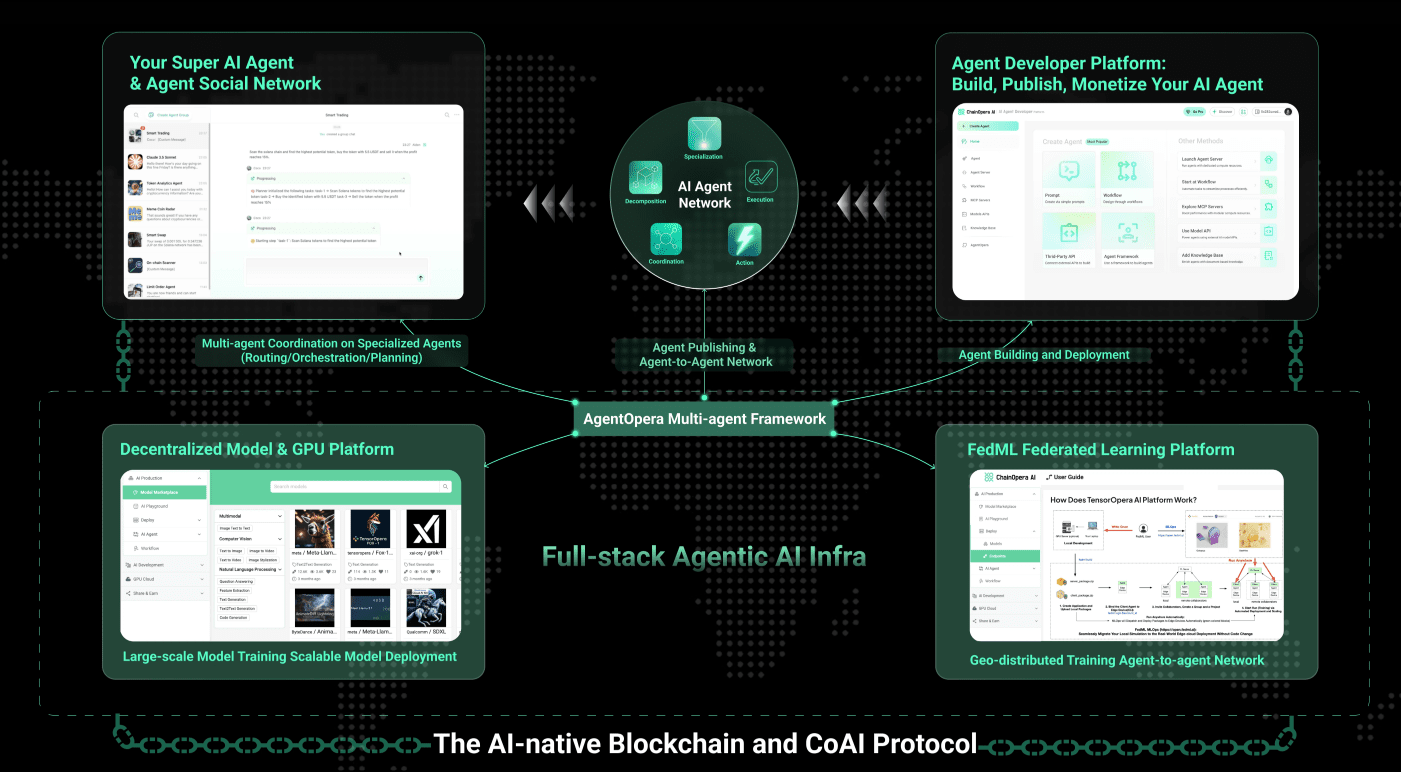

IV. Produits principaux ChainOpera et infrastructure d'agent IA full-stack

En juin 2025, ChainOpera a officiellement lancé son application AI Terminal et sa pile technologique décentralisée, se positionnant comme un « OpenAI Décentralisé ». Ses produits principaux s'étendent sur quatre modules:

Couche d'application – AI Terminal & Réseau d'Agents

Couche Développeur – Centre des Créateurs d'Agents

Couche de modèle & GPU – Réseau de modèles & calcul

Protocole CoAI & Chaîne dédiée

Ensemble, ces modules couvrent la boucle complète depuis les points d'entrée utilisateur jusqu'aux calculs sous-jacents et aux incitations on-chain.

Application AI Terminal

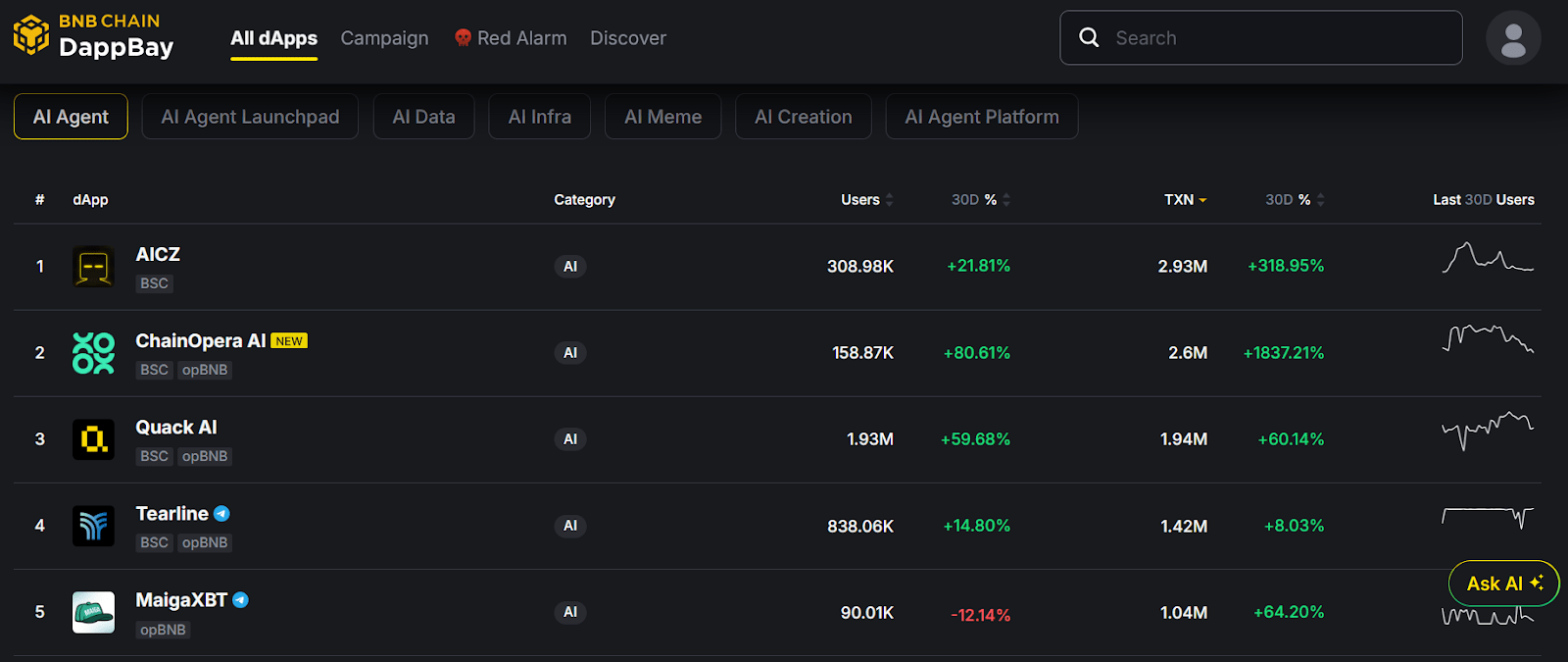

Déjà intégré avec BNB Chain, l'AI Terminal prend en charge les transactions on-chain et les agents natifs DeFi. Le Centre des Créateurs d'Agents est ouvert aux développeurs, fournissant MCP/HUB, base de connaissances et capacités RAG, avec un onboarding continu d'agents construits par la communauté. Pendant ce temps, ChainOpera a lancé l'Alliance CO-AI, s'associant avec io.net, Render, TensorOpera, FedML et MindNetwork.

Selon les données on-chain de BNB DApp Bay (30 derniers jours): 158,87K utilisateurs uniques, 2,6M de transactions et classé #2 dans toute la catégorie « Agent IA » sur BSC, Cela démontre une activité on-chain forte et croissante.

Application Super IA Agent – AI Terminal 👉 chat.chainopera.ai

Positionné comme un ChatGPT décentralisé + Hub Social IA, l'AI Terminal fournit: collaboration multimodale, incitations à la contribution de données, intégration d'outils DeFi, assistance inter-plateformes, collaboration d'agents préservant la vie privée (Vos données, Votre agent). Les utilisateurs peuvent appeler directement le modèle open-source DeepSeek-R1 et les agents construits par la communauté depuis leur mobile. Lors des interactions, tant les tokens de langue que les tokens crypto circulent de manière transparente on-chain.

Valeur centrale: transforme les utilisateurs de « consommateurs de contenu » en « co-créateurs intelligents ». Applicable à travers DeFi, RWA, PayFi, commerce électronique et d'autres domaines via des réseaux d'agents personnalisés.

Réseau Social des Agents IA 👉 chat.chainopera.ai/agent-social-network

Conçu comme LinkedIn + Messenger pour les Agents IA. Fournit des espaces de travail virtuels et des mécanismes de collaboration Agent-à-Agent (MetaGPT, ChatDEV, AutoGEN, Camel). Évolue les agents uniques en réseaux coopératifs multi-agents s'étendant à la finance, aux jeux, au commerce électronique et à la recherche. Améliore progressivement la mémoire et l'autonomie.

Plateforme de développeur d'agents IA👉 agent.chainopera.ai

Conçu comme une expérience de création de style « LEGO » pour les développeurs. Supporte des extensions sans code et modulaires, Les contrats intelligents de blockchain garantissent les droits de propriété, DePIN + infrastructure cloud abaissent les barrières d'entrée et le marché permet la découverte et la distribution

Valeur centrale: habilite les développeurs à atteindre rapidement les utilisateurs, avec des contributions enregistrées et récompensées de manière transparente.

Plateforme de modèles IA & GPU 👉 platform.chainopera.ai

Servant de couche d'infrastructure, il combine DePIN et apprentissage fédéré pour répondre à la dépendance des IA Web3 sur le calcul centralisé. Les capacités incluent: Réseau GPU distribué, Entraînement de données préservant la vie privée, Marché de modèles et de données, MLOps de bout en bout.

Vision: passer de « monopole des grandes technologies » à une « infrastructure pilotée par la communauté »—permettant la collaboration multi-agents et l'IA personnalisée.

Aperçu de l'architecture full-stack de ChainOpera

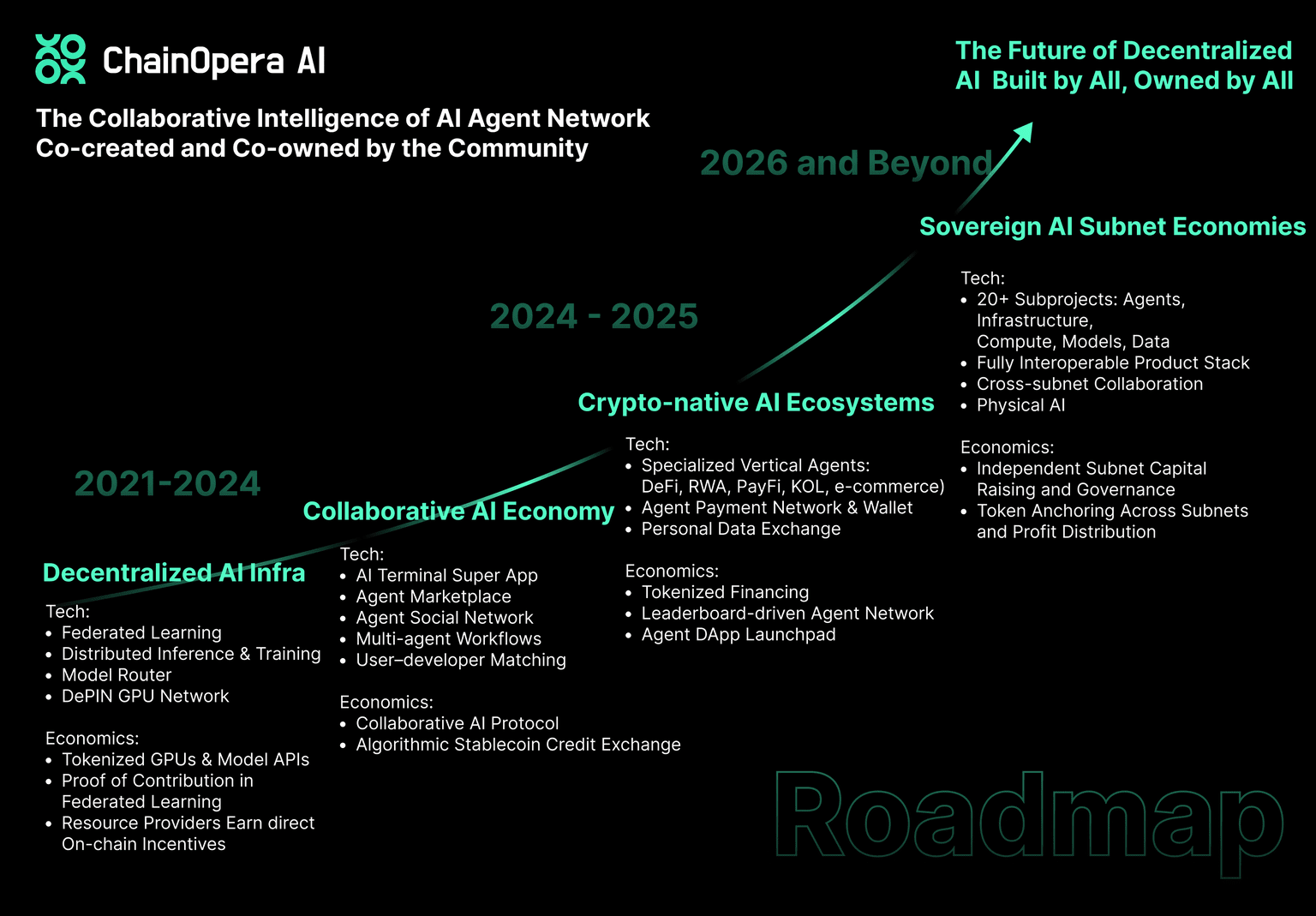

V. Feuille de route AI ChainOpera

Au-delà de la plateforme d'agent IA full-stack déjà lancée, ChainOpera AI est fermement convaincu que l'Intelligence Artificielle Générale (AGI) émergera de réseaux multimodaux et multi-agents collaboratifs. Sa feuille de route à long terme est structurée en quatre phases:

Phase I (Calcul → Capital):

Construire une infrastructure décentralisée: réseaux DePIN GPU, apprentissage fédéré, plateformes d'entraînement/inférence distribuées.

Introduire un Routeur de Modèle pour coordonner l'inférence multi-terminaux.

Incentiver les fournisseurs de calcul, de modèles et de données avec un partage de revenus basé sur l'utilisation.

Phase II (Applications agentiques → Économie AI collaborative):

Lancer l'AI Terminal, le Marché des Agents, et le Réseau Social des Agents, formant un écosystème d'application multi-agents.

Déployer le Protocole CoAI pour connecter les utilisateurs, les développeurs et les fournisseurs de ressources.

Introduire un système de correspondance utilisateur-développeur et un système de crédit, permettant des interactions fréquentes et une activité économique durable.

Phase III (IA collaborative → IA native crypto):

S'étendre aux scénarios DeFi, RWA, paiements et e-commerce.

S'étendre à des cas d'utilisation axés sur les KOL et l'échange de données personnelles.

Développer des LLM spécialisés en finance/crypto et lancer des paiements Agent-à-Agent et des systèmes de portefeuille, débloquant des applications « Crypto AGI ».

Phase IV (Écosystèmes → Économies IA autonomes):

Évoluer vers des économies de sous-réseau autonomes, chaque sous-réseau se spécialisant dans les applications, l'infrastructure, le calcul, les modèles ou les données.

Permettre la gouvernance de sous-réseau et les opérations tokenisées, tandis que les protocoles inter-sous-réseau soutiennent l'interopérabilité et la coopération.

S'étendre de l'IA agentique à l'IA physique (robotique, conduite autonome, aérospatiale).

Avertissement: Cette feuille de route est à titre de référence uniquement. Les délais et les fonctionnalités peuvent s'ajuster dynamiquement en fonction des conditions du marché et ne constituent pas une garantie de livraison.

VI. Incitations token et gouvernance de protocole

ChainOpera n'a pas encore publié de plan d'incitation token complet, mais son Protocole CoAI se concentre sur « la co-création et la co-propriété ». Les contributions sont enregistrées de manière transparente et vérifiables via la blockchain et un mécanisme de Preuve d'Intelligence (PoI). Les développeurs, fournisseurs de calcul, contributeurs de données et fournisseurs de services sont compensés en fonction de métriques de contribution standardisées. Les utilisateurs consomment des services. Les fournisseurs de ressources soutiennent les opérations. Les développeurs construisent des applications. Tous les participants partagent les dividendes de croissance de l'écosystème. La plateforme se soutient grâce à des frais de service de 1%, des récompenses d'allocation et un soutien à la liquidité—construisant un écosystème IA décentralisé ouvert, équitable et collaboratif.

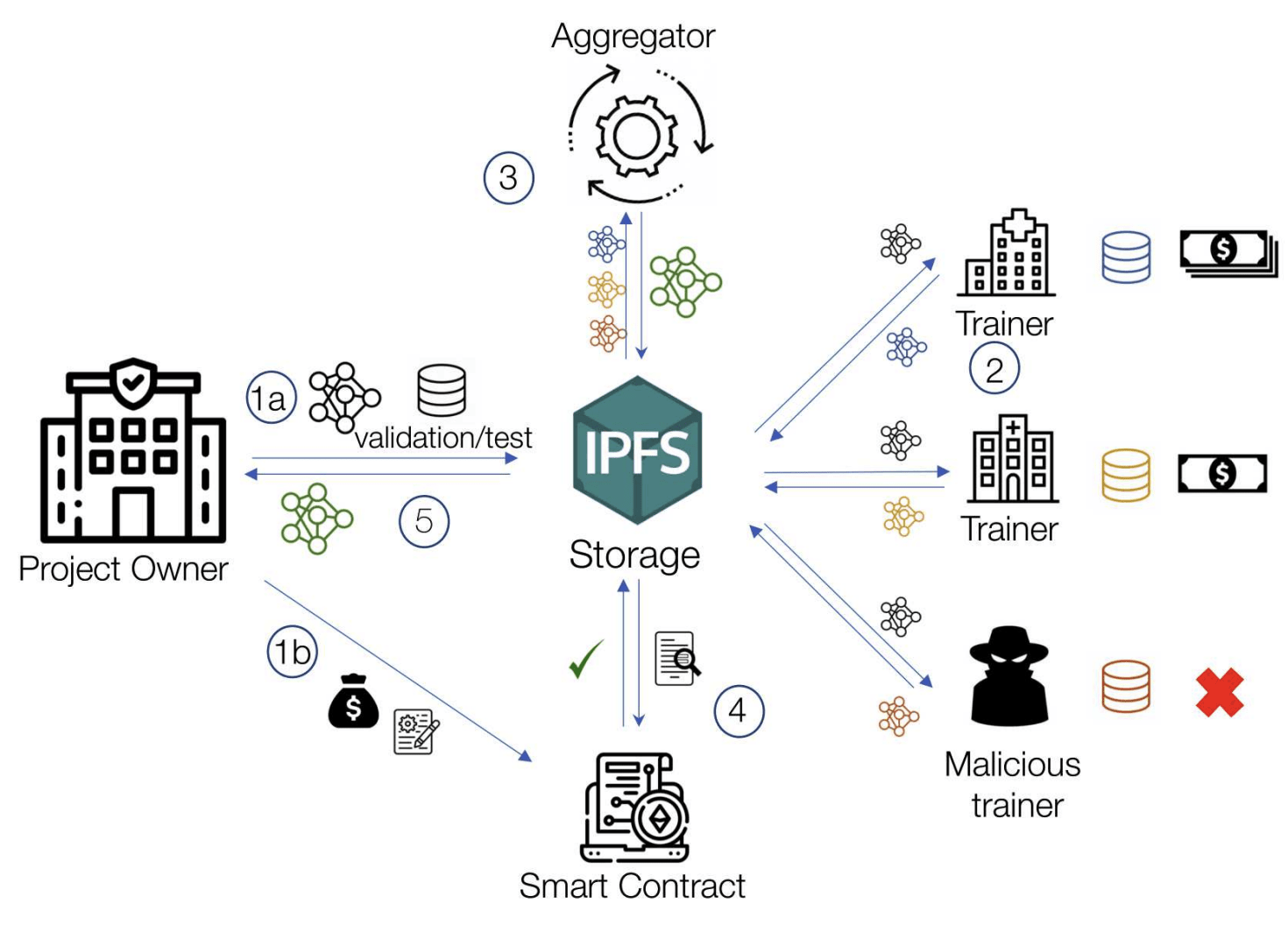

Cadre de Preuve d'Intelligence (PoI)

PoI est le mécanisme de consensus central de ChainOpera sous le Protocole CoAI, conçu pour établir un système d'incitation et de gouvernance transparent, équitable et vérifiable pour l'IA décentralisée. Il étend la Preuve de Contribution en un cadre d'apprentissage machine collaboratif activé par la blockchain, abordant les problèmes persistants de l'apprentissage fédéré : incitations insuffisantes, risques de confidentialité, et manque de vérifiabilité.

Conception centrale:

Ancré dans des contrats intelligents, intégré avec un stockage décentralisé (IPFS), des nœuds d'agrégation et des preuves à connaissance nulle (zkSNARKs).

Atteint cinq objectifs clés:

Récompenses équitables basées sur la contribution, garantissant que les formateurs sont incités à de réelles améliorations de modèles.

Les données restent locales, garantissant la protection de la vie privée.

Mécanismes de robustesse contre les participants malveillants (empoisonnement, attaques d'agrégation).

Vérification ZKP pour les processus critiques: agrégation de modèles, détection d'anomalies, évaluation des contributions.

Efficacité et généralité à travers des données hétérogènes et des tâches d'apprentissage diverses.

Flux de valeur des tokens dans l'IA Full-Stack

La conception du token de ChainOpera est ancrée dans l'utilité et la reconnaissance des contributions, et non dans la spéculation. Elle tourne autour de cinq flux de valeur principaux:

LaunchPad – pour l'initiation d'agents/d'applications.

API d'agent – accès au service et intégration.

Service de modèle – frais d'inférence et de déploiement.

Contribution – annotation de données, partage de calcul ou input de service.

Entraînement de modèle – tâches d'entraînement distribuées.

Parties prenantes:

Utilisateurs IA – dépensent des tokens pour accéder aux services ou s'abonner à des applications; contribuent en fournissant/étiquetant/stakant des données.

Développeurs d'agents & d'applications – utilisent le calcul/données pour le développement; récompensés pour la contribution d'agents, d'applications ou de jeux de données.

Fournisseurs de ressources – contribuent au calcul, aux données ou aux modèles; récompensés de manière transparente.

Participants à la gouvernance (Communauté & DAO) – utilisent des tokens pour voter, façonner les mécanismes et coordonner l'écosystème.

Couche de protocole (CoAI) – soutient le développement grâce à des frais de service et un équilibrage automatisé de l'offre/demande.

Nœuds & Validateurs – sécurisent le réseau en fournissant des services de validation, de calcul et de sécurité.

Gouvernance du protocole

ChainOpera adopte une gouvernance basée sur DAO, où le staking de tokens permet de participer aux propositions et au vote, garantissant transparence et équité.

Les mécanismes de gouvernance incluent:

Système de réputation – valide et quantifie les contributions.

Collaboration communautaire – les propositions et le vote font avancer l'évolution de l'écosystème.

Ajustements de paramètres – couvrant l'utilisation des données, la sécurité et la responsabilité des validateurs.

L'objectif global: prévenir la concentration du pouvoir, assurer la stabilité du système et soutenir la co-création communautaire.

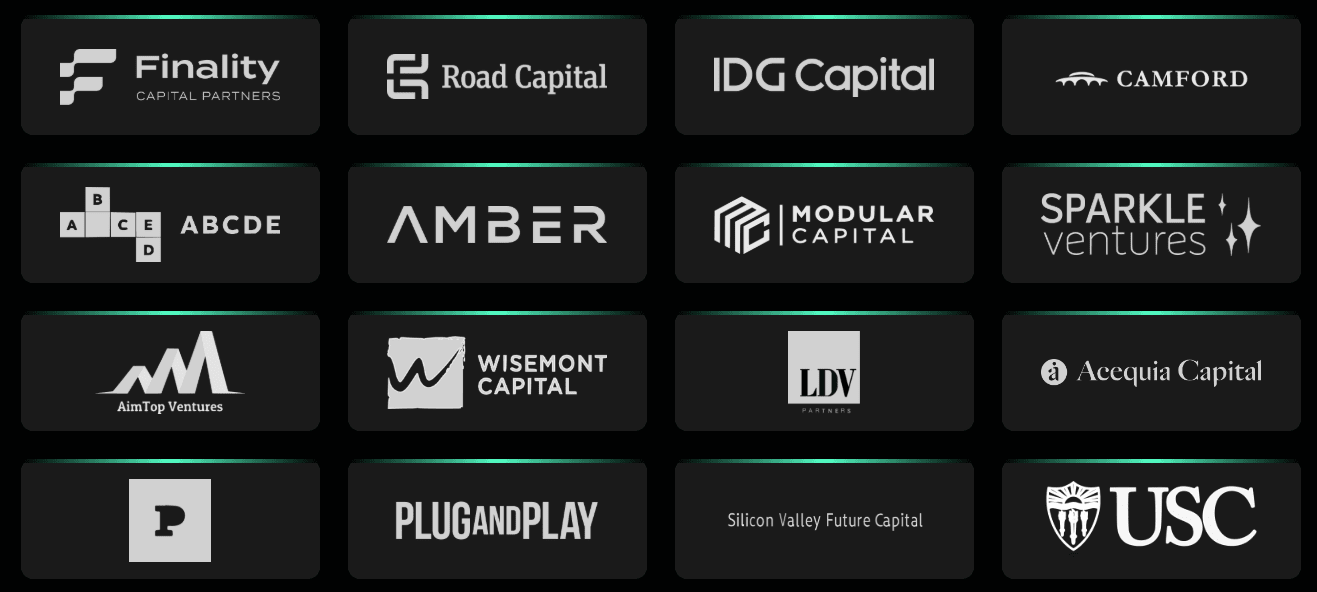

VIII. Contexte de l'équipe et financement du projet

Le projet ChainOpera a été co-fondé par le Professeur Salman Avestimehr, un éminent chercheur en apprentissage fédéré, et le Dr. Aiden Chaoyang He. L'équipe centrale s'étend sur des antécédents académiques et industriels d'institutions telles que UC Berkeley, Stanford, USC, MIT, l'Université Tsinghua, et des leaders technologiques comme Google, Amazon, Tencent, Meta et Apple. L'équipe combine une expertise de recherche approfondie avec des capacités d'exécution industrielles étendues et a atteint plus de 40 membres à ce jour.

Co-Fondateur: Professeur Salman Avestimehr

Titre & Rôles: Professeur de l'électrotechnique & de l'ingénierie informatique à l'Université de Californie du Sud (USC), Directeur Fondateur du Centre USC-Amazon sur l'IA de confiance, et responsable du laboratoire vITAL (Théorie de l'information & Apprentissage automatique) à l'USC.

Entrepreneuriat: Co-Fondateur & PDG de FedML, et en 2022, co-fondateur de TensorOpera/ChainOpera AI.

Éducation & Honneurs: Doctorat en EECS de l'UC Berkeley (Meilleur Prix de Thèse). Fellow IEEE avec plus de 300 publications en théorie de l'information, calcul distribué et apprentissage fédéré, cité plus de 30 000 fois. Récipiendaire de PECASE, du Prix NSF CAREER, et du Prix Massey de l'IEEE, entre autres.

Contributions: Créateur du cadre open-source FedML, largement adopté dans les soins de santé, la finance et l'IA préservant la vie privée, qui est devenu une base fondamentale pour TensorOpera/ChainOpera AI.

Co-Fondateur: Dr. Aiden Chaoyang He

Titre & Rôles: Co-Fondateur & Président de TensorOpera/ChainOpera AI; Ph.D. en informatique de l'USC; créateur original de FedML.

Focus de recherche: Apprentissage distribué & fédéré, entraînement de modèles à grande échelle, blockchain, et calcul préservant la vie privée.

Expérience industrielle: A précédemment occupé des rôles R&D chez Meta, Amazon, Google, Tencent; a occupé des postes d'ingénierie et de gestion au sein de Tencent, Baidu et Huawei, dirigeant le déploiement de plusieurs produits à l'échelle d'Internet et de plateformes IA.

Impact académique: Publié plus de 30 articles avec plus de 13 000 citations sur Google Scholar. Récipiendaire de la Bourse de doctorat Amazon, de la Bourse d'Innovation Qualcomm, et des Prix du Meilleur Article à NeurIPS et AAAI.

Contributions techniques: A dirigé le développement de FedML, l'un des cadres open-source les plus utilisés dans l'apprentissage fédéré, soutenant 27 milliards de requêtes quotidiennes. Contributeur central à FedNLP et aux méthodes d'entraînement parallèle hybride, appliquées dans des projets d'IA décentralisés tels que Sahara IA.

En décembre 2024, ChainOpera AI a annoncé l'achèvement d'un tour de table de 3,5 millions de dollars, portant son financement total (combiné avec TensorOpera) à 17 millions de dollars. Les fonds seront dirigés vers la construction d'une couche de blockchain 1 et d'un système d'exploitation IA pour les agents IA décentralisés.

Investisseurs principaux: Finality Capital, Road Capital, IDG Capital

Autres participants: Camford VC, ABCDE Capital, Amber Group, Modular Capital

Partenaires stratégiques: Sparkle Ventures, Plug and Play, USC

Investisseurs individuels notables: Sreeram Kannan, fondateur d'EigenLayer et David Tse, co-fondateur de BabylonChain

L'équipe a déclaré que ce tour accélérera sa vision de créer un écosystème IA décentralisé où les fournisseurs de ressources, les développeurs et les utilisateurs co-propriétaires et co-créateurs.

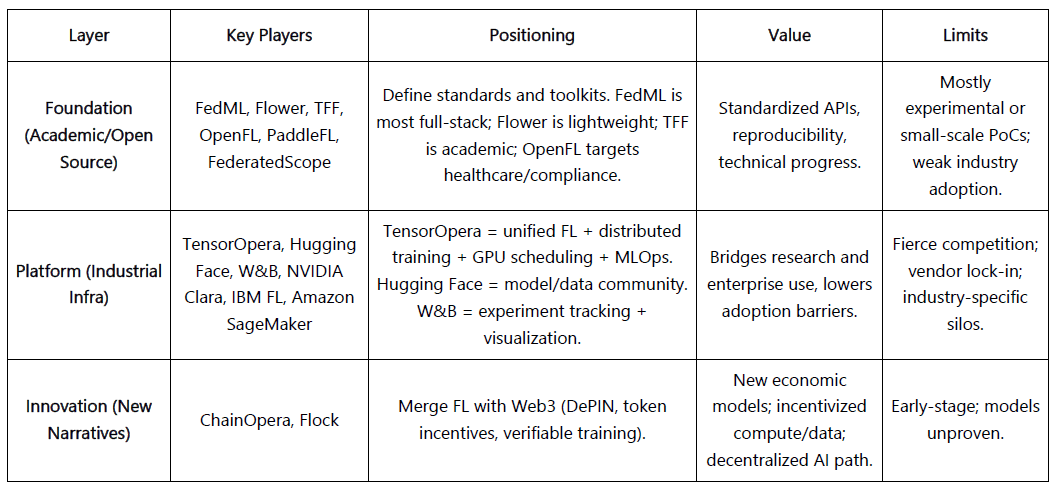

IX. Analyse du paysage du marché: Apprentissage fédéré et réseaux d'agents IA

Paysage de l'apprentissage fédéré

Le domaine de l'apprentissage fédéré (FL) est façonné par quatre principaux cadres. FedML est le plus complet, combinant l'FL, l'entraînement distribué de grands modèles, et les MLOps, le rendant prêt pour l'entreprise. Flower est léger et largement utilisé dans l'enseignement et les petites expériences. TFF (TensorFlow Federated) est académiquement précieux mais faible en industrialisation. OpenFL cible la santé et la finance, avec de fortes caractéristiques de conformité mais un écosystème fermé. En résumé: FedML est le polyvalent de qualité industrielle, Flower met l'accent sur la facilité d'utilisation, TFF reste académique, et OpenFL excelle dans la conformité verticale.

Plateformes industrielles & infrastructure

TensorOpera, l'évolution commercialisée de FedML, intègre la planification GPU cross-cloud, l'entraînement distribué, l'apprentissage fédéré et les MLOps dans une pile unifiée. Positionné comme un pont entre la recherche et l'industrie, il sert les développeurs, les PME et les écosystèmes Web3/DePIN. Effectivement, TensorOpera est comme « Hugging Face + W&B » pour l'apprentissage fédéré et distribué, offrant une plateforme plus complète et généraliste que les alternatives spécifiques à des outils ou secteurs.

Couche d'innovation: ChainOpera vs. Flock

ChainOpera et Flock fusionnent tous deux l'FL avec le Web3 mais divergent en termes de focus. ChainOpera construit une plateforme d'agent IA full-stack, transformant les utilisateurs en co-créateurs à travers l'AI Terminal et le Réseau Social des Agents. Flock se concentre sur l'FL augmentée par la blockchain (BAFL), soulignant la confidentialité et les incitations au niveau du calcul et des données. En termes simples: ChainOpera met l'accent sur les applications et les réseaux d'agents, tandis que Flock se concentre sur l'entraînement de bas niveau et le calcul préservant la vie privée.

Paysage de l'apprentissage fédéré & infrastructure IA

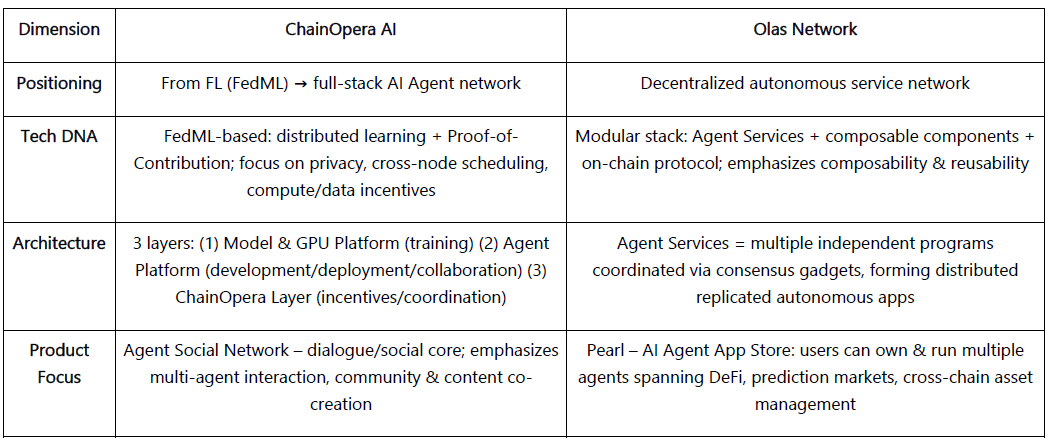

Couche de réseau d'agents: ChainOpera vs. Olas

Au niveau du réseau d'agents, les projets les plus représentatifs sont ChainOpera et Olas Network.

ChainOpera : ancré dans l'apprentissage fédéré, construit une boucle full-stack à travers des modèles, des calculs et des agents. Son Réseau Social des Agents agit comme un banc d'essai pour l'interaction multi-agents et la collaboration sociale.

Réseau Olas (Autonolas / Pearl) : originaire de la collaboration DAO et de l'écosystème DeFi, positionné comme un réseau de services autonomes décentralisés. Grâce à Pearl, il livre des applications d'agents DeFi directement sur le marché—montrant une trajectoire très différente de ChainOpera.

X. Thèse d'investissement et analyse des risques

Thèse d'Investissement

Rempart technique: La force de ChainOpera réside dans son chemin évolutif unique: de FedML (le cadre open-source de référence pour l'apprentissage fédéré) → TensorOpera (infrastructure IA full-stack de qualité entreprise) → ChainOpera (réseaux d'agents activés par le Web3 + DePIN + tokenomics). Cette trajectoire intègre des fondations académiques, un déploiement industriel, et des récits natifs crypto, créant un rempart différencié.

Applications & Échelle utilisateur: L'AI Terminal a déjà atteint des centaines de milliers d'utilisateurs actifs quotidiens et un écosystème florissant de plus de 1 000 applications d'agents. Il est classé #1 dans la catégorie IA sur BNBChain DApp Bay, montrant une croissance claire des utilisateurs on-chain et une activité transactionnelle vérifiable. Ses scénarios multimodaux, initialement ancrés dans des cas d'utilisation natifs crypto, ont le potentiel de s'étendre progressivement à la base d'utilisateurs plus large de Web2.

Partenariats écosystémiques: ChainOpera a lancé l'Alliance CO-AI, s'associant avec io.net, Render, TensorOpera, FedML et MindNetwork pour construire des effets de réseau multi-facettes à travers les GPU, les modèles, les données et le calcul préservant la vie privée. En parallèle, sa collaboration avec Samsung Electronics pour valider la multimodalité mobile GenAI démontre le potentiel d'expansion vers le matériel et l'IA de périphérie.

Modèle de token & Économie: La tokenomics de ChainOpera est basée sur le consensus de Preuve d'Intelligence, avec des incitations distribuées à travers cinq flux de valeur: LaunchPad, API d'agent, Service de modèle, Contribution, et Entraînement de modèle. Un frais de service de 1% pour la plateforme, l'allocation de récompenses, et le soutien à la liquidité forment une boucle de rétroaction positive, évitant la dépendance à la pure « spéculation de token » et renforçant la durabilité.

Risques potentiels

Risques d'exécution technique: L'architecture décentralisée à cinq couches proposée par ChainOpera couvre une large portée. La coordination entre les couches—surtout dans l'inférence distribuée pour les grands modèles et l'entraînement préservant la vie privée—fait encore face à des défis de performance et de stabilité et n'a pas encore été validée à grande échelle.

Collant des utilisateurs et de l'écosystème: Bien que la croissance précoce des utilisateurs soit notable, il reste à voir si le Marché des Agents et l'outil pour développeurs peuvent soutenir une activité à long terme et des contributions de haute qualité. Le réseau social des agents actuel est principalement axé sur le dialogue textuel LLM; l'expérience utilisateur et la rétention nécessitent encore des améliorations. Sans incitations soigneusement conçues, l'écosystème risque un battage médiatique à court terme sans valeur à long terme.

Durabilité du modèle commercial: Actuellement, les revenus dépendent principalement des frais de service de plateforme et de la circulation des tokens; des flux de trésorerie stables ne sont pas encore établis. Comparé à AgentFi ou aux applications axées sur les paiements qui portent des attributs financiers ou de productivité plus forts, le modèle actuel de ChainOpera nécessite encore une validation de sa valeur commerciale. De plus, l'écosystème mobile et matériel reste exploratoire, laissant ses perspectives de marché incertaines.

Avertissement: Ce rapport a été préparé avec l'aide d'outils IA (ChatGPT-5). L'auteur a fait tous les efforts possibles pour relire et garantir l'exactitude, mais certaines erreurs ou omissions peuvent subsister. Les lecteurs doivent noter que les marchés des actifs crypto montrent souvent une divergence entre les fondamentaux des projets et la performance des tokens sur le marché secondaire. Ce rapport est destiné uniquement à la consolidation d'informations et à la discussion académique/recherche. Il ne constitue pas un conseil d'investissement, ni ne doit être interprété comme une recommandation d'achat ou de vente de tout token.