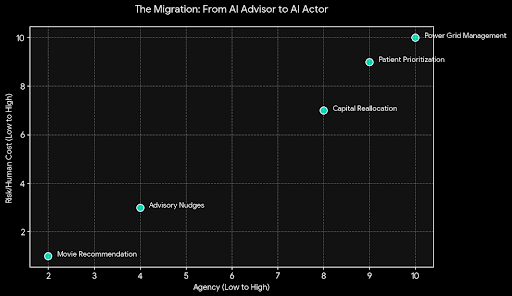

L'IA était utilisée pour rester poliment en arrière-plan, offrant des suggestions et des encouragements. Maintenant, elle fait un pas en avant, prend des décisions et, dans certains systèmes, signe le chèque. Cette migration de conseiller à acteur est urgente, excitante et silencieusement terrifiante.

Lorsqu'un algorithme recommande un film, un mauvais choix n'est qu'une source d'ennui. Lorsqu'il réalloue des capitaux, priorise un patient ou redirige de l'énergie, une seule erreur peut avoir des répercussions réelles avec des coûts humains réels. Le problème n'est pas l'intelligence en soi, mais l'action sans responsabilité vérifiable.

Les hallucinations, la dérive des modèles et les astuces adversariales ne sont plus des bugs théoriques ; ce sont des vecteurs de préjudice. Une affirmation qui semble confiante d'un modèle peut se traduire directement en une transaction, un décharge ou un changement de politique si les résultats du système sont dotés d'agence. Sans moyen de prouver ce qui s'est réellement passé, "l'IA a dit cela" devient un substitut dangereux à l'audit et à la supervision.

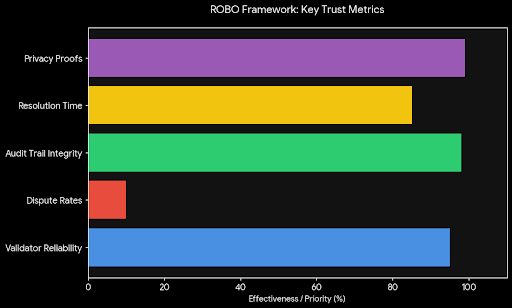

C'est pourquoi la vérification des actions, pas seulement des résultats, est importante. Il ne suffit pas d'inspecter ce qu'un système a produit sur papier. Nous devons vérifier les changements d'état : le commerce a-t-il été réglé, l'ordonnance a-t-elle été exécutée, le réseau a-t-il été ajusté ? Des attestations vérifiables et à preuve de falsification transforment les revendications en preuves et le récit en auditabilité.

Les réseaux ouverts amplifient le problème de vérification. Lorsque de nombreux agents peuvent soumettre des revendications, des attestations à faible coût invitent au spam, à la manipulation et à une fausse confiance. Une couche de vérification qui est gratuite pour tous sera noyée dans le bruit et manipulée par ceux qui profitent de la tromperie.

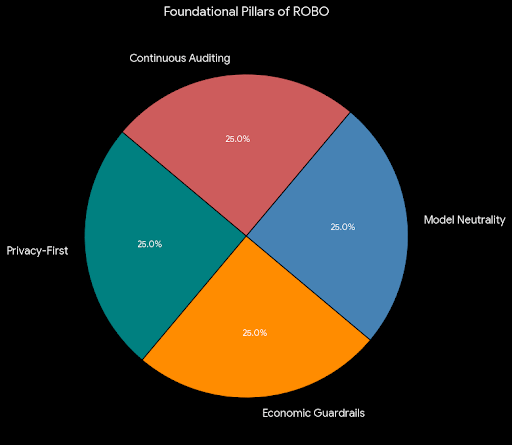

ROBO répond à cela avec des garde-fous économiques et réputationnels. Les validateurs engagent des ressources, gagnent des récompenses pour des attestations honnêtes et font face à des pénalités pour fraude. Lorsque la vérification coûte de l'argent réel, de la réputation ou des opportunités, le système décourage les revendications frivoles et récompense l'exactitude. Les incitations deviennent une défense, pas une échappatoire.

La confidentialité doit être intégrée dans tout schéma de responsabilité. La santé et la finance regorgent de secrets qui ne peuvent être révélés au nom de la vérification. Des preuves cryptographiques qui confirment des conditions sans exposer les données sous-jacentes nous permettent de vérifier sans surveiller. Vous pouvez prouver qu'un seuil a été atteint sans révéler l'intégralité du dossier ; vous pouvez confirmer la conformité sans publier de stratégie propriétaire.

La neutralité est un autre pilier. Une couche de vérification qui favorise un seul fournisseur ou une seule architecture recrée simplement les risques de concentration que nous espérions que la décentralisation éviterait. La vérification des revendications agnostiques au modèle et réutilisables rend les attestations portables et composables. La confiance voyage avec la preuve, pas le fournisseur, et les systèmes interopèrent plutôt que de se bloquer mutuellement.

La vérification n'est pas un événement ; c'est une pratique. Les systèmes autonomes apprennent, mettent à jour et changent leur comportement. La vérification doit être continue : attestations en streaming, audits en cours et métriques de confiance en direct plutôt que des tampons à un seul point. Cette visibilité continue révèle les dérives, met en lumière les modèles et rend la confiance mesurable.

Des métriques de confiance claires changent le comportement des organisations. Au lieu de revendications marketing sur une "précision prouvée", les équipes montrent des historiques : la fiabilité des validateurs, les taux de litige, les pistes d'audit et les temps de résolution. Ces métriques rendent la responsabilité auditable et créent des incitations à améliorer la fiabilité à long terme plutôt qu'à court terme.

La défense n'est jamais statique. Alors que les acteurs malveillants inventent de nouvelles façons de tromper, la vérification doit évoluer en conséquence. Des règles adaptatives, des normes pilotées par la communauté et une supervision en couches, des vérifications cryptographiques à l'examen humain lorsque cela est approprié, rendent la manipulation plus difficile et la détection plus rapide.

La vérification décentralisée élève également le niveau de désinformation. Dans un monde où le contenu synthétique et les deepfakes sont monnaie courante, les attestations cryptographiques agissent comme des ancres de provenance. Lorsqu'un enregistrement est attesté, il porte un contexte vérifiable ; lorsqu'il ne l'est pas, le scepticisme est justifié. Ce binaire entre prouvable et non prouvé restaure une mesure d'hygiène épistémique.

Mettre des preuves vérifiables au centre de l'autonomie ne signifie pas renoncer à la vitesse ou à l'innovation. Cela signifie intégrer la responsabilité dans les canaux où les agents effectuent des transactions. Les machines peuvent encore négocier, optimiser et agir ; elles montrent simplement leurs reçus par la suite d'une manière que d'autres agents et humains peuvent valider.

Cela change les incitations dans tout l'écosystème. Les fournisseurs qui produisent des résultats vérifiables et auditables gagnent la confiance. Les régulateurs et les auditeurs obtiennent des enregistrements objectifs. Les utilisateurs et les institutions peuvent choisir des agents en fonction de leur fiabilité démontrée plutôt qu'en fonction de la publicité. La responsabilité devient un signal de marché, pas seulement une case de conformité.

Le changement le plus important est culturel. Nous passons de traiter l'IA comme un oracle dont les déclarations sont acceptées sur foi, à traiter l'IA comme un acteur dont les actes doivent être prouvables. Ce changement reformule les conversations sur l'autonomie : de "Le modèle peut-il le faire ?" à "Le modèle peut-il prouver qu'il l'a fait ?"

Le modèle agnostique de ROBO, axé sur la confidentialité et économiquement aligné, jette les bases de cette transition culturelle. Il protège les données sensibles, résiste au spam et aux abus, et rend la confiance mesurable et portable. Il ne garantit pas la perfection, mais il construit un système où les échecs sont visibles, responsables et apprenables.

En fin de compte, la question qui se pose est simple et claire. Laissons-nous les systèmes autonomes agir en notre nom sans reçus, ou exigeons-nous une preuve et construisons-nous une infrastructure qui l'exige ? Le choix détermine si l'IA devient un danger non responsable ou une fondation fiable.

Nous devrions choisir une responsabilité prouvable. Lorsque les machines peuvent montrer, de manière cryptographique et auditable, ce qu'elles ont fait et pourquoi, la confiance cesse d'être un saut dans l'inconnu et devient une mesure que nous pouvons gérer. C'est ainsi que nous passons d'une dépendance aveugle à une autonomie responsable, et comment nous garantissons que des systèmes puissants servent les gens plutôt que de les surprendre.