Geschrieben von Qubic Scientific Team

Ein Kommentar zu Nick Bostroms neuestem Papier von Qubic Scientific Team

Neugestaltung der Debatte über Superintelligenz: Chirurgie, nicht Roulette

Er hat gerade ein neues Arbeitspapier veröffentlicht, Optimale Zeitpunkte für Superintelligenz: Alltägliche Überlegungen für bestehende Menschen (2026), in dem er die zentrale Frage verschiebt. Anstatt zu fragen, ob wir Superintelligenz entwickeln sollten, konzentriert sich Bostrom darauf, wann es optimal ist, dies zu tun. Für alle, die die sich schnell entwickelnde Schnittstelle von KI und Blockchain verfolgen, hat sein Rahmenwerk tiefgreifende Auswirkungen darauf, wie wir die Infrastruktur gestalten, die die künstliche allgemeine Intelligenz (AGI) untermauern wird.

Die Debatte über Superintelligenz neu gestalten: Chirurgie, nicht Roulette

Der Ausgangspunkt von Bostroms Papier ist sowohl elegant als auch disruptiv. Er reframiert die polarisierten Debatten "AI ja vs. AI nein" vollständig. Die Entwicklung von Superintelligenz, argumentiert er, ist nicht wie russisches Roulette zu spielen. Es ist eher wie eine riskante Operation für einen Zustand, der bereits tödlich ist.

Was ist dieser Zustand? Der aktuelle Zustand der Menschheit selbst. Betrachten Sie die Basislinie: etwa 170.000 Todesfälle pro Tag durch Alterung, Krankheit und systemische Mängel. Eine alternde Weltbevölkerung sieht sich irreversibler biologischer Verschlechterung gegenüber. Unheilbare Krankheiten, einschließlich onkologischer, neurodegenerativer und kardiovaskulärer Erkrankungen, belasten weiterhin Millionen. Wir stehen ungeminderten globalen Risiken gegenüber, von klimatischer Instabilität über systemische institutionelle Korruption bis hin zum Verlust der demokratischen Qualität. Pandemien, Kriege und der Zusammenbruch ganzer Systeme bleiben ständige Bedrohungen.

Angesichts dieser Realitäten argumentiert Bostrom, dass die Wahl als "Nullrisiko ohne KI" versus "extremes Risiko mit einer Superintelligenz" zu rahmen, vereinfacht ist. Die rigorosere Frage lautet: Welche Trajektorie erzeugt eine größere erwartete Lebenserwartung und eine höhere Lebensqualität für bereits existierende Menschen?

Indem er seine Analyse in den realen, gegenwärtigen Bedingungen des menschlichen Lebens verankert, umgeht Bostrom philosophische Abstraktionen und theologische Spekulationen. Er spricht von Ihnen, Ihrer Familie und den Menschen, die jetzt leben.

Lebenserwartung, Sterberisiko und das Plädoyer für künstliche allgemeine Intelligenz

Wenn wir jung sind, ist das jährliche Sterberisiko extrem niedrig. Biologisch sind wir in den meisten Fällen weit von der Todesgefahr entfernt. Aber mit dem Alter steigt die Wahrscheinlichkeit zu sterben unaufhörlich aufgrund biologischer Verschlechterung.

Wenn Superintelligenz das Altern radikal reduzieren oder sogar beseitigen könnte, wie Bostrom vorschlägt, würde Ihr jährliches Sterberisiko auf dem Niveau einer gesunden jungen Person bleiben. Ihre Sterbewahrscheinlichkeit würde im Laufe der Zeit nicht mehr steigen. In diesem Szenario wird die Lebenserwartung außergewöhnlich lang.

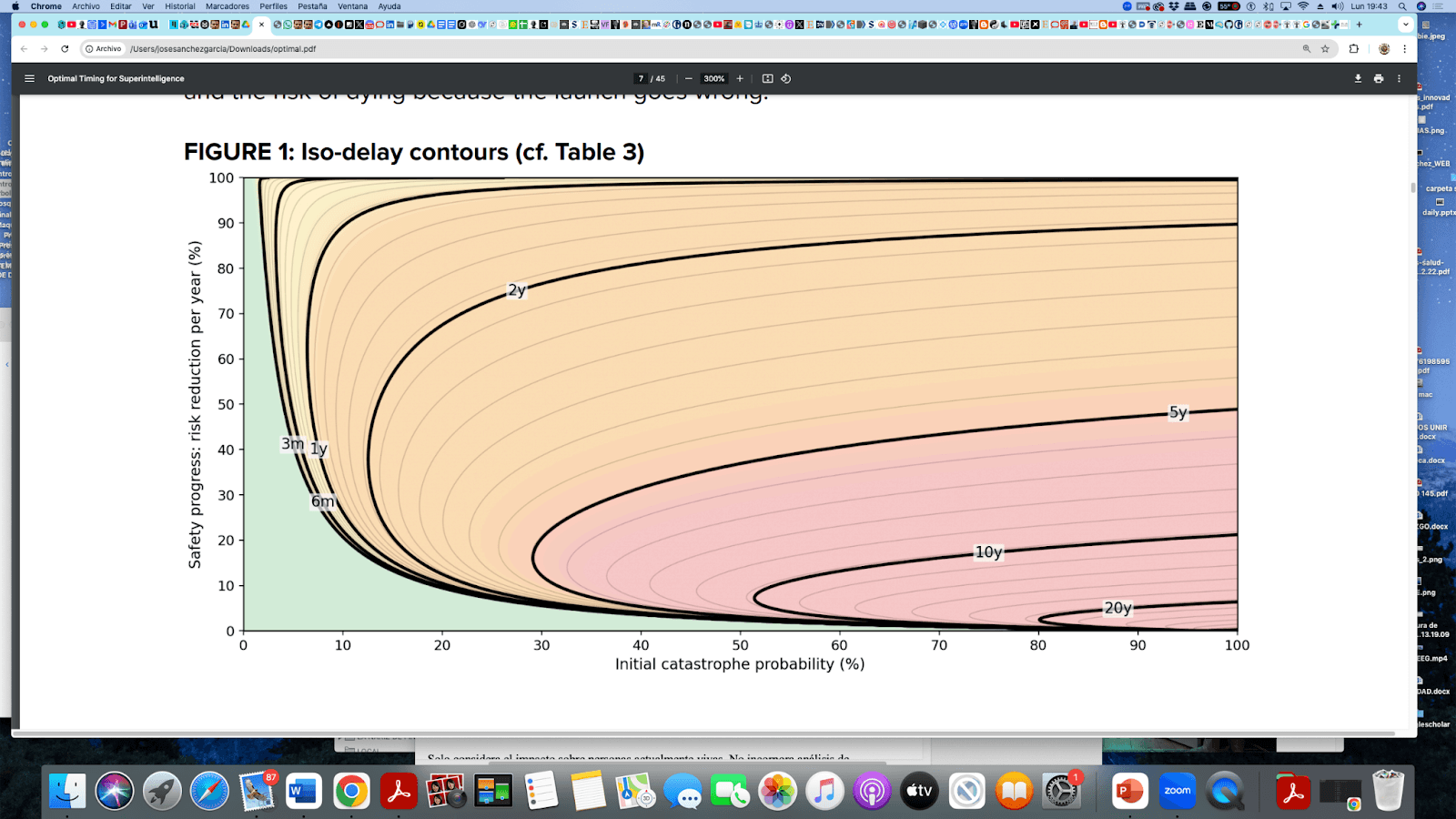

Aus dieser Perspektive kompensiert der erwartete Wert der Superintelligenz ihre hohen Risiken. Aber was passiert, wenn wir warten, bis die Technologie perfekt "sicher" wird? Was, wenn wir die Wahrscheinlichkeit zu sterben mit jedem Jahr, das vergeht, kumulieren? Die Frage wird: Ist es rationaler, die Wahrscheinlichkeit einer Katastrophe durch frühe Bereitstellung zu akzeptieren, angesichts dessen, dass der Fortschritt in der Sicherheit von KI exponentiell ist, oder die Gewissheit kumulierter Todesfälle durch Verzögerung zu akzeptieren?

Zeitliches Abzinsen und die Kosten des Wartens

Bostrom führt das Konzept des zeitlichen Abzinsens (ρ) ein, ein gut untersuchtes Prinzip in der Entscheidungstheorie. Menschen bewerten systematisch gegenwärtige Ergebnisse höher als zukünftige. Das ist der Grund, warum wir in unzufriedenen Jobs, Beziehungen und Mustern bleiben: der Aufwand für Veränderungen erscheint groß, und die Belohnung erscheint fern.

Aber hier findet eine interessante Umkehrung statt. Wenn das Leben nach AGI nicht nur länger, sondern dramatisch besser ist, mit radikalen Verbesserungen in der Gesundheit, kognitiven Kapazität und Lebensqualität, dann bestraft das zeitliche Abzinsen tatsächlich das Warten. Jedes Jahr der Verzögerung ist ein Jahr, das in einem qualitativ schlechteren Zustand verbracht wird, wenn ein weit überlegener Zustand zugänglich ist.

Lebensqualität und Risikoaversion bei der Bereitstellung von AGI

Bostroms Modell geht nicht von Langlebigkeit allein aus. Es integriert wesentliche Verbesserungen des Wohlbefindens. Wenn die Lebensqualität nach dem Übergang zur Superintelligenz sich verdoppelt, verschiebt sich das Gleichgewicht entscheidend in Richtung einer früheren Bereitstellung. Er fügt dann Risikomaßstäbe (CRRA und CARA) hinzu und erkennt an, dass wenn wir empfindlicher gegenüber extremen Verlusten sind, das Fenster, in dem "jetzt starten" ratsam bleibt, sich verengt und optimale Verzögerungen sich verlängern.

Das ist kein rücksichtsloser Beschleunigungswahn. Es ist eine kalibrierte Entscheidungsfindung unter Unsicherheit, die Art von Analyse, die informieren sollte, wie wir den Weg zur künstlichen allgemeinen Intelligenz steuern.

Zwei-Phasen-Bereitstellung: Schnell zum Hafen, langsam zum Liegeplatz

Einer der stärksten Beiträge des Papiers ist die Aufteilung des AGI-Übergangs in zwei unterschiedliche Phasen:

Phase 1: Erreichen der AGI-Fähigkeit. So schnell wie verantwortungsvoll voranschreiten, um ein System zu schaffen, das allgemeine Intelligenz demonstriert.

Phase 2: Eine strategische Pause vor der vollständigen Bereitstellung. Sobald das System existiert, eine kontrollierte Verzögerung einführen, um es zu studieren, unter realen Bedingungen zu testen und technische Sicherheitsprobleme zu lösen, die zuvor nur theoretisch waren.

Bostroms Hypothese ist, dass sobald ein AGI-System tatsächlich existiert, ein "Sicherheitswindfall" auftritt. Forscher können reales Verhalten beobachten, anstatt darüber zu spekulieren. Der Fortschritt in der Sicherheit beschleunigt sich dramatisch, weil die Probleme empirisch und nicht abstrakt werden. Das Motto, das er prägt: schnell zum Hafen, langsam zum Liegeplatz.

Wer profitiert am meisten von einem früheren Übergang zur Superintelligenz?

Bostrom behandelt die optimale zeitliche Abstimmung nicht als universell. Ältere Menschen, schwerkranke und diejenigen, die in prekären Bedingungen leben, haben weniger verbleibende erwartete Jahre. Für sie ist der potenzielle Nutzen eines raschen Übergangs zu Superintelligenz weitaus größer. Jüngere Menschen mit Jahrzehnten vor sich können mehr warten.

Wenn Sie eine prioritäre Logik anwenden, die denjenigen, die schlechter dran sind, mehr Gewicht beimisst, verschiebt sich der optimale Zeitrahmen nach vorn. Bostrom lehnt auch ausdrücklich die gängige Annahme ab, dass über ein gewisses Alter hinaus zusätzliches Leben keinen Wert hinzufügt. Dieses Urteil, argumentiert er, ist in unserer Erfahrung mit dem aktuellen Altern und der Verschlechterung verwurzelt. Es berücksichtigt nicht ein Szenario echter Verjüngung, eines der zentralen Versprechen einer superintelligenten Zukunft.

Institutionelle Risiken: Warum die AI-Governance-Infrastruktur wichtig ist

In den letzten Abschnitten seines Papiers führt Bostrom kritische institutionelle Warnungen ein. Das vernünftigste Szenario, schlägt er vor, ist eines, in dem der technologische Führer seinen Vorteil für die Sicherheit nutzt. Aber er weist auch auf die Gefahren nationaler Moratorien, internationaler Verbote und die wettbewerbsorientierten Dynamiken hin, die entstehen, wenn mehrere Akteure unter geopolitischem Druck auf AGI zueilen.

Seine Analyse nimmt implizit ein Ökosystem an, in dem sich Rechenleistung tendenziell konzentriert. In einem solchen Umfeld kumulieren sich die Risiken: Militarisierung von Rechenressourcen, Compute-Überhang (massive Reserven, die unter Wettbewerbsdruck aktiviert werden können) und die perversen Anreize extremer Zentralisierung. Dies sind keine abstrakten Bedenken. Der aktuelle Verlauf der KI-Entwicklung, dominiert von einer Handvoll hyperskalierter Cloud-Anbieter und Unternehmenslaboren, schafft genau diese Konzentration.

Auswirkungen für Qubic: Warum eine dezentralisierte KI-Infrastruktur existenzielle Risiken reduziert

Wenn wir Bostroms Rahmen ernst nehmen, verschiebt sich die grundlegende Frage von "Wann AGI starten" zu welcher Art von Infrastruktur die Risiken im Zusammenhang mit diesem Start reduziert. Hier wird Qubics Architektur direkt relevant für die globale Diskussion über die Sicherheit von Superintelligenz.

Das Zentralisierungsproblem in der aktuellen KI-Entwicklung

Wenn Superintelligenz auf zentralisierten Infrastrukturen aufgebaut wird, die von enormen Rechenzentren, intransparenten Trainingspipelines und Unternehmenskontrolle abhängig sind, erweitert sich das Risiko-Profil über das rein Technische hinaus. Es wird geopolitisch. Die Konzentration von Compute macht die Art von adaptiver Governance, die Bostrom für während der kritischen Vorbereitungsphase für unerlässlich hält, weitaus schwieriger. Es schafft auch genau die Art von Compute-Überhang, vor der er warnt: massive Rechenreserven, die bereit sind, unter Wettbewerbsdruck auf einmal aktiviert zu werden.

Wie Qubics verteilte Compute-Architektur diese Risiken angeht

Qubic verdünnt diesen strukturellen Engpass. Seine Architektur verteilt die Rechenleistung über ein globales Netzwerk, anstatt sie in einem einzigen Knoten zu konzentrieren. Qubic hängt nicht von einer LLM-artigen Architektur ab, die in mega Datenzentren intransparent trainiert wird. Stattdessen nutzt es den Nützlichen Proof of Work (uPoW), bei dem Miner echte Berechnungen zum Training seines KI-Kerns, Aigarth, beitragen, anstatt willkürliche Hash-Puzzles zu lösen.

Diese Designentscheidung hat direkte Auswirkungen auf Bostroms Analyse. Eine weniger zentralisierte Infrastruktur verringert die Wahrscheinlichkeit der abrupten, wettbewerbsorientierten Bereitstellungsszenarien, vor denen er warnt. Verteiltes Compute bedeutet, dass die Macht nicht an einem einzigen Standort konzentriert ist, der militärisch erfasst werden kann, noch in einem Unternehmenslabor unter einseitiger Kontrolle. Diese strukturelle Resilienz erweitert den Raum für Bostroms Phase 2: die strategische Pause, in der echtes Testen, schrittweise Verbesserung und adaptive Governance stattfinden können, bevor die vollständige Bereitstellung erfolgt.

Um ein tieferes Verständnis dafür zu gewinnen, wie sich Qubics Ansatz zur KI von Mainstream-Modellen unterscheidet, erkunden Sie Neuraxon: Qubics großer Sprung in Richtung lebender, lernender KI und die aktuelle Analyse, dass statische KI ein toter Weg ist. Google bestätigt.. Diese Beiträge verdeutlichen, wie Qubic Intelligenz durch ein grundsätzlich anderes Paradigma aufbaut: eines, das für kontinuierliches Lernen, verteilte Resilienz und Anpassung an die reale Welt in einem dezentralen Netzwerk entworfen ist.

Dezentralisierte KI und Blockchain: Strukturelle Ausrichtung mit AGI-Sicherheit

Aus Bostroms Perspektive liegt Qubics Potenzial nicht einfach darin, "dezentralisiert" als Branding-Übung zu sein. Es liegt darin, die strukturellen Variablen zu ändern, die den optimalen Zeitpunkt für die Bereitstellung von Superintelligenz bestimmen. Durch das Verteilen von Compute, den Aufbau von Konsensprotokollen, die die Anreize der Miner mit echtem AI-Training in Einklang bringen, und durch die Offenheit und Prüfbarkeit des gesamten Prozesses schafft Qubic die Art von Infrastruktur, die den Übergang zur AGI strukturell sicherer macht.

Wenn Sie sich dafür interessieren, wie sich Qubics CPU-Mining-Modell und das verteilte Compute-Netzwerk entwickeln, erklärt der Dogecoin-Mining auf Qubic tiefere Einblicke in die neuesten Erweiterungen des Nützlichen Proof of Work, und Qubics Vision 2026 beschreibt die breitere Infrastruktur-Roadmap, die jetzt im Gange ist.

Das schwierigste Problem: den AGI zu bauen, der von der Welt lernt

Utopische und dystopische Szenarien zu imaginieren, ist wertvoll. Es ist in der Tat der beste Weg, um Zukunftsperspektiven zu schaffen, die mit den menschlichen Bedürfnissen und Werten übereinstimmen. Aber wegzuschauen, ziellos zu warten oder ohne Einschränkung zu beschleunigen, versagt alles darin, die notwendigen Überlegungen bereitzustellen.

Vielleicht ist die derzeit schwierigste Herausforderung nicht so sehr die Abwägung des Risikos einer beschleunigten Übergangs und dessen Modellierung. Im Moment besteht die härteste Aufgabe darin, eine allgemeine künstliche Intelligenz zu entwickeln, die in der Lage ist, selbstständig aus verschiedenen dynamischen Umgebungen zu lernen, Darstellungen der Welt zu schaffen und innerhalb derselben zu agieren. Das ist genau die Herausforderung, die Qubics Neuraxon-Framework angeht, nicht durch das Training auf statischen Datensätzen hinter verschlossenen Türen, sondern durch das Evolvieren im offenen Raum, das Lernen aus der Komplexität der realen Welt in einem dezentralen Netzwerk, an dem jeder teilnehmen kann.

Referenzen und Quellen

1. Bostrom, N. (2026). Optimale Zeit für Superintelligenz: Alltägliche Überlegungen für existierende Menschen. Arbeitspapier, v1.0.

https://nickbostrom.com/optimal.pdf

2. Bostrom, N. (2014). Superintelligenz: Wege, Gefahren, Strategien. Oxford University Press.

3. Bostrom, N. (2003). Astronomischer Abfall: Die Opportunitätskosten verzögerter technologischer Entwicklung. Utilitas, 15(3), 308–314.

4. Yudkowsky, E. & Soares, N. (2025). Wenn jemand es baut, sterben alle.

5. Hall, R. E. & Jones, C. I. (2007). Der Wert des Lebens und der Anstieg der Gesundheitsausgaben. Vierteljährliche Zeitschrift für Wirtschaft, 122(1), 39–72.

6. Qubic Scientific Team. Neuraxon: Qubics großer Sprung in Richtung lebender, lernender KI.

https://qubic.org/blog-detail/neuraxon-qubic-s-big-leap-toward-living-learning-ai

7. Diskussion der LessWrong-Community: Optimale Zeit für Superintelligenz

https://www.lesswrong.com/posts/2trvf5byng7caPsyx/optimal-timing-for-superintelligence-mundane-considerations