Cele mai multe sisteme AI de astăzi sunt bune la generarea răspunsurilor. Ele sunt mult mai puțin fiabile în garantarea acestora.

Pui o întrebare. Modelul răspunde cu încredere. Structura sună logic. Explicația pare completă. Dar sub acel răspuns se află o problemă simplă: s-ar putea să fie greșit.

Această incertitudine este limita invizibilă a sistemelor de cunoștințe ale AI-ului modern.

Informația este generată mai repede decât poate fi validată.

Aici începe Mira să schimbe ecuația.

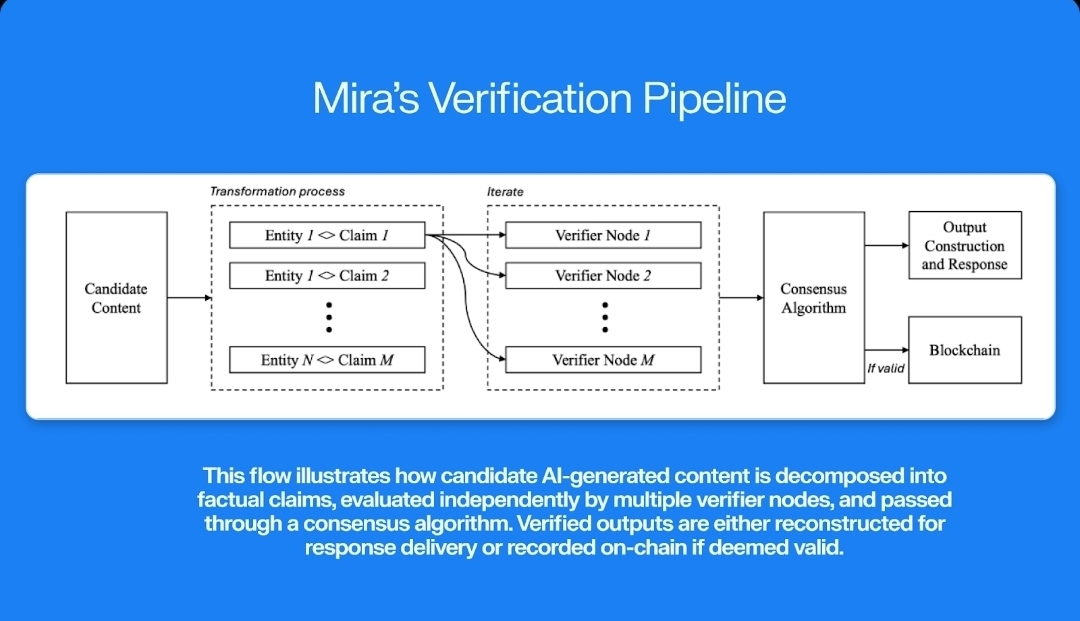

În loc să trateze rezultatele AI-ului ca răspunsuri finalizate, Mira le tratează ca afirmații care necesită verificare. Sistemul descompune conținutul generat în declarații mai mici care pot fi verificate independent într-o rețea descentralizată de validatori.

Acest proces transformă modul în care cunoștințele în sine pot fi structurate.

Graficele tradiționale de cunoștințe stochează relații între entități. Ele cartografiază conexiunile între oameni, locuri, evenimente și concepte într-o structură bazată pe grafice în care nodurile reprezintă entități iar muchiile reprezintă relații.

Dar aceste grafice presupun de obicei că informațiile din interiorul lor sunt deja corecte.

În realitate, cele mai multe grafice de cunoștințe moderne sunt construite din date extrase, input uman sau pipeline-uri de extragere automate. Erorile pot să se propage liniștit prin sistem.

Mira introduce un model diferit.

Înainte ca informația să devină parte a graficului, trebuie să treacă prin verificare.

Fiecare afirmație generată de un model AI poate fi descompusă în afirmații structurate. Aceste afirmații sunt distribuite pe mai multe modele independente sau validatori, care evaluează acuratețea lor și ajung la un consens înainte de a fi acceptate.

Odată validate, aceste afirmații pot fi ancorate ca puncte de date fiabile într-un grafic de cunoștințe.

Rezultatul este un grafic care nu doar stochează relații.

Stochează relații verificate.

Această distincție contează mai mult decât pare.

Într-un sistem normal de cunoștințe AI, informația este probabilistică. Sistemul crede că ceva este probabil adevărat deoarece a văzut modele similare în datele de antrenament.

Într-un grafic de cunoștințe verificat, informația devine trasabilă. Fiecare nod și relație pot purta dovada că afirmația a fost evaluată și acceptată de mai mulți validatori din rețea.

Aceasta schimbă modul în care sistemele AI raționează.

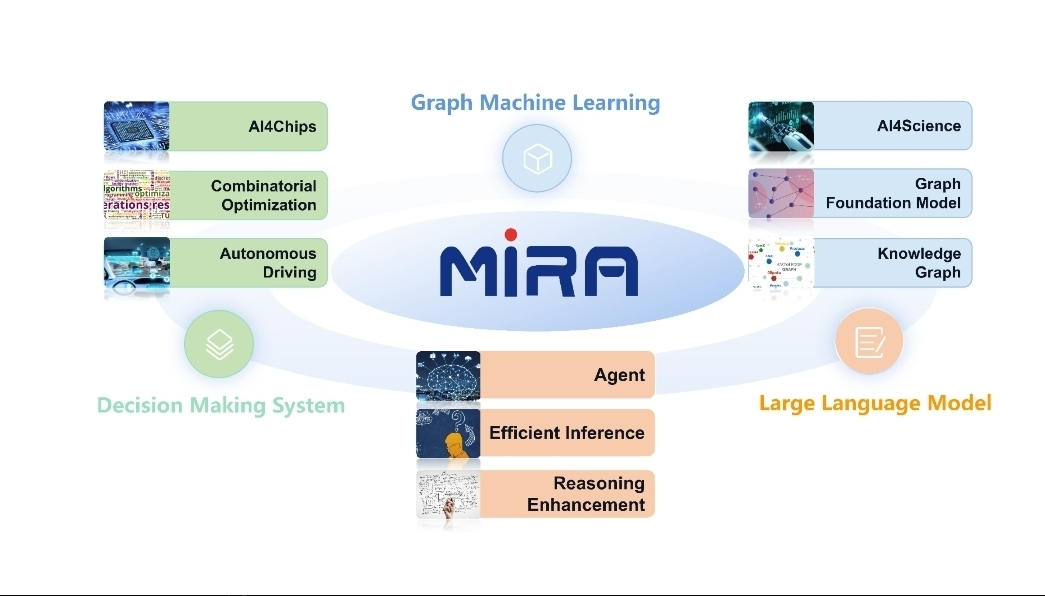

În loc să genereze răspunsuri din probabilități vag legate, modelele pot interoga o hartă structurată de cunoștințe validate.

Raționarea devine mai fiabilă deoarece fundația în sine a fost verificată.

Pentru agenții AI autonomi, acest lucru ar putea fi critic.

Agenții care operează independent au nevoie de o sursă de informații de încredere. Dacă baza lor de cunoștințe conține fapte halucinante sau date inconsistente, deciziile lor pot deveni rapid nesigure.

Un grafic de cunoștințe verificat reduce acel risc.

Agenții pot face referire la afirmații care au fost deja validate de un strat de verificare distribuit, mai degrabă decât să se bazeze pur și simplu pe propriile lor predicții.

În timp, acest lucru creează un ciclu de feedback.

AI generează cunoștințe.

Rețeaua o verifică.

Afirmațiile verificate extind graficul de cunoștințe.

Sistemele AI viitoare interoghează acel grafic pentru a raționa mai precis.

Sistemul devine progresiv mai fiabil pe măsură ce crește.

Aceasta este viziunea mai amplă din spatele straturilor de verificare precum Mira.

Nu doar corectarea halucinațiilor.

Dar construirea infrastructurii pentru cunoștințe de încredere în sine.

Dacă fiecare afirmație dintr-un grafic de cunoștințe AI poartă dovada verificării, informația încetează să mai fie un text efemer produs de un model.

Devine o cunoștință structurată, auditabilă.

Și odată ce cunoștințele devin verificabile, sistemele AI încetează să ghicească atât de des.

Ei încep să raționeze pe baza a ceva mai aproape de adevăr.