Ainda me lembro do momento em que começou a parecer estranho. Eu estava fazendo algo simples—tentando verificar alguém. Nada técnico, nada complicado. Apenas uma pessoa fazendo afirmações sobre suas conquistas. Havia certificados, links, referências. Tudo parecia “certo.”

E ainda assim, algo parecia errado.

Não era que eu achasse que eles estavam mentindo. Era que eu não tinha uma maneira direta de saber se não estavam. Cada peça de prova apontava para algo mais em que eu tinha que confiar. Um nome de universidade. Um logotipo de plataforma. Um sistema de terceiros pedindo silenciosamente para eu acreditar em seu nome.

Foi quando percebi: talvez o problema não seja fraude. Talvez o problema seja que a confiança em si não tem uma propriedade clara.

Eu poderia ter ignorado esse pensamento, mas ele permaneceu. Se a confiança não pertence à pessoa que faz a alegação, então todo o sistema é projetado em torno do empréstimo de credibilidade. E se esse for o caso, então cada interação começa do zero. Cada vez, você reconstrói a crença do zero.

Isso parecia ineficiente, mas mais importante, parecia frágil.

Até então, eu sempre pensei na verificação como um recurso. Algo que as plataformas fornecem. Mas agora começou a parecer mais como uma dependência—algo que tudo o mais silenciosamente depende, mas que ninguém realmente questiona.

Em todo lugar que olhei, era o mesmo padrão. Sua identidade não é algo que você possui; é algo armazenado em outro lugar. Suas conquistas não são suas para apresentar diretamente; elas são mediadas por instituições. E sua reputação? Essa vive em plataformas que você não controla.

Então, naturalmente, a pergunta mudou: como seria se isso não fosse o caso?

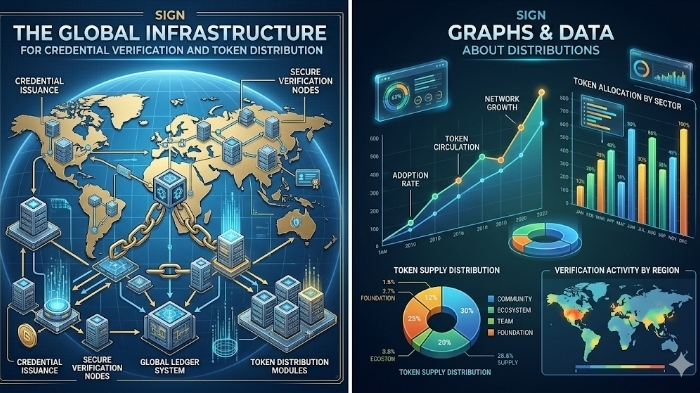

Foi quando eu encontrei algo como o SIGN. À primeira vista, eu presumi que era apenas mais um sistema tentando tornar a verificação mais rápida ou conveniente. Mas quanto mais eu olhava, menos parecia uma plataforma—e mais parecia uma tentativa de redesenhar a camada abaixo das plataformas.

O que chamou minha atenção não foi que ele poderia verificar algo. Foi como ele abordou o ato de reivindicar algo.

Em vez de simplesmente afirmar "isso é válido", isso anexou uma consequência a essa afirmação. Se uma credencial se revelasse falsa, haveria um custo. Um real.

Essa pequena mudança mudou como eu via todo o sistema.

Porque agora, não se tratava apenas de quem diz que algo é verdadeiro. Tratava-se de quem está disposto a correr um risco sobre essa verdade.

Se uma instituição emite uma credencial e a apoia com algum tipo de garantia, então não está apenas emprestando seu nome—está se expondo a perdas. E isso introduz um tipo diferente de responsabilidade. Não reputacional no abstrato, mas econômica em um sentido muito concreto.

Claro, isso levanta outra questão. Quem pode se dar ao luxo de jogar esse jogo?

Se a participação requer apostar valor, então jogadores menores podem ter dificuldade para entrar. Assim, enquanto o sistema pode aumentar a confiabilidade, ele também pode filtrar silenciosamente quem pode participar em primeiro lugar.

Essa tensão é difícil de ignorar.

Ainda assim, continuei seguindo o fio. Se esse modelo funciona, o que realmente muda na prática?

A contratação foi o lugar mais fácil de imaginar isso. Neste momento, a construção de confiança é lenta. Você verifica credenciais, envia e-mails, espera confirmações. Não é apenas tedioso—molda o comportamento. As empresas se tornam seletivas não apenas porque querem, mas porque a verificação em si é cara em tempo e esforço.

Se essa fricção desaparecer, as decisões aceleram. Mas a velocidade não é o único resultado.

Quando algo se torna mais fácil, as pessoas fazem mais disso.

Então talvez as empresas comecem a avaliar mais candidatos. Talvez os indivíduos comecem a se inscrever de forma mais ampla. Talvez o talento global flua um pouco mais livremente. Mas então algo inesperado acontece—se tudo é verificável, então a verificação deixa de ser especial.

Isso se torna a linha de base.

E uma vez que isso acontece, o foco muda novamente. De provar algo uma vez para demonstrar algo continuamente. De credenciais estáticas para reputação evolutiva.

É aí que as coisas começam a ficar mais complicadas.

Porque no momento em que a reputação se torna central, o controle se torna uma preocupação real. Quem define as regras? Quem decide o que conta como válido? O que acontece quando há uma disputa?

Nesse ponto, o sistema deixa de ser puramente técnico. Torna-se político.

A governança entra na equação—não como um acréscimo, mas como uma função central. Regras precisam ser estabelecidas. Exceções precisam ser tratadas. E ao longo do tempo, essas decisões moldam o sistema tanto quanto o design original.

Isso também me fez repensar o papel dos tokens em sistemas como este.

À primeira vista, eles parecem mecanismos de pagamento. Mas quanto mais eu olhava, mais eles pareciam ferramentas comportamentais. Eles influenciam como as pessoas agem, quais riscos elas assumem e quanto estão dispostas a se comprometer.

Mas essa influência corta para os dois lados.

Se os tokens se concentrarem, o controle pode acompanhá-los. Se seu valor oscilar demais, a participação pode se tornar instável. O que começa como um sistema aberto pode lentamente se tornar mais difícil de acessar—não por design, mas como um efeito colateral de seus próprios incentivos.

Não sei se isso é uma falha ou apenas um compromisso inevitável.

O que me traz de volta à pergunta original: um sistema como este simplifica a confiança?

Não tenho certeza se isso acontece. Não remove a confiança—reorganiza-a.

Em vez de confiar diretamente nas instituições, você confia nos incentivos sob os quais elas operam. Em vez de acreditar em declarações, você avalia o risco por trás delas. A confiança se torna menos sobre identidade e mais sobre exposição.

É uma mudança sutil, mas muda como você pensa sobre confiabilidade.

Ainda assim, há muito que ainda não está claro.

Os usuários comuns realmente gerenciariam suas credenciais dessa maneira? As instituições estariam dispostas a arriscar valor por trás de suas alegações? Os processos de governança aguentariam a pressão, especialmente quando os riscos são altos?

Neste momento, essas respostas parecem abertas.

Então, em vez de tentar chegar a uma conclusão, acho mais útil observar o que acontece a seguir.

As pessoas realmente carregam suas credenciais entre sistemas, ou elas voltam a plataformas familiares? As organizações assumem riscos econômicos de bom grado, ou buscam maneiras de contorná-los? Quando surgem conflitos, o sistema os resolve de uma maneira que constrói confiança—ou a erode?

E talvez a pergunta mais interessante de todas:

Se a confiança se tornar algo que podemos quantificar, ela se torna mais confiável… ou apenas mais mensurável?

$SIGN @SignOfficial #SignDigitalSovereignInfra