Ich erinnere mich noch an den Moment, als es anfing, seltsam zu werden. Ich machte etwas Einfaches – versuchte, jemanden zu überprüfen. Nichts Technisches, nichts Kompliziertes. Nur eine Person, die Ansprüche über ihre Erfolge erhob. Es gab Zertifikate, Links, Referenzen. Alles sah "richtig" aus.

Und doch fühlte sich etwas nicht richtig an.

Es war nicht so, dass ich dachte, sie würden lügen. Es war, dass ich keinen direkten Weg hatte, um zu wissen, ob sie es nicht taten. Jedes Stück Beweis deutete auf etwas anderes hin, dem ich vertrauen musste. Ein Universitätsname. Ein Plattform-Logo. Ein Drittanbietersystem, das mich leise bat, ihm im Namen zu glauben.

Da traf es mich: Vielleicht ist das Problem nicht Betrug. Vielleicht ist das Problem, dass Vertrauen selbst keine klare Eigentümerschaft hat.

Ich hätte diesen Gedanken ignorieren können, aber er blieb. Wenn Vertrauen nicht der Person gehört, die die Behauptung aufstellt, dann ist das gesamte System darauf ausgelegt, Glaubwürdigkeit zu leihen. Und wenn das der Fall ist, dann beginnt jede Interaktion bei Null. Jedes Mal baust du den Glauben von Grund auf neu auf.

Das fühlte sich ineffizient an, aber noch wichtiger war, dass es sich fragil anfühlte.

Bis zu diesem Zeitpunkt hatte ich Verifizierung immer als eine Funktion betrachtet. Etwas, das Plattformen bereitstellen. Aber jetzt begann es mehr wie eine Abhängigkeit auszusehen – etwas, auf das alles andere stillschweigend angewiesen ist, aber was niemand wirklich hinterfragt.

Überall, wo ich hinsah, war es dasselbe Muster. Deine Identität ist nichts, was du hältst; es ist etwas, das irgendwo anders gespeichert ist. Deine Erfolge sind nicht direkt deine, sie werden durch Institutionen vermittelt. Und dein Ruf? Der lebt auf Plattformen, die du nicht kontrollierst.

Also verschob sich natürlich die Frage: Wie würde es aussehen, wenn dies nicht der Fall wäre?

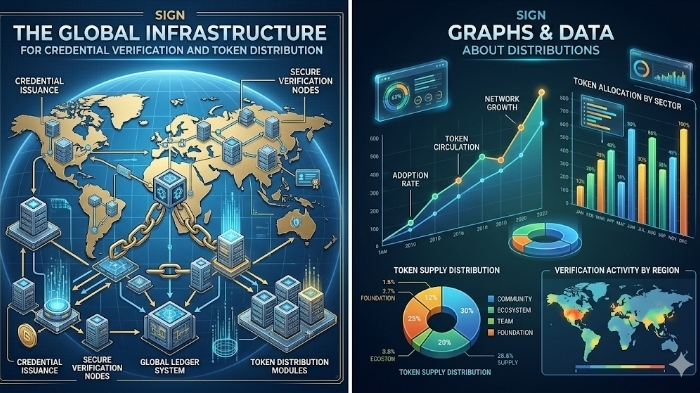

Da kam ich auf etwas wie SIGN. Zunächst nahm ich an, es sei nur ein weiteres System, das versuchte, die Verifizierung schneller oder bequemer zu machen. Aber je mehr ich darüber nachdachte, desto weniger fühlte es sich wie eine Plattform an – und desto mehr wie ein Versuch, die Schicht unter den Plattformen neu zu gestalten.

Was meine Aufmerksamkeit erregte, war nicht, dass es etwas verifizieren konnte. Es war, wie es den Akt des Beanspruchens von etwas angeht.

Anstatt einfach zu sagen „dies ist gültig“, wurde eine Konsequenz an diese Aussage angehängt. Wenn sich herausstellt, dass eine Anmeldeinformation falsch war, würde es Kosten verursachen. Echte.

Diese kleine Verschiebung änderte, wie ich das gesamte System sah.

Denn jetzt ging es nicht nur darum, wer etwas als wahr bezeichnet. Es ging darum, wer bereit ist, ein Risiko für diese Wahrheit einzugehen.

Wenn eine Institution eine Anmeldeinformation ausstellt und sie mit einer Art von Einsatz absichert, dann leiht sie nicht nur ihren Namen – sie setzt sich selbst einem Verlust aus. Und das führt zu einer anderen Art von Verantwortung. Nicht reputationsbasiert im Abstrakten, sondern wirtschaftlich in einem sehr konkreten Sinn.

Natürlich wirft das eine weitere Frage auf. Wer kann sich leisten, dieses Spiel zu spielen?

Wenn die Teilnahme das Staken von Werten erfordert, könnten kleinere Akteure Schwierigkeiten haben, einzutreten. Während das System also die Zuverlässigkeit erhöhen könnte, könnte es auch stillschweigend filtern, wer überhaupt teilnehmen darf.

Diese Spannung ist schwer zu ignorieren.

Dennoch folgte ich dem Faden weiter. Wenn dieses Modell funktioniert, was ändert es in der Praxis tatsächlich?

Einstellungen waren der einfachste Ort, um es sich vorzustellen. Im Moment ist der Vertrauensaufbau langsam. Man überprüft Anmeldeinformationen, sendet E-Mails, wartet auf Bestätigungen. Es ist nicht nur mühsam – es prägt das Verhalten. Unternehmen werden selektiv, nicht nur weil sie es wollen, sondern weil die Verifizierung selbst teuer in Zeit und Mühe ist.

Wenn diese Reibung verschwindet, beschleunigen sich die Entscheidungen. Aber Geschwindigkeit ist nicht das einzige Ergebnis.

Wenn etwas einfacher wird, machen die Menschen mehr davon.

Vielleicht beginnen Unternehmen, mehr Kandidaten zu bewerten. Vielleicht beginnen Einzelpersonen, breiter zu bewerben. Vielleicht fließt globales Talent etwas freier. Aber dann passiert etwas Unerwartetes – wenn alles verifizierbar ist, hört die Verifizierung auf, etwas Besonderes zu sein.

Es wird zur Basislinie.

Und sobald das passiert, verschiebt sich der Fokus wieder. Vom einmaligen Beweisen von etwas zum kontinuierlichen Demonstrieren von etwas. Von statischen Anmeldeinformationen zu sich entwickelndem Ruf.

Hier fangen die Dinge an, komplizierter zu werden.

Denn in dem Moment, in dem der Ruf zentral wird, wird Kontrolle zu einer echten Sorge. Wer definiert die Regeln? Wer entscheidet, was als gültig zählt? Was passiert, wenn es zu einem Streit kommt?

An diesem Punkt hört das System auf, rein technisch zu sein. Es wird politisch.

Governance tritt ins Bild – nicht als Zusatz, sondern als zentrale Funktion. Regeln müssen aufgestellt werden. Ausnahmen müssen behandelt werden. Und im Laufe der Zeit formen diese Entscheidungen das System ebenso stark wie das ursprüngliche Design.

Es ließ mich auch die Rolle von Tokens in Systemen wie diesen überdenken.

Auf den ersten Blick sehen sie wie Zahlungsmethoden aus. Aber je tiefer ich schaute, desto mehr schienen sie wie Verhaltenstools. Sie beeinflussen, wie Menschen handeln, welche Risiken sie eingehen und wie viel sie bereit sind, sich zu engagieren.

Aber dieser Einfluss wirkt in beide Richtungen.

Wenn Tokens konzentriert werden, könnte die Kontrolle folgen. Wenn ihr Wert zu stark schwankt, könnte die Teilnahme instabil werden. Was als offenes System beginnt, könnte langsam schwerer zugänglich werden – nicht absichtlich, sondern als Nebenwirkung seiner eigenen Anreize.

Ich weiß nicht, ob das ein Mangel oder einfach ein unvermeidlicher Kompromiss ist.

Was mich zurück zur ursprünglichen Frage bringt: Vereinfacht ein System wie dieses das Vertrauen?

Ich bin mir nicht sicher, ob das so ist. Es entfernt nicht das Vertrauen – es ordnet es neu.

Anstatt Institutionen direkt zu vertrauen, vertraust du den Anreizen, unter denen sie operieren. Anstatt Aussagen zu glauben, bewertest du das Risiko dahinter. Vertrauen wird weniger zu einer Frage der Identität und mehr zu einer Frage der Exposition.

Es ist eine subtile Verschiebung, aber sie ändert die Art und Weise, wie du über Zuverlässigkeit nachdenkst.

Dennoch gibt es noch viel, was nicht klar ist.

Würden alltägliche Benutzer ihre Anmeldeinformationen tatsächlich auf diese Weise verwalten? Würden Institutionen bereit sein, ständig Werte hinter ihren Behauptungen zu riskieren? Würden Governance-Prozesse unter Druck standhalten, besonders wenn die Einsätze hoch sind?

Im Moment fühlen sich diese Antworten offen an.

Anstatt also zu versuchen, zu einem Schluss zu kommen, finde ich es nützlicher, zu beobachten, was als Nächstes passiert.

Tragen die Menschen tatsächlich ihre Anmeldeinformationen über Systeme hinweg, oder fallen sie auf vertraute Plattformen zurück? Übernehmen Organisationen bereitwillig wirtschaftliches Risiko, oder suchen sie nach Wegen, es zu umgehen? Wenn Konflikte auftreten, löst das System sie auf eine Weise, die Vertrauen aufbaut – oder es untergräbt?

Und vielleicht die interessanteste Frage von allen:

Wenn Vertrauen etwas wird, das wir quantifizieren können, wird es dann zuverlässiger… oder einfach nur messbarer?

$SIGN @SignOfficial #SignDigitalSovereignInfra