Die meisten KI-Systeme heute können Ausgaben mit beeindruckender Geschwindigkeit erzeugen, aber nur sehr wenige können die Integrität dieser Ausgaben in einer gemeinsamen Umgebung erklären, validieren oder beweisen. Zunächst scheint dies kein kritischer Fehler zu sein. Schließlich, wenn ein System funktioniert, funktioniert es. Aber in dem Moment, in dem mehrere autonome Agenten beginnen zu interagieren – Aufgaben zu teilen, Entscheidungen zu treffen, Aktionen zu koordinieren – wird diese Lücke unmöglich zu ignorieren. Intelligenz allein reicht nicht aus. Ohne Überprüfbarkeit wird Intelligenz unvorhersehbar, und Unvorhersehbarkeit im großen Maßstab wird zum Risiko.

Denken Sie darüber nach, wie Menschen zusammenarbeiten. Vertrauen ist selten blind. Es wird durch gemeinsame Regeln, Verantwortlichkeit und die Fähigkeit, Aktionen zu überprüfen, aufgebaut. Stellen Sie sich nun ein Netzwerk von Maschinen vor, das ohne diese gleichen Garantien arbeitet. Jeder Agent kann einzeln fähig sein, aber gemeinsam fehlt ihnen eine gemeinsame Wahrheitsschicht. Ein Roboter schließt eine Aufgabe ab, ein anderer baut darauf auf, ein dritter ist darauf angewiesen – aber keiner kann unabhängig überprüfen, ob die ursprüngliche Aktion korrekt ausgeführt wurde. Dies ist nicht nur eine technische Einschränkung; es ist ein Koordinationsversagen, das darauf wartet, zu passieren.

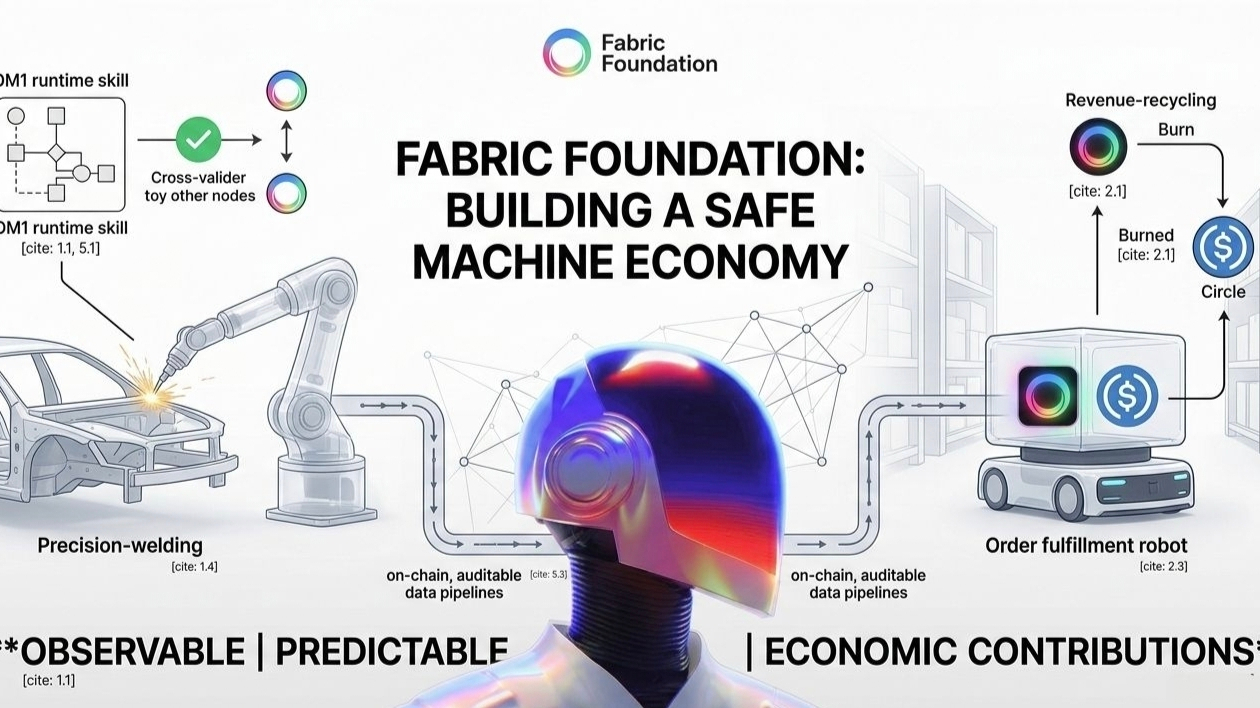

Die Fabric Foundation nähert sich diesem Problem aus einer Perspektive, die sowohl einfach als auch tief strukturell ist: Autonome Systeme benötigen nicht nur Intelligenz, sie benötigen ein gemeinsames System der Verifizierung. Die Idee hinter c-19 ist nicht, Maschinen isoliert intelligenter zu machen, sondern sie vertrauenswürdig in der Koordination zu gestalten. Diese Unterscheidung verändert das gesamte Gespräch. Anstatt sich rein auf die Fähigkeit zu konzentrieren, verlagert sich der Fokus auf Zuverlässigkeit, Ausrichtung und Nachweisbarkeit.

Im Kern des Fabric-Protokolls steht das Konzept der überprüfbaren Berechnung, das an ein öffentliches Hauptbuch gebunden ist. Das bedeutet, dass Aktionen, die von Maschinen durchgeführt werden – ob sie Datenverarbeitung, Entscheidungsfindung oder physische Ausführung betreffen – aufgezeichnet, validiert und von anderen Agenten im Netzwerk referenziert werden können. Das Ergebnis ist nicht nur eine Sammlung autonomer Systeme, sondern ein koordiniertes Ökosystem, in dem die Aktionen in ihrer Logik transparent sind, auch wenn nicht in Rohdaten. Maschinen operieren nicht mehr in Silos; sie nehmen an einer gemeinsamen, überprüfbaren Umgebung teil.

Hier beginnt es interessant zu werden. Denn sobald Maschinen die Aktionen der anderen überprüfen können, beginnt die Koordination in grundlegend anderer Weise zu skalieren. Anstatt auf zentrale Aufsicht oder blinden Vertrauen angewiesen zu sein, können Systeme unabhängig die Integrität der Prozesse bestätigen, von denen sie abhängen. Dies verringert Reibungen, minimiert Fehlerfortpflanzung und schafft eine Grundlage, auf der komplexe, multi-agenten Arbeitsabläufe möglich werden. Praktisch bedeutet das, dass Roboter Aufgaben ohne ständige menschliche Intervention gemeinsam erledigen können, während sie dennoch ein hohes Maß an Verantwortlichkeit wahren.

Stellen Sie sich ein Szenario vor, in dem mehrere Roboter in einer Lieferkettenoperation beteiligt sind. Ein System kümmert sich um das Sortieren, ein anderes verwaltet den Transport, und ein drittes überwacht die Qualitätskontrolle. In einem traditionellen Setup erfordert die Überprüfung jedes Schrittes externe Überwachung oder zentrale Koordination. Mit dem Ansatz von Fabric kann jede Aktion kryptografisch bewiesen und vom nächsten System in der Kette validiert werden. Der Transportroboter geht nicht einfach davon aus, dass das Sortieren korrekt durchgeführt wurde – er überprüft es. Das Qualitätssicherungssystem verlässt sich nicht auf Vertrauen – es überprüft den Beweis. Dies verwandelt die Koordination von einer Annahme-basierten in eine Nachweis-basierte.

Die Auswirkungen gehen weit über die Logistik hinaus. In Umgebungen wie der Gesundheitsrobotik, autonomen Fahrzeugen oder der industriellen Automatisierung können die Kosten unüberprüfter Aktionen erheblich sein. Eine einzige falsche Entscheidung, wenn sie unbeaufsichtigt bleibt, kann durch das System kaskadieren. Fabric führt ein Modell ein, in dem jeder Schritt in einem Prozess in überprüfbarer Berechnung verankert ist, wodurch die Wahrscheinlichkeit eines systemischen Fehlers verringert wird. Es geht nicht darum, Fehler vollständig zu beseitigen – das ist unrealistisch – sondern darum, sicherzustellen, dass Fehler erkannt, zurückverfolgt und eingedämmt werden können.

Es gibt auch eine breitere philosophische Ebene zu diesem Ansatz. Während Maschinen autonomer werden, beginnt sich die Natur des Vertrauens selbst zu verschieben. Traditionell wurde Vertrauen in Institutionen, Betreiber oder zentrale Systeme gesetzt. In dezentralen Umgebungen wird dieses Vertrauen umverteilt, aber nicht immer klar definiert. Fabric scheint zu suggerieren, dass Vertrauen nicht abstrakt oder angenommen werden sollte – es sollte programmierbar sein. Durch die Einbettung von Verifizierung in die Infrastruktur wird Vertrauen zu etwas, das aus dem System selbst entsteht, anstatt etwas, das von außen auferlegt wird.

Hier wird die Verbindung zu Web3 deutlicher. Die Blockchain-Technologie führte die Idee eines gemeinsamen Hauptbuchs für finanzielle Transaktionen ein, aber ihr zugrunde liegendes Prinzip – überprüfbare, dezentrale Koordination – geht weit über die Finanzen hinaus. Fabric wendet dieses Prinzip auf Maschinennetzwerke an und schafft eine Schicht, in der Daten, Berechnung und Governance sich überschneiden. Es geht nicht nur darum, aufzuzeichnen, was passiert ist; es geht darum, sicherzustellen, dass das, was passiert ist, von jedem Teilnehmer im Netzwerk unabhängig überprüft werden kann.

Die Rolle von $ROBO innerhalb dieses Ökosystems spiegelt dieses architektonische Denken wider. Anstatt rein als transaktionales Asset positioniert zu werden, existiert es innerhalb eines Systems, das darauf ausgelegt ist, die Koordination und Verifizierung zwischen autonomen Agenten zu erleichtern. Dies bringt den Token näher an die Funktionsweise des Netzwerks selbst, anstatt an externe Spekulationen. Es wird Teil eines breiteren Mechanismus, der Interaktion, Validierung und Teilnahme innerhalb der Fabric-Umgebung unterstützt.

Ein weiterer wichtiger Aspekt ist die modulare Natur der Infrastruktur. Fabric geht nicht von einem Einheitsansatz für Robotik oder autonome Systeme aus. Stattdessen bietet es einen Rahmen, der sich an verschiedene Anwendungsfälle anpassen lässt, sodass Entwickler und Organisationen Lösungen entwickeln können, die auf ihre spezifischen Bedürfnisse zugeschnitten sind. Diese Flexibilität ist entscheidend, denn die Anforderungen an ein Robotersystem in der Fertigung sind sehr unterschiedlich von denen im Gesundheitswesen oder in der Logistik. Durch die Beibehaltung der Infrastruktur als modular wird eine breitere Palette von Anwendungen ermöglicht, ohne starre Einschränkungen aufzuzwingen.

Aus der Perspektive eines Entwicklers eröffnet dies neue Möglichkeiten. Der Bau autonomer Systeme dreht sich nicht mehr nur um die Optimierung von Leistung oder Genauigkeit; es geht darum, diese Systeme in ein Netzwerk zu integrieren, in dem ihre Aktionen überprüft und koordiniert werden können. Dies verändert, wie Systeme von Grund auf entworfen werden. Anstatt in isolierten Funktionen zu denken, beginnen Entwickler, in Begriffen interoperabler Agenten zu denken, die innerhalb eines gemeinsamen Rahmens des Vertrauens operieren.

Es gibt auch einen subtilen, aber wichtigen Wandel in der Art und Weise, wie Menschen in diesem Modell mit Maschinen interagieren. Vertrauen in die Automatisierung war schon immer eine Herausforderung. Menschen sind bereit, Systeme zu nutzen, die sie verstehen, aber wenn Systeme komplexer werden, wird das Verständnis schwieriger. Der Ansatz von Fabric bietet eine Alternative: Anstatt von den Benutzern zu verlangen, jedes Detail eines Systems zu verstehen, bietet er eine Möglichkeit zu überprüfen, ob das System korrekt funktioniert. Dies verringert die kognitive Belastung für die Benutzer, während das Vertrauen in die Ergebnisse des Systems aufrechterhalten wird.

Während sich die Welt auf zunehmend autonome Umgebungen zubewegt, wird die Frage der Koordination dringlicher. Es reicht nicht aus, dass Maschinen intelligent sind – sie müssen ausgerichtet sein. Sie müssen innerhalb von Rahmenbedingungen operieren, die sicherstellen, dass ihre Aktionen konsistent, überprüfbar und verantwortlich sind. Die Fabric Foundation scheint zu erkennen, dass dies kein später hinzuzufügendes Merkmal ist, sondern eine Anforderung, die von Anfang an in die Grundlage eingebaut werden muss.

In diesem Sinne ist die echte Innovation hinter $ROBO nicht nur technologisch, sondern konzeptionell. Sie reformuliert das Problem der Autonomie von einer Frage der Fähigkeit zu einer Frage der Koordination. Sie schlägt vor, dass die Zukunft intelligenter Systeme nicht durch die Leistungsfähigkeit einzelner Agenten definiert wird, sondern durch die Effektivität, mit der sie innerhalb einer vertrauenswürdigen Umgebung zusammenarbeiten können.

Und das führt zu einer tiefergehenden Frage. Wenn Maschinen Entscheidungen treffen sollen, die reale Ergebnisse beeinflussen, wem – oder was – vertrauen wir? Ist es das individuelle System, die Organisation dahinter oder das Netzwerk, in dem es operiert? Die Antwort von Fabric scheint das Netzwerk selbst zu sein – ein System, in dem Vertrauen nicht angenommen, sondern kontinuierlich überprüft wird.

Wenn autonome Maschinen die Integrität ihrer Aktionen nicht beweisen können, wird ihre Intelligenz immer mit Unsicherheit behaftet sein. Wenn sie es jedoch können, verschiebt sich etwas. Vertrauen wird weniger zu einer Frage des Glaubens und mehr zu einer Frage des Beweises. Und in einer Welt, die zunehmend von autonomen Systemen geprägt ist, könnte diese Unterscheidung alles definieren, was folgt.