"Dziwny wzór, który zauważyłem podczas oglądania narzędzi AI"

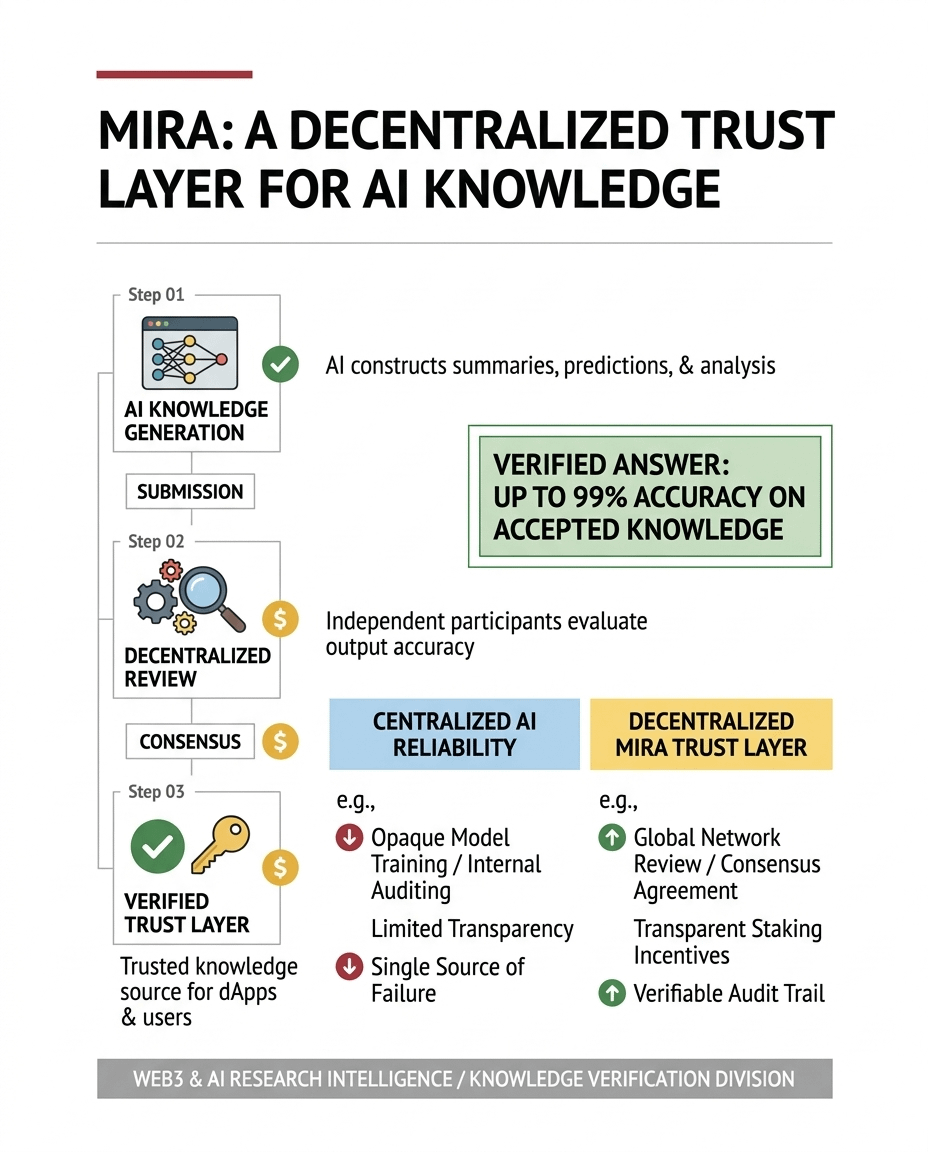

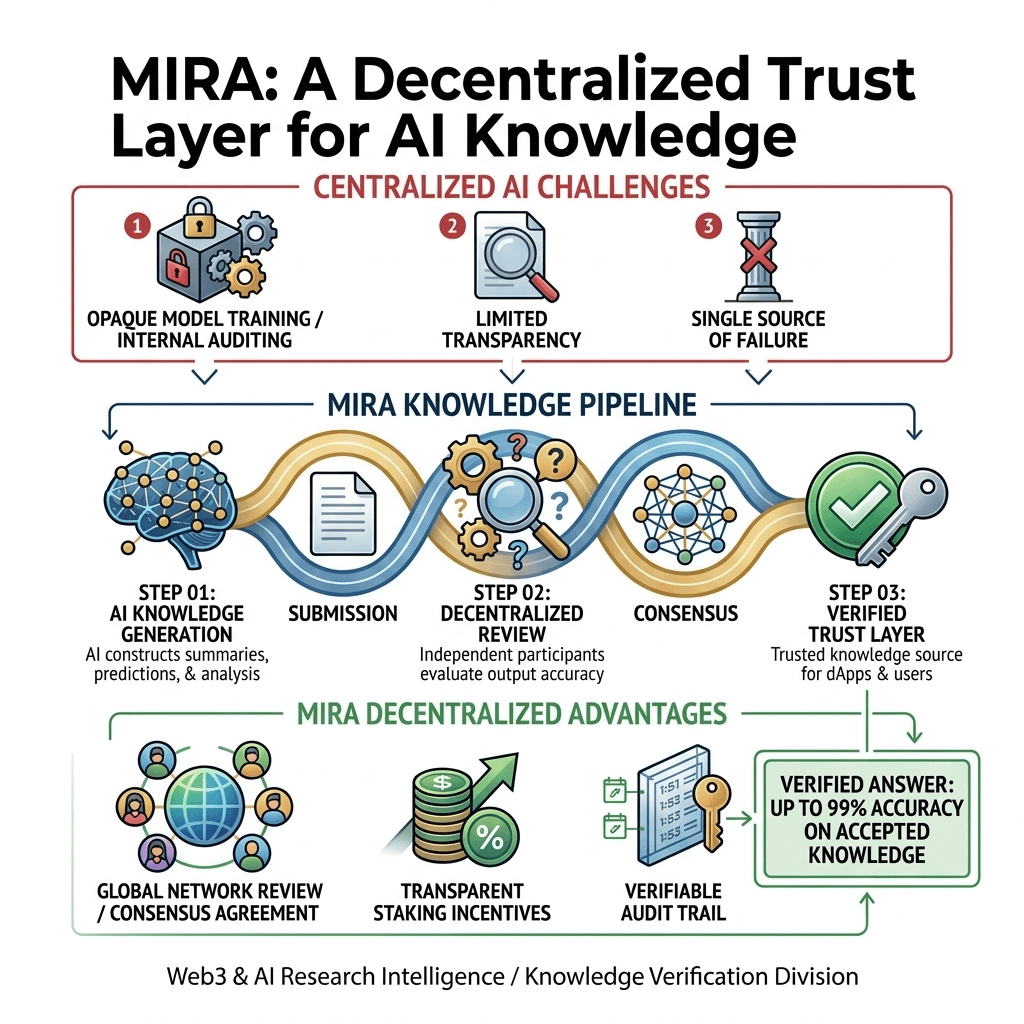

Dziś wcześniej porównywałem kilka narzędzi AI, które podsumowują badania nad kryptowalutami. Lubię ich używać do szybkiego skanowania długich propozycji dotyczących zarządzania lub dokumentów technicznych. Oszczędza czas. Ale coś dziwnego wciąż się dzieje. Odpowiedzi często wyglądają na niezwykle dopracowane… a jednak, gdy podwójnie sprawdzam oryginalne dane, czasami mały szczegół jest nieco inny. Nie całkowicie błędny, po prostu wystarczająco, aby zmienić znaczenie wniosku. Przeglądając później posty kampanii CreatorPad na Binance Square tego dnia, zobaczyłem ludzi dyskutujących o Mirze. I nagle pomysł stał się dla mnie jasny. Projekt nie próbuje uczynić AI mądrzejszym. Próbują sprawić, by odpowiedzi AI były wiarygodne. Dlaczego AI potrzebuje warstwy zaufania Modele AI generują informacje nieustannie: podsumowania, prognozy, sygnały handlowe, wyjaśnienia dotyczące zarządzania, cokolwiek chcesz. W systemach scentralizowanych firma prowadząca model działa jako warstwa niezawodności. Filtrują wyniki, poprawiają dane treningowe i cicho korygują błędy. Środowiska Web3 nie mają naprawdę tego luksusu. Jeśli aplikacje zdecentralizowane zaczną polegać na odpowiedziach generowanych przez AI — czy to do analizy rynku, automatycznych agentów, czy badań nad zarządzaniem — musi istnieć sposób na weryfikację tych odpowiedzi, zanim system uzna je za wiarygodne. W przeciwnym razie jedna błędna odpowiedź z modelu może wpłynąć na tysiące użytkowników. W tym miejscu pomysł Miry staje się interesujący. Zamiast zakładać, że AI jest poprawne, protokół buduje sieć weryfikacyjną wokół samego wyniku. Podstawowa architektura stojąca za Mirą. Przeglądając odniesienia w dokumentacji i wątki CreatorPad, Mira strukturyzuje swój system wokół dwóch warstw. Pierwsza to warstwa generacyjna. Modele AI produkują odpowiedzi, rozumowanie lub analizy danych. Ale te odpowiedzi nie stają się od razu zaufane. Zamiast tego przechodzą do warstwy weryfikacyjnej, gdzie niezależni uczestnicy oceniają wynik, zanim stanie się on akceptowaną informacją.

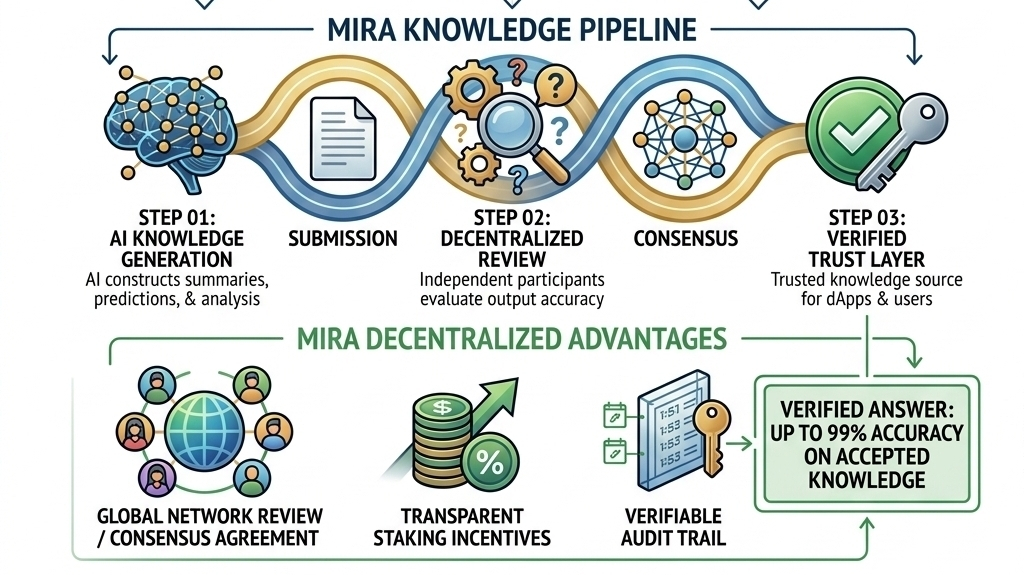

Proces wygląda mniej więcej tak:

Model AI → Zgłoszenie wyjścia → Runda weryfikacyjna → Zgoda na konsensus → Zweryfikowana odpowiedź Podczas czytania o tym, rzeczywiście naszkicowałem szybki schemat przepływu pracy w moich notatkach, ponieważ przypomniało mi to o liniach walidacyjnych blockchainów. Zamiast weryfikować transakcje finansowe, sieć weryfikuje wiedzę generowaną przez maszyny. Ta zmiana wpływa na to, jak działa zaufanie w systemach AI. Dlaczego zdecentralizowana weryfikacja ma znaczenie. Jednym z wniosków, które ciągle się pojawiały w dyskusjach CreatorPad, jest to, że niezawodność AI nie jest czysto problemem technicznym. To problem koordynacji ekonomicznej. Jeśli nikt nie ma zachęty do starannego przeglądu wyników AI, weryfikacja staje się niespójna. Niektóre odpowiedzi są sprawdzane, inne umykają. Mira radzi sobie z tym, wprowadzając zachęty dla uczestników, którzy weryfikują wyniki. Weryfikatorzy stakują tokeny, oceniając odpowiedzi AI. Jeśli ich ocena zgadza się z ostatecznym konsensusem sieci, otrzymują nagrody. Jeśli się mylą, ryzykują utratę części swojego staku. Zamiast polegać na zaufaniu, system polega na zharmonizowanych zachętach. To ta sama zasada ekonomiczna, która utrzymuje uczciwość weryfikatorów blockchaina. Gdzie to może mieć znaczenie w Web3. Podczas czytania dyskusji Binance Square na temat Mira, ciągle wyobrażałem sobie, jak to może działać z narzędziami DeFi. Niektóre platformy już eksperymentują z agentami AI, którzy analizują warunki rynkowe lub sugerują strategie płynności. Jeśli te systemy AI generują błędne rozumowanie, użytkownicy mogą podejmować decyzje finansowe na podstawie błędnych informacji. Z warstwą weryfikacyjną, te wyniki przechodziłyby przez przegląd sieci, zanim wpłynęłyby na aplikacje. Wiele uczestników oceniłoby rozumowanie. Dopiero po osiągnięciu zgody odpowiedź stałaby się zaufana. Ten dodatkowy punkt kontrolny może brzmieć mało, ale redukuje ogromne założenie zaufania w zautomatyzowanych systemach. Wady związane z modelem. Oczywiście, budowanie takiej warstwy zaufania nie jest proste. Sama weryfikacja może być trudna. Niektóre wyniki AI zawierają stwierdzenia faktograficzne, które są łatwe do potwierdzenia.

Podczas czytania o tym, rzeczywiście naszkicowałem szybki schemat przepływu pracy w moich notatkach, ponieważ przypomniało mi to o liniach walidacyjnych blockchainów. Zamiast weryfikować transakcje finansowe, sieć weryfikuje wiedzę generowaną przez maszyny. Ta zmiana wpływa na to, jak działa zaufanie w systemach AI. Dlaczego zdecentralizowana weryfikacja ma znaczenie. Jednym z wniosków, które ciągle się pojawiały w dyskusjach CreatorPad, jest to, że niezawodność AI nie jest czysto problemem technicznym. To problem koordynacji ekonomicznej. Jeśli nikt nie ma zachęty do starannego przeglądu wyników AI, weryfikacja staje się niespójna. Niektóre odpowiedzi są sprawdzane, inne umykają. Mira radzi sobie z tym, wprowadzając zachęty dla uczestników, którzy weryfikują wyniki. Weryfikatorzy stakują tokeny, oceniając odpowiedzi AI. Jeśli ich ocena zgadza się z ostatecznym konsensusem sieci, otrzymują nagrody. Jeśli się mylą, ryzykują utratę części swojego staku. Zamiast polegać na zaufaniu, system polega na zharmonizowanych zachętach. To ta sama zasada ekonomiczna, która utrzymuje uczciwość weryfikatorów blockchaina. Gdzie to może mieć znaczenie w Web3. Podczas czytania dyskusji Binance Square na temat Mira, ciągle wyobrażałem sobie, jak to może działać z narzędziami DeFi. Niektóre platformy już eksperymentują z agentami AI, którzy analizują warunki rynkowe lub sugerują strategie płynności. Jeśli te systemy AI generują błędne rozumowanie, użytkownicy mogą podejmować decyzje finansowe na podstawie błędnych informacji. Z warstwą weryfikacyjną, te wyniki przechodziłyby przez przegląd sieci, zanim wpłynęłyby na aplikacje. Wiele uczestników oceniłoby rozumowanie. Dopiero po osiągnięciu zgody odpowiedź stałaby się zaufana. Ten dodatkowy punkt kontrolny może brzmieć mało, ale redukuje ogromne założenie zaufania w zautomatyzowanych systemach. Wady związane z modelem. Oczywiście, budowanie takiej warstwy zaufania nie jest proste. Sama weryfikacja może być trudna. Niektóre wyniki AI zawierają stwierdzenia faktograficzne, które są łatwe do potwierdzenia.

Inni polegają na rozumowaniu, prognozach lub subiektywnej interpretacji. Projektowanie sprawiedliwych kryteriów oceny będzie skomplikowane. Szybkość to kolejna wyzwanie. Systemy AI często produkują odpowiedzi natychmiast, ale rundy weryfikacyjne wprowadzają opóźnienia, zanim wyniki staną się zaakceptowane. Istnieje również ryzyko problemów z koordynacją. Weryfikatorzy muszą dostarczać niezależne oceny, a nie po prostu podążać za sygnałami konsensusu. Te wyzwania nie unieważniają pomysłu. Ale pokazują, jak skomplikowane mogą być zdecentralizowane systemy zaufania. Dlaczego rozmowy CreatorPad wokół Mira wydają się inne. Po spędzeniu kilku godzin na czytaniu postów kampanijnych CreatorPad, zauważyłem coś interesującego. Większość dyskusji kryptograficznych kręci się wokół spekulacji tokenów lub krótkoterminowych narracji. Rozmowy Mira wydawały się inne. Ludzie rozmawiali o niezawodności informacji, zachętach do weryfikacji i o tym, jak odpowiedzi AI mogą być weryfikowane w sieciach zdecentralizowanych. To znacznie głębsze pytanie infrastrukturalne. Większy pomysł za Mira. Blockchainy przekształciły finanse, wprowadzając zdecentralizowany konsensus dla transakcji. Mira bada, czy coś podobnego może się zdarzyć w przypadku informacji generowanych przez AI. Zamiast ufać dostawcy modelu, sieć wspólnie weryfikuje, czy odpowiedź AI jest wiarygodna. Jeśli to podejście zadziała, może stworzyć zupełnie nową rolę w ekosystemie kryptograficznym: uczestników, którzy zarabiają nagrody za weryfikację wiedzy generowanej przez maszyny. To skutecznie przekształciłoby samo zaufanie w zdecentralizowaną usługę sieciową. Czy Mira stanie się dominującym protokołem dla tego pomysłu, pozostaje do zobaczenia. Ale koncepcja, którą eksperymentuje, wydaje się ważna. Ponieważ w miarę jak systemy AI generują coraz więcej odpowiedzi w Web3, prawdziwe pytanie może nie dotyczyć tego, jak inteligentne są te systemy. Może chodzić o to, jak weryfikujemy odpowiedzi, które produkują.

Inni polegają na rozumowaniu, prognozach lub subiektywnej interpretacji. Projektowanie sprawiedliwych kryteriów oceny będzie skomplikowane. Szybkość to kolejna wyzwanie. Systemy AI często produkują odpowiedzi natychmiast, ale rundy weryfikacyjne wprowadzają opóźnienia, zanim wyniki staną się zaakceptowane. Istnieje również ryzyko problemów z koordynacją. Weryfikatorzy muszą dostarczać niezależne oceny, a nie po prostu podążać za sygnałami konsensusu. Te wyzwania nie unieważniają pomysłu. Ale pokazują, jak skomplikowane mogą być zdecentralizowane systemy zaufania. Dlaczego rozmowy CreatorPad wokół Mira wydają się inne. Po spędzeniu kilku godzin na czytaniu postów kampanijnych CreatorPad, zauważyłem coś interesującego. Większość dyskusji kryptograficznych kręci się wokół spekulacji tokenów lub krótkoterminowych narracji. Rozmowy Mira wydawały się inne. Ludzie rozmawiali o niezawodności informacji, zachętach do weryfikacji i o tym, jak odpowiedzi AI mogą być weryfikowane w sieciach zdecentralizowanych. To znacznie głębsze pytanie infrastrukturalne. Większy pomysł za Mira. Blockchainy przekształciły finanse, wprowadzając zdecentralizowany konsensus dla transakcji. Mira bada, czy coś podobnego może się zdarzyć w przypadku informacji generowanych przez AI. Zamiast ufać dostawcy modelu, sieć wspólnie weryfikuje, czy odpowiedź AI jest wiarygodna. Jeśli to podejście zadziała, może stworzyć zupełnie nową rolę w ekosystemie kryptograficznym: uczestników, którzy zarabiają nagrody za weryfikację wiedzy generowanej przez maszyny. To skutecznie przekształciłoby samo zaufanie w zdecentralizowaną usługę sieciową. Czy Mira stanie się dominującym protokołem dla tego pomysłu, pozostaje do zobaczenia. Ale koncepcja, którą eksperymentuje, wydaje się ważna. Ponieważ w miarę jak systemy AI generują coraz więcej odpowiedzi w Web3, prawdziwe pytanie może nie dotyczyć tego, jak inteligentne są te systemy. Może chodzić o to, jak weryfikujemy odpowiedzi, które produkują.

#Mira $MIRA $BULLA $PIXEL #LearnWithFatima #MarketSentimentToday #creatorpad #TrendingTopic