Dziś wcześniej przeglądałem notatki na temat różnych projektów AI i coś ciągle przychodziło mi na myśl: AI staje się niesamowicie potężne. Zadajesz mu złożone pytanie, a ono odpowiada natychmiast. Ale wciąż istnieje luka.

Ufamy odpowiedziom bardziej niż je weryfikujemy.

To jest wyzwanie, które wydaje się podejmować Mira Network. MIRA

Traktowanie odpowiedzi AI jak roszczeń

Jedna rzecz, która naprawdę mnie uderzyła w Mira, to jak traktują „wyniki AI”. Zamiast postrzegać odpowiedź od AI jako ostateczną odpowiedź, Mira traktuje to bardziej jak roszczenie, które wymaga weryfikacji.

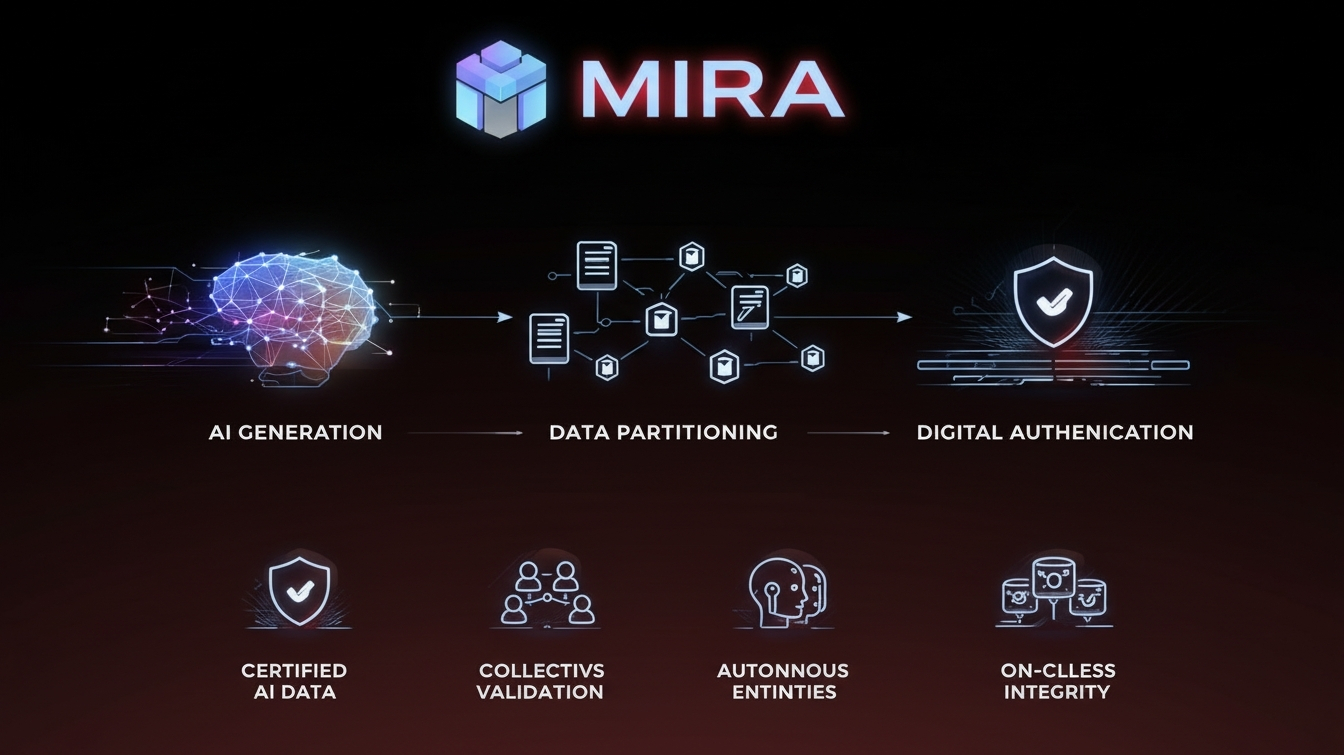

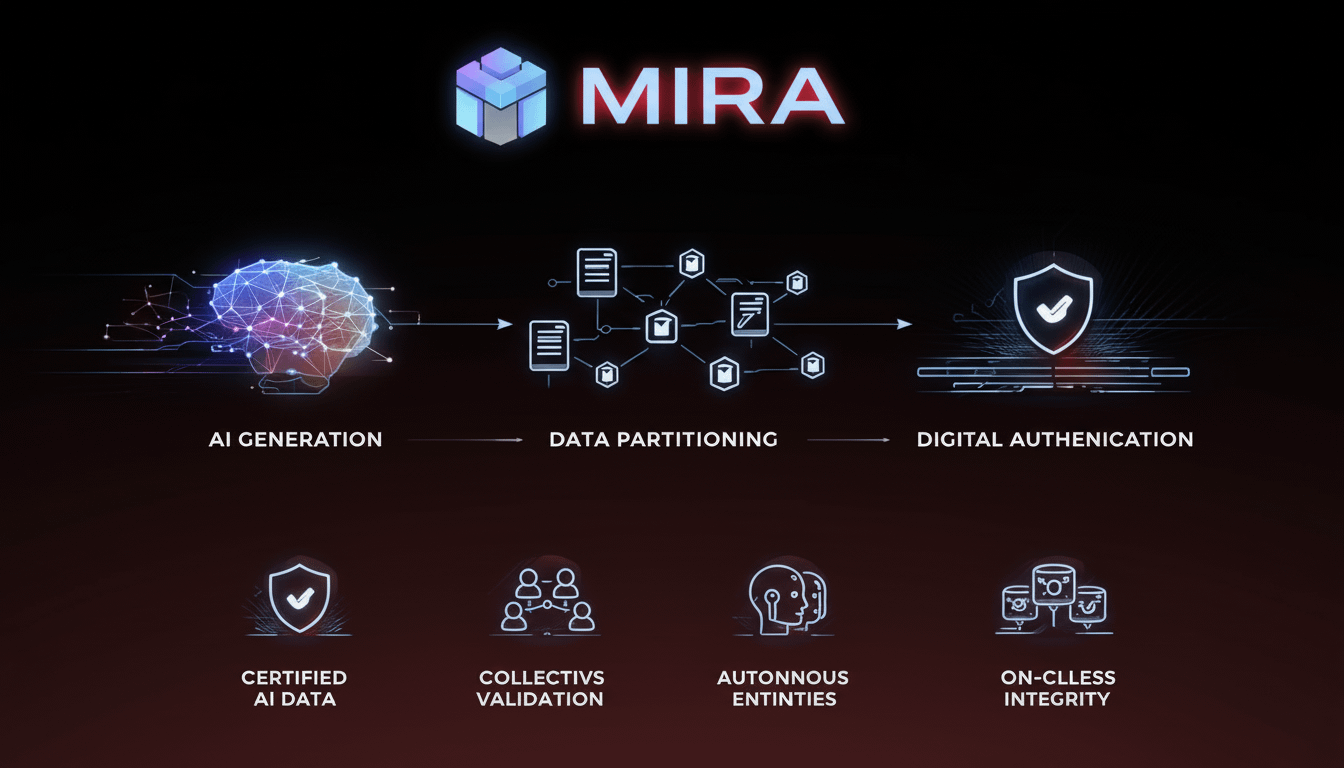

Ta mała zmiana naprawdę zmienia sposób, w jaki działają rzeczy. Jeśli AI generuje szczegółową odpowiedź, Mira dzieli ją na mniejsze roszczenia. Każde z tych roszczeń jest następnie sprawdzane niezależnie przez różne modele lub walidatory w sieci. $MIRA

To oznacza, że zamiast polegać na jednym systemie, otrzymujesz wiele sprawdzeń tej samej informacji.

Dlaczego to jest ważne

Jeśli używasz narzędzi AI wystarczająco długo, prawdopodobnie widziałeś to sam. Czasami odpowiedzi są trafne. Innym razem brzmią świetnie, ale okazują się całkowicie błędne.

To dziwna część AI teraz - dostarcza odpowiedzi z taką pewnością, ale to nie zawsze oznacza, że są one prawidłowe.

To, nad czym pracuje Mira, polega na tym, aby odpowiedzi AI nie były natychmiast akceptowane jako prawda. Zamiast tego przechodzą one przez proces weryfikacji z kilku różnych źródeł. $MIRA

Strona infrastruktury

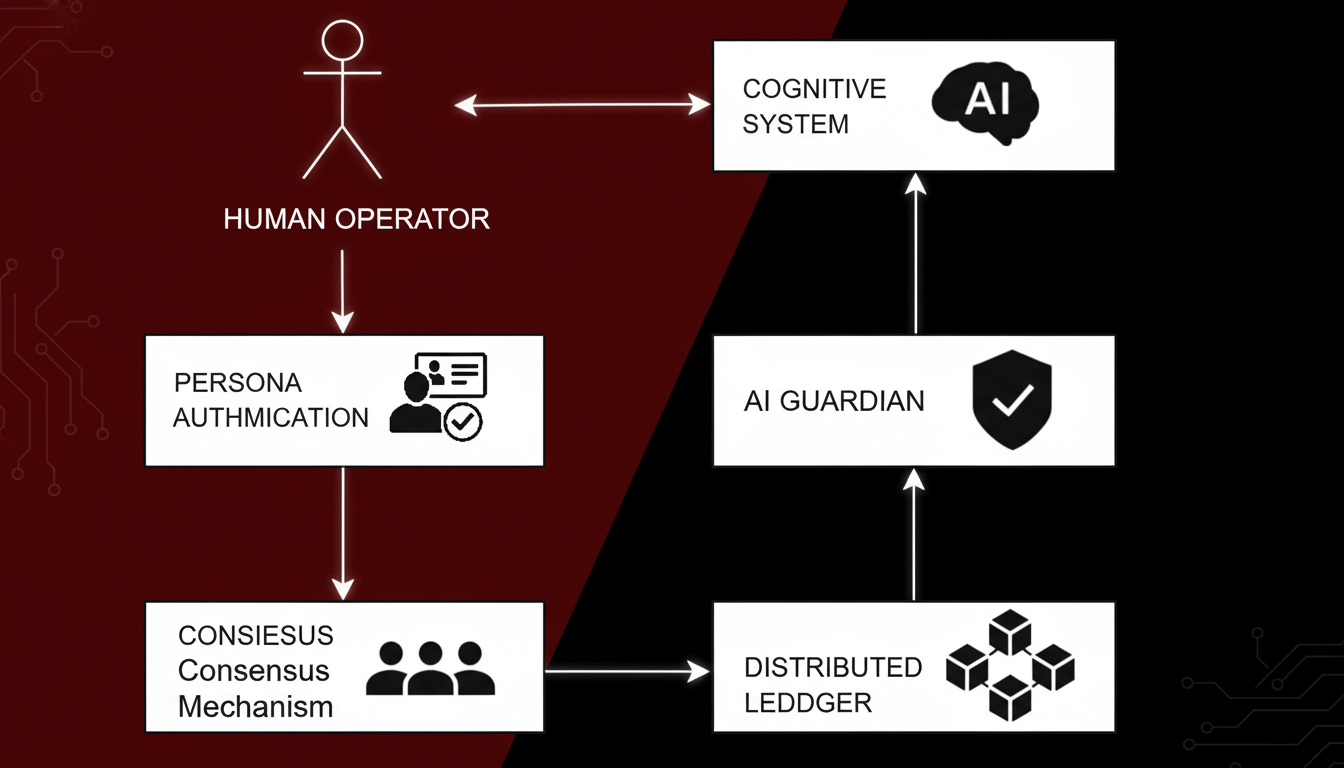

Innym interesującym aspektem Miry jest to, jak rejestrują proces weryfikacji w sposób przejrzysty. Zamiast dziać się za kulisami, sieć tworzy ślad audytowy, który pokazuje dokładnie, jak roszczenie zostało sprawdzone i potwierdzone.

W dziedzinach takich jak finanse, badania czy prawo, ten poziom przejrzystości może stać się niezwykle ważny. Nie chodzi o zastąpienie AI, ale o upewnienie się, że możemy zaufać temu, co mówi.

Nowy sposób myślenia o AI

To, co naprawdę mi się podoba w tym podejściu, to to, że zmienia rozmowę na temat AI. Większość projektów AI koncentruje się na czynieniu modeli mądrzejszymi. Mira zadaje inne pytanie:

Co jeśli następny wielki krok nie dotyczy budowania mądrzejszego AI… ale uczynienia go weryfikowalnym?

Jeśli podejście Miry działa na większą skalę, możemy skończyć w świecie, w którym AI nie tylko generuje informacje szybko - ale także udowadnia, że można jej ufać.