Mira Network pozycjonuje się jako warstwa infrastruktury, która sprawia, że wyniki AI są godne zaufania dzięki zdecentralizowanej weryfikacji. Wiele modeli AI przetwarza to samo zapytanie i musi osiągnąć konsensus, zanim wyniki zostaną uznane za wiarygodne. Koncepcja ta odnosi się do rzeczywistego problemu z halucynacjami AI i niewiarygodnymi wynikami, które uniemożliwiają wdrożenie w krytycznych aplikacjach. Pytanie brzmi, czy organizacje naprawdę potrzebują zdecentralizowanej weryfikacji na tyle, aby za nią płacić, w porównaniu do prostszych podejść, które kosztują mniej.

Podstawowa teza ma sens na papierze. Obecne systemy AI produkują halucynacje i błędy, które wymagają stałego nadzoru ludzkiego. Świadczeniodawcy opieki zdrowotnej nie mogą wdrażać AI do diagnozowania, gdy błędy mogą zaszkodzić pacjentom. Instytucje finansowe nie będą używać AI do handlu, gdy niepewne wyniki mogą wywołać ogromne straty. Firmy prawnicze nie mogą ufać badaniom AI, gdy cytaty mogą być fałszywe. Te dziedziny o wysokich stawkach potrzebują weryfikacji, której obecna AI nie zapewnia.

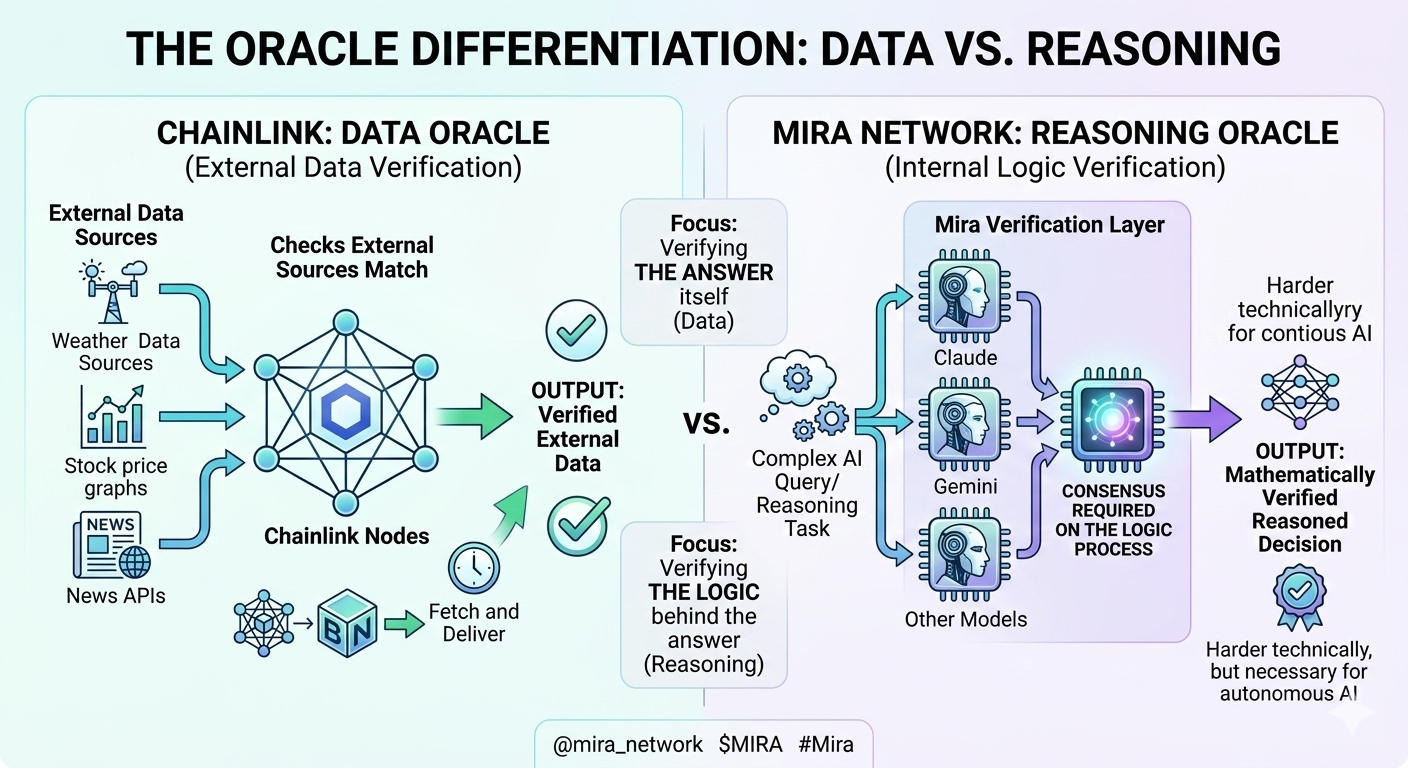

Rozwiązanie MIRA kieruje wyniki przez wiele niezależnych modeli AI, wymagając zgody między nimi przed zaakceptowaniem wyników jako wiarygodnych. To podejście oparte na konsensie teoretycznie eliminuje pojedyncze punkty awarii i tworzy matematycznie weryfikowalne wyniki bez interwencji ludzkiej. Weryfikacja odbywa się w czasie rzeczywistym, utrzymując wydajność, dodając niezawodność, która umożliwia autonomiczne wdrożenie AI w kluczowych dziedzinach.

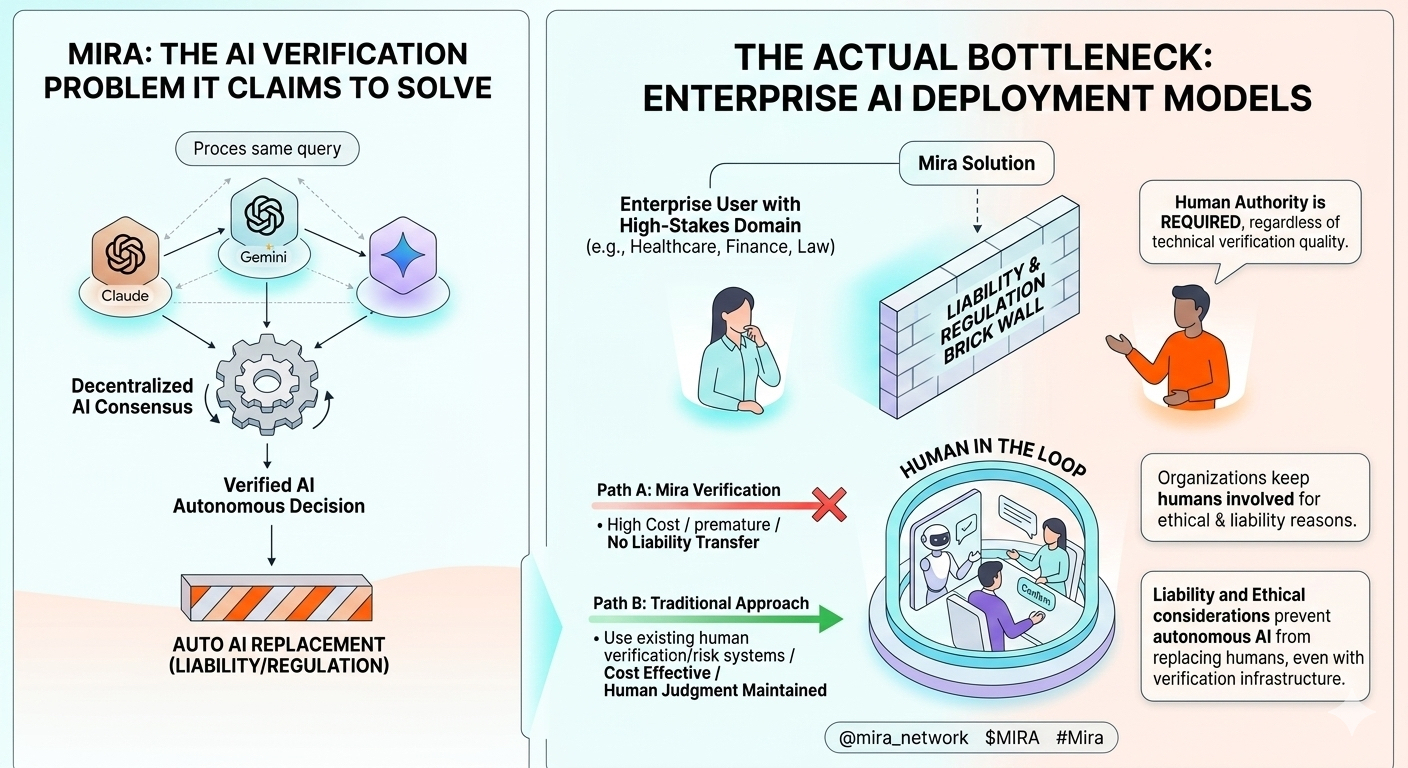

Wyzwanie polega na tym, że organizacje borykające się z problemami niezawodności AI rozwiązują je inaczej, nie potrzebując zdecentralizowanej infrastruktury weryfikacyjnej. Systemy opieki zdrowotnej używające AI utrzymują ludzi w pętli w celu podejmowania ostatecznych decyzji, zamiast dążyć do pełnej autonomii poprzez protokoły weryfikacyjne. Instytucje finansowe prowadzą wyniki AI przez wewnętrzne procesy walidacji i systemy zarządzania ryzykiem, które już zbudowały. Firmy prawnicze weryfikują badania AI poprzez tradycyjne sprawdzanie faktów, a nie płacąc za weryfikację konsensualną.

Rozmawiałem z dyrektorem technologii w systemie szpitalnym na temat wdrożenia AI w ustawieniach klinicznych. Wdrożyli pomoc AI do analizy radiologicznej i sugestii diagnostycznych. Gdy zapytałem, czy infrastruktura zdecentralizowanej weryfikacji pomogłaby im wdrożyć AI szerzej, odpowiedź ujawniła, dlaczego rynek MIRA może nie istnieć w zakładanej skali.

„Nie dążymy do tego, aby AI była całkowicie autonomiczna w podejmowaniu decyzji klinicznych. Chcemy, aby AI wspierała możliwości lekarzy, przy czym ludzie zachowują ostateczną władzę. Rozważania dotyczące odpowiedzialności i etyki oznaczają, że zawsze będziemy mieć klinicystów podejmujących ostateczne decyzje, niezależnie od jakości weryfikacji AI. Dodanie infrastruktury weryfikacyjnej nie zmienia naszego modelu wdrożenia, ponieważ autonomiczne AI w opiece zdrowotnej nie jest naszym celem. Potrzebujemy AI, która pomaga lekarzom pracować lepiej, a nie AI, która zastępuje osąd medyczny.”

Ten wzór powtarzał się w rozmowach z potencjalnymi użytkownikami przedsiębiorstw. Organizacje nie dążą do osiągnięcia całkowicie autonomicznej AI, która potrzebowałaby weryfikacji MIRA. Wdrażają AI jako narzędzia wspomagające z ludźmi pozostającymi zaangażowanymi. Infrastruktura weryfikacyjna rozwiązuje kwestie poziomów autonomii, które większość organizacji nie ściga, ponieważ kwestie odpowiedzialności, regulacji i zaufania utrzymują ludzi w pętlach kontrolnych, niezależnie od możliwości technicznych weryfikacji.

Usługi finansowe wykazały podobne dynamiki. AI jest wdrażana do analizy, rozpoznawania wzorców i generowania sugestii. Ale rzeczywiste decyzje handlowe, zatwierdzenia zgodności i zarządzanie ryzykiem wiążą się z nadzorem ludzkim, który już weryfikują wewnętrzne procesy. Dodanie zdecentralizowanej weryfikacji nie umożliwia usunięcia nadzoru ludzkiego, ponieważ przepisy i kontrole wewnętrzne wymagają, aby ludzie pozostali zaangażowani, niezależnie od tego, jak niezawodna staje się weryfikacja AI.

Model cenowy dla usług weryfikacyjnych również tworzy bariery adopcyjne. Organizacje wdrażające pomoc AI optymalizują koszty, używając AI do wspomagania drogiej pracy ludzkiej. Dodanie infrastruktury weryfikacyjnej zwiększa koszty, co potencjalnie eliminuje korzyści ekonomiczne, które sprawiły, że adopcja AI była atrakcyjna. Jeśli koszty weryfikacji zbliżą się do kosztów nadzoru ludzkiego, organizacje mogą woleć utrzymać ludzi w procesie, zamiast płacić za zautomatyzowaną infrastrukturę weryfikacyjną.

Rynek MIRA istnieje, jeśli organizacje są zablokowane przed wdrożeniem AI z powodu luk weryfikacyjnych i byłyby skłonne zapłacić za infrastrukturę rozwiązującą te luki. Ale rozmowy w przedsiębiorstwach sugerują, że organizacje albo wdrażają AI z nadzorem ludzkim, albo nie wdrażają go z powodu czynników wykraczających poza jakość weryfikacji. Infrastruktura weryfikacyjna odnosi się do problemu, który może nie być rzeczywistym wąskim gardłem wdrożenia dla większości potencjalnych klientów.

Ekonomia tokena $MIRA zależy od wolumenu transakcji związanego z żądaniami weryfikacyjnymi w miarę skalowania adopcji AI. Jeśli organizacje wdrażają AI bez potrzeby zdecentralizowanej weryfikacji, wolumen transakcji nie materializuje się. Infrastruktura może działać perfekcyjnie, obsługując rynek znacznie mniejszy niż zakładano, ponieważ przedsiębiorstwa rozwiązują niezawodność inaczej lub utrzymują nadzór ludzki, co sprawia, że infrastruktura weryfikacyjna jest zbędna w ich modelach wdrożeniowych.

Aktualne dane rynkowe pokazują, że $MIRA handluje w okolicach $0.09, a jego kapitalizacja wynosi blisko 19 milionów dolarów. Cena tokena spadła o 96% od najwyższych wartości w historii, co sugeruje sceptycyzm rynku co do materializacji popytu na weryfikację na dużą skalę, uzasadniającego inwestycje w infrastrukturę. Wyniki cenowe wskazują, że inwestorzy kwestionują, czy przedsiębiorstwa zapłacą za zdecentralizowaną weryfikację AI w porównaniu do rozwiązywania problemu niezawodności poprzez prostsze podejścia, które kosztują mniej.

Dla każdego, kto ocenia $MIRA, kluczowe pytanie brzmi, czy organizacje wdrażają AI autonomicznie na dużą skalę, co wymaga infrastruktury weryfikacyjnej, czy też wdrażają AI jako narzędzia wspomagane przez ludzi, gdzie weryfikacja nie jest wąskim gardłem wdrożenia. Rozmowy w przedsiębiorstwach sugerują to drugie, co sprawiłoby, że infrastruktura weryfikacyjna byłaby przedwczesna o lata, jeśli nie rozwiązuje rzeczywistych barier, które uniemożliwiają szerszą adopcję AI w kluczowych dziedzinach.