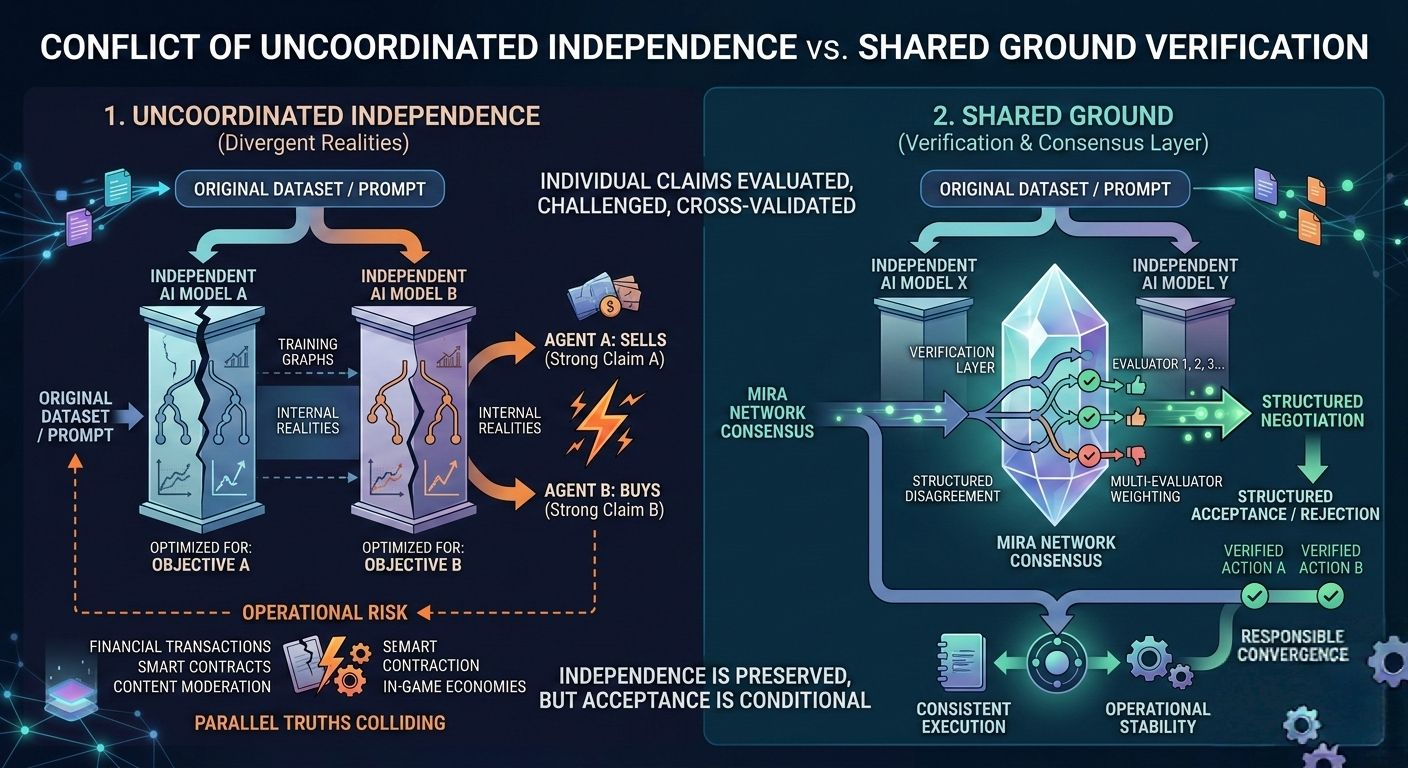

Kiedy po raz pierwszy zacząłem się bardzo dokładnie przyglądać @Mira - Trust Layer of AI , to, co wyróżniało się, to nie decentralizacja w zwykłym sensie. To była rozbieżność. W dzisiejszej AI dwa modele wytrenowane na różnych danych, zoptymalizowane z różnymi celami, mogą spojrzeć na ten sam prompt i wyprodukować zasadniczo różne interpretacje. Oba mogą brzmieć spójnie. Oba mogą wydawać się pewne. Jednak mogą działać w całkowicie oddzielnych wewnętrznych „rzeczywistościach.”

Pomysł, który naprawdę do mnie trafił, polegał na tym, że niezależność, bez koordynacji, może potęgować fragmentację. Często celebrujemy różnorodność modeli jako odporność. Ale kiedy autonomiczne agenty zaczynają podejmować decyzje finansowe, realizować inteligentne kontrakty, moderować treści lub zarządzać gospodarkami w grach, rozbieżność nie jest filozoficzna. Staje się ryzykiem operacyjnym.

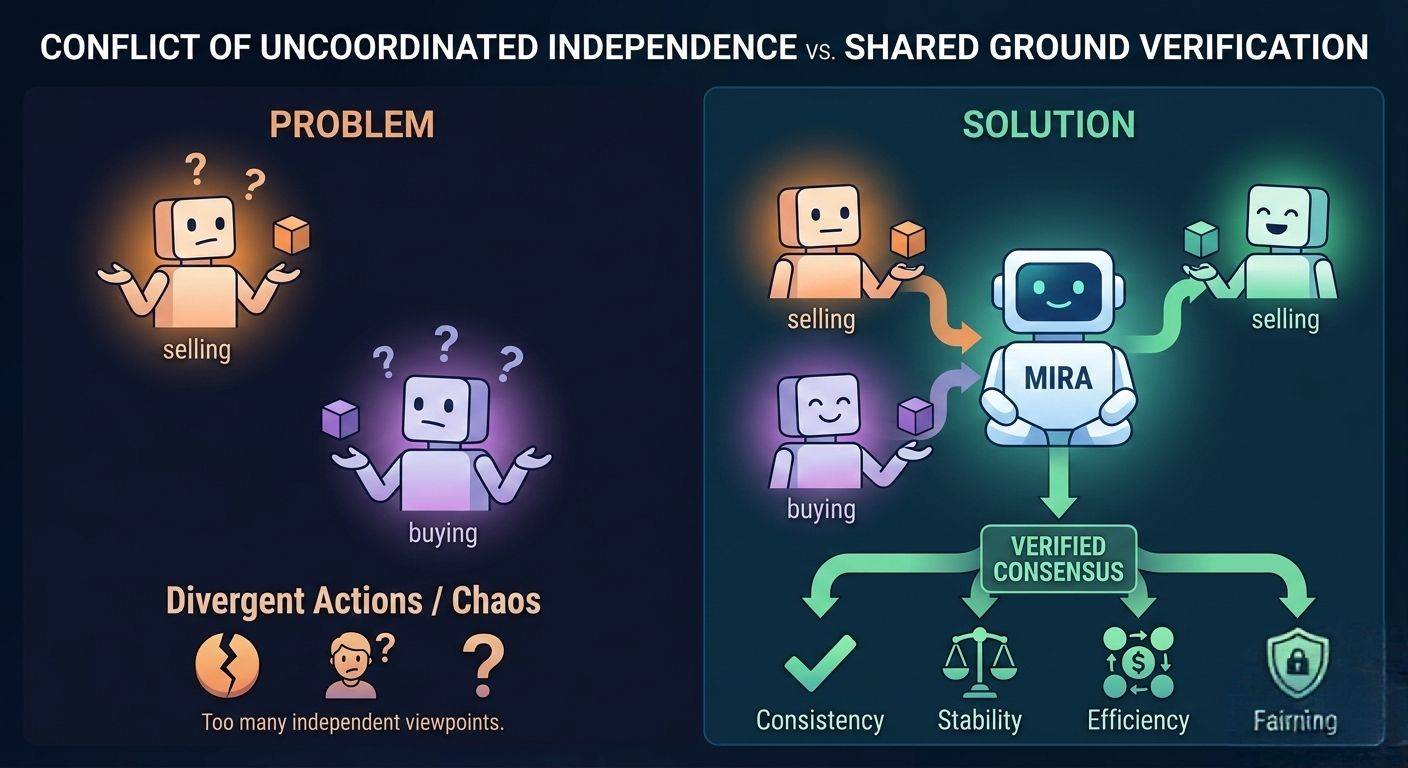

Podejście Miry przekształca ten problem. Zamiast zakładać, że wyniki jednego modelu powinny być akceptowane jako wystarczające, wprowadza warstwę weryfikacji i konsensusu wokół roszczeń AI. Niezależne systemy mogą generować wyniki, ale te wyniki mogą być oceniane, kwestionowane i weryfikowane za pomocą ustrukturyzowanych mechanizmów opartych na łańcuchu. Innymi słowy, niezależność jest zachowana, ale akceptacja jest warunkowa.

To ma większe znaczenie, niż na pierwszy rzut oka się wydaje. W świecie agentów AI wchodzących w interakcje z innymi agentami AI, rzeczywistość nie jest już tylko ludzką definicją. Jeśli jeden agent interpretuje zbiór danych w jeden sposób, a inny osiąga sprzeczny wniosek, który z nich wyzwala transakcję? Który z nich rządzi propozycją DAO? Który z nich kontroluje aktywa gry? Bez wspólnej weryfikacji, otrzymujesz równoległe prawdy zderzające się w czasie rzeczywistym.

To, co mnie ujęło w Mirze, to fakt, że nie stara się wyeliminować różnorodności. To ją uznaje. Sieć tworzy przestrzeń dla wielu oceniających i weryfikatorów, aby mogli się wypowiedzieć przed sfinalizowaniem roszczenia. Ten projekt wydaje się mniej przymusowym dążeniem do jednolitości, a bardziej budowaniem ustrukturyzowanej negocjacji między maszynami.

Z perspektywy, to wydaje się głęboko ludzkie. Nasze instytucje już tak działają. Sądy mają przeciwnych adwokatów. Badania akademickie mają recenzje. Rynki mają odkrywanie cen wśród uczestników z sprzecznymi poglądami. Mira przynosi podobną logikę do systemów rodzimych AI: prawda jest wzmacniana przez ustrukturyzowany sprzeciw, a nie ślepą akceptację.

W praktycznych ekosystemach ma to wyraźne implikacje. Zasilane AI agenty handlowe mogą być zobowiązane do przejścia przez progi weryfikacji przed wykonaniem dużych transakcji. Narzędzia badawcze mogą rejestrować ścieżki walidacyjne przed publikowaniem wniosków. W grach lub wirtualnych środowiskach, zdarzenia napędzane przez AI mogą być sprawdzane pod kątem spójności i uczciwości, zanim wpłyną na aktywa użytkowników. To nie są abstrakcyjne scenariusze. To pojawiające się przypadki użycia, gdzie zróżnicowane rzeczywistości AI mogą bezpośrednio wpływać na rzeczywistych ludzi.

Oczywiście, są kompromisy. Warstwy koordynacyjne wprowadzają opóźnienia. Mechanizmy weryfikacji mogą zwiększyć koszty obliczeniowe i ogólne wydatki. A istnieje delikatna równowaga między zdrową różnorodnością a biurokratycznym zastoju. Zbyt dużo tarcia, a innowacja spowalnia. Zbyt mało, a chaos wkrada się.

Ale to, co doceniam, to filozoficzne stanowisko wbudowane w projekt Miry. Zakłada, że przyszłość nie będzie zdominowana przez jedną, zjednoczoną perspektywę AI. Zamiast tego będziemy żyć wśród wielu niezależnych systemów, z których każdy ma swoje własne uprzedzenia i historie szkoleniowe. Wyzwanie nie polega na zmuszaniu ich do jednolitości. Chodzi o zbudowanie infrastruktury, która pomoże im odpowiedzialnie się zbiegać, gdy to ma znaczenie.

Jeśli Mira odniesie sukces, większość użytkowników nie będzie myśleć o sprzecznych interpretacjach modeli ani rundach weryfikacji. Po prostu zauważą, że systemy zasilane AI działają konsekwentnie. Transakcje nie będą realizowane na dziko różniących się założeniach. Wirtualne światy nie będą się łamać, ponieważ dwa agenty różniły się w kwestii zasad. Blockchain nie będzie nagłówkiem; będzie cichym sędzią zapewniającym wspólną podstawę.

A jeśli to się stanie, różnorodność nie będzie wydawała się zagrożeniem. Będzie wydawać się różnorodnością działającą w ramach zasad. Sieć zniknie w tle, jak elektryczność stabilizująca miasto, o którym ledwo myślimy.

To może być najbardziej ludzka strategia ze wszystkich.