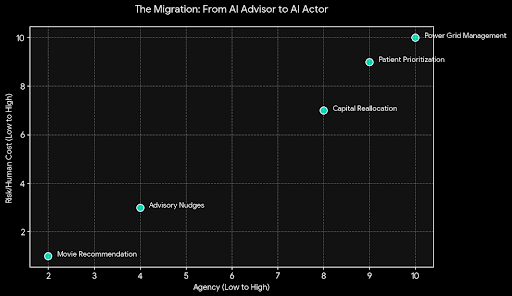

AI używane do siedzenia grzecznie w tle, oferując sugestie i podpowiedzi. Teraz wychodzi na pierwszy plan, podejmuje decyzje, a w niektórych systemach podpisuje czek. Ta migracja od doradcy do aktora jest pilna, ekscytująca i cicho przerażająca.

Gdy algorytm rekomenduje film, zły wybór to tylko irytacja. Gdy przekierowuje kapitał, priorytetyzuje pacjenta lub przerywa zasilanie, pojedynczy błąd może mieć dalekosiężne skutki z realnymi kosztami dla ludzi. Problem nie polega na inteligencji per se, lecz na działaniu bez weryfikowalnej odpowiedzialności.

Halucynacje, dryf modelu i sztuczki adwersarzy nie są już teoretycznymi błędami; są wektorami szkód. Pewne wydanie od modelu może bezpośrednio przekładać się na transakcję, rozładowanie lub zmianę polityki, jeśli wyjścia systemu zyskują agencję. Bez sposobu na udowodnienie, co tak naprawdę się wydarzyło, „AI tak powiedziało” staje się niebezpiecznym substytutem audytu i nadzoru.

Dlatego weryfikacja działań – nie tylko wyników – ma znaczenie. To nie wystarczy, aby sprawdzić, co system wyprodukował na papierze. Musimy zweryfikować zmiany stanu: czy transakcja została zakończona, czy recepta została zrealizowana, czy sieć się dostosowała? Weryfikowalne, odporne na manipulacje zaświadczenia zamieniają roszczenia w dowody, a opowiadanie w audytowalność.

Otwarte sieci potęgują problem weryfikacji. Gdy wielu agentów może zgłaszać roszczenia, niskokosztowe zaświadczenia zapraszają spam, oszustwa i fałszywe zaufanie. Warstwa weryfikacji, która jest darmowa dla wszystkich, zostanie zalana hałasem i manipulowana przez tych, którzy czerpią korzyści z oszustwa.

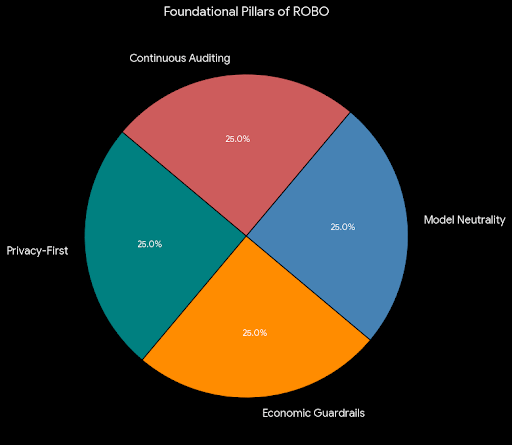

ROBO odpowiada na to z użyciem ekonomicznych i reputacyjnych zabezpieczeń. Walidatorzy stawiają zasoby, zdobywają nagrody za uczciwe zaświadczenia i ponoszą kary za oszustwa. Gdy koszty weryfikacji wiążą się z prawdziwymi pieniędzmi, reputacją lub okazjami, system zniechęca do nieuzasadnionych roszczeń i nagradza dokładność. Zachęty stają się obroną, a nie luką prawną.

Prywatność musi być wbudowana w każdy plan odpowiedzialności. Opieka zdrowotna i finanse są pełne sekretów, których nie można ujawniać dla weryfikacji. Dowody kryptograficzne, które potwierdzają warunki bez ujawniania danych podstawowych, pozwalają nam weryfikować bez inwigilacji. Możesz udowodnić, że próg został osiągnięty, nie ujawniając całego rekordu; możesz potwierdzić zgodność bez publikowania strategii własnościowych.

Neutralność to kolejny fundament. Warstwa weryfikacji, która faworyzuje jednego dostawcę lub architekturę, po prostu odtwarza ryzyko koncentracji, które mieliśmy nadzieję, że decentralizacja uniknie. Weryfikacja roszczeń niezależna od modelu, wielokrotnego użytku sprawia, że zaświadczenia są przenośne i złożone. Zaufanie podróżuje z dowodem, a nie dostawcą, a systemy współdziałają zamiast blokować się nawzajem.

Weryfikacja nie jest wydarzeniem; to praktyka. Systemy autonomiczne uczą się, aktualizują i zmieniają swoje zachowanie. Weryfikacja musi być ciągła – strumieniowe zaświadczenia, bieżące audyty i metryki zaufania na żywo, a nie jednorazowe pieczątki. Ta ciągła widoczność ujawnia odchylenia, odsłania wzorce i sprawia, że zaufanie staje się mierzalne.

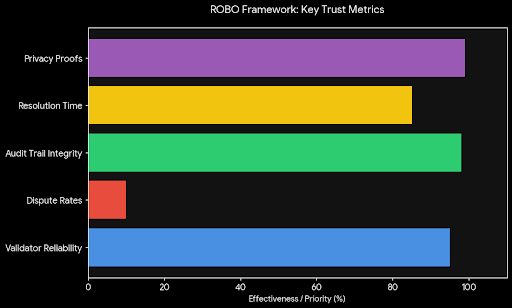

Jasne metryki zaufania zmieniają sposób, w jaki zachowują się organizacje. Zamiast marketingowych roszczeń o „udowodnionej dokładności”, zespoły pokazują historie: niezawodność walidatorów, wskaźniki sporów, ścieżki audytowe i czasy rozwiązań. Te metryki czynią odpowiedzialność audytowalną i tworzą zachęty do poprawy długoterminowej niezawodności zamiast krótkoterminowego wyglądu.

Obrona nigdy nie jest statyczna. Gdy źli aktorzy wynajdują nowe sposoby na oszustwa, weryfikacja musi ewoluować w podobny sposób. Adaptacyjne zasady, standardy napędzane przez społeczność oraz warstwowe nadzory od kontroli kryptograficznych po ludzką recenzję, gdy to stosowne, utrudniają manipulację i przyspieszają wykrywanie.

Zdecentralizowana weryfikacja podnosi również poprzeczkę dla dezinformacji. W świecie, w którym syntetyczna treść i deepfake'i są powszechne, zaświadczenia kryptograficzne działają jak kotwice pochodzenia. Gdy rekord jest zaświadczony, niesie ze sobą weryfikowalny kontekst; gdy nie jest, uzasadniona jest sceptycyzm. Ta binarność udowodnionego w stosunku do nieudowodnionego przywraca miarę higieny epistemicznej.

Umieszczanie weryfikowalnych dowodów w centrum autonomii nie oznacza rezygnacji z szybkości czy innowacji. Oznacza to wbudowanie odpowiedzialności w rury, w których agenci dokonują transakcji. Maszyny mogą nadal negocjować, optymalizować i działać, po prostu pokazują swoje rachunki później w sposób, który inne agenty i ludzie mogą zweryfikować.

To zmienia zachęty w całym ekosystemie. Dostawcy, którzy produkują weryfikowalne, audytowalne wyniki, zdobywają zaufanie. Regulatorzy i audytorzy zyskują obiektywne zapisy. Użytkownicy i instytucje mogą wybierać agentów na podstawie wykazanej niezawodności, a nie reklamy. Odpowiedzialność staje się sygnałem rynkowym, a nie tylko polem do odznaczenia zgodności.

Najważniejsza zmiana ma charakter kulturowy. Przechodzimy od traktowania AI jako wyroczni, której orzeczenia są przyjmowane na wiarę, do traktowania AI jako aktora, którego czyny muszą być udowodnione. Ta zmiana przekształca rozmowy o autonomii – z „Czy model to zrobił?” na „Czy model może udowodnić, że to zrobił?”

Model ROBO, niezależny od modelu, skoncentrowany na prywatności i zgodny ekonomicznie, stanowi fundament dla tej kulturowej transformacji. Chroni wrażliwe dane, opiera się spamowi i nadużyciom, a także sprawia, że zaufanie staje się mierzalne i przenośne. Nie gwarantuje perfekcji, ale buduje system, w którym niepowodzenia są widoczne, odpowiedzialne i możliwe do nauki.

Na końcu pytanie, przed którym stoimy, jest proste i wyraźne. Czy pozwalamy autonomicznym systemom działać w naszym imieniu bez rachunków, czy wymagamy dowodów i budujemy infrastrukturę, która na to nalega? Wybór ten decyduje, czy AI staje się nieodpowiedzialnym zagrożeniem, czy wiarygodną podstawą.

Powinniśmy wybierać udowodnioną odpowiedzialność. Gdy maszyny mogą pokazać w sposób kryptograficzny i audytowalny, co zrobiły i dlaczego, zaufanie przestaje być skokiem wiary i staje się metryką, którą możemy zarządzać. Tak przechodzimy od ślepej zależności do odpowiedzialnej autonomii i zapewniamy, że potężne systemy służą ludziom, a nie zaskakują ich.