Ostatnio zdarzył się moment, w którym prawie przesłałem stworzony przez AI podsumowanie bez jego sprawdzenia.

Wyglądało czysto. Ustrukturyzowane. Nawet cytowane.

A potem się zatrzymałem.

Ponieważ już się sparzyłem.

Dziwne w nowoczesnym AI nie jest to, że popełnia błędy. Ludzie też popełniają błędy. Dziwne jest to, że popełnia błędy z pewnością. Bez wahania. Bez markerów niepewności. Tylko dopracowane wyniki, które wydają się autorytatywne.

To sprawia, że halucynacje są niebezpieczne.

Kiedy po raz pierwszy zacząłem czytać o Mira Network, nie myślałem o tym jako o "projekcie AI". Myślałem o tym jako o projekcie architektury zaufania.

Ponieważ prawdziwym wąskim gardłem dla AI w tej chwili nie jest inteligencja.

To niezawodność.

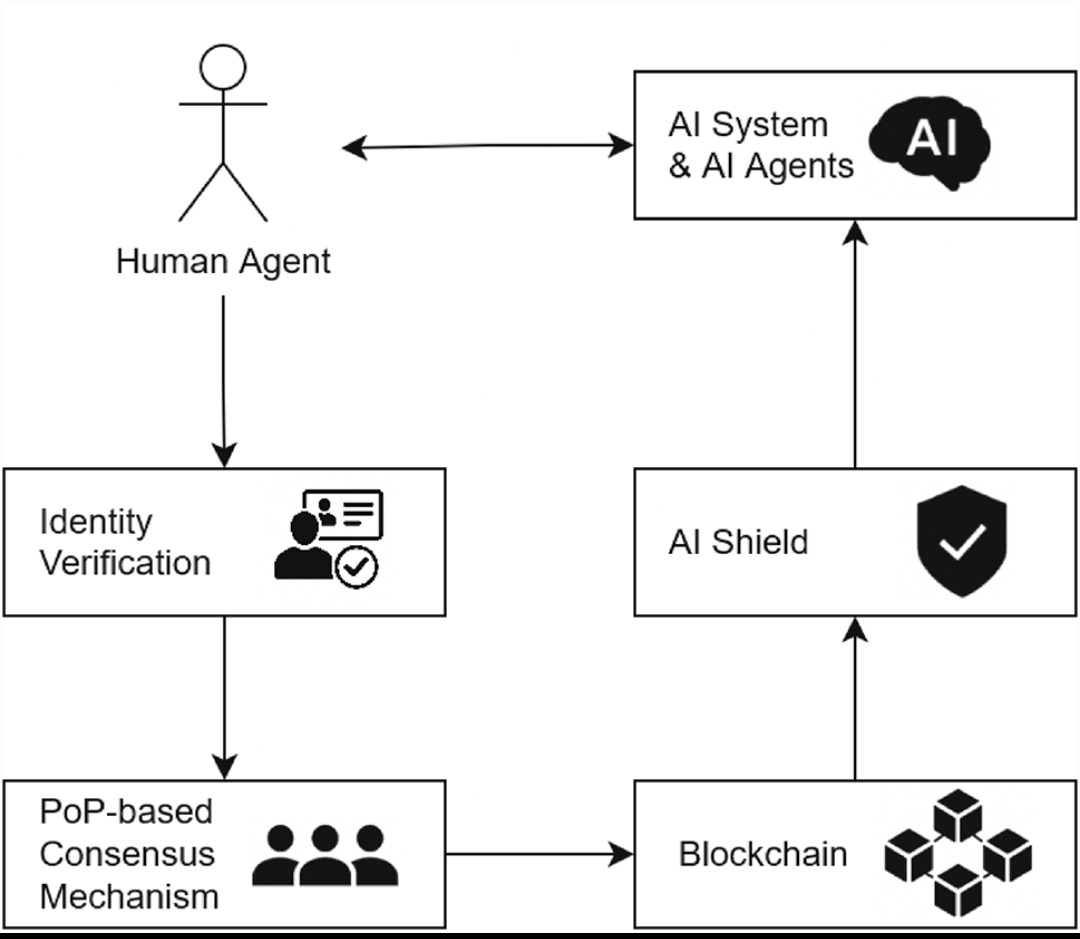

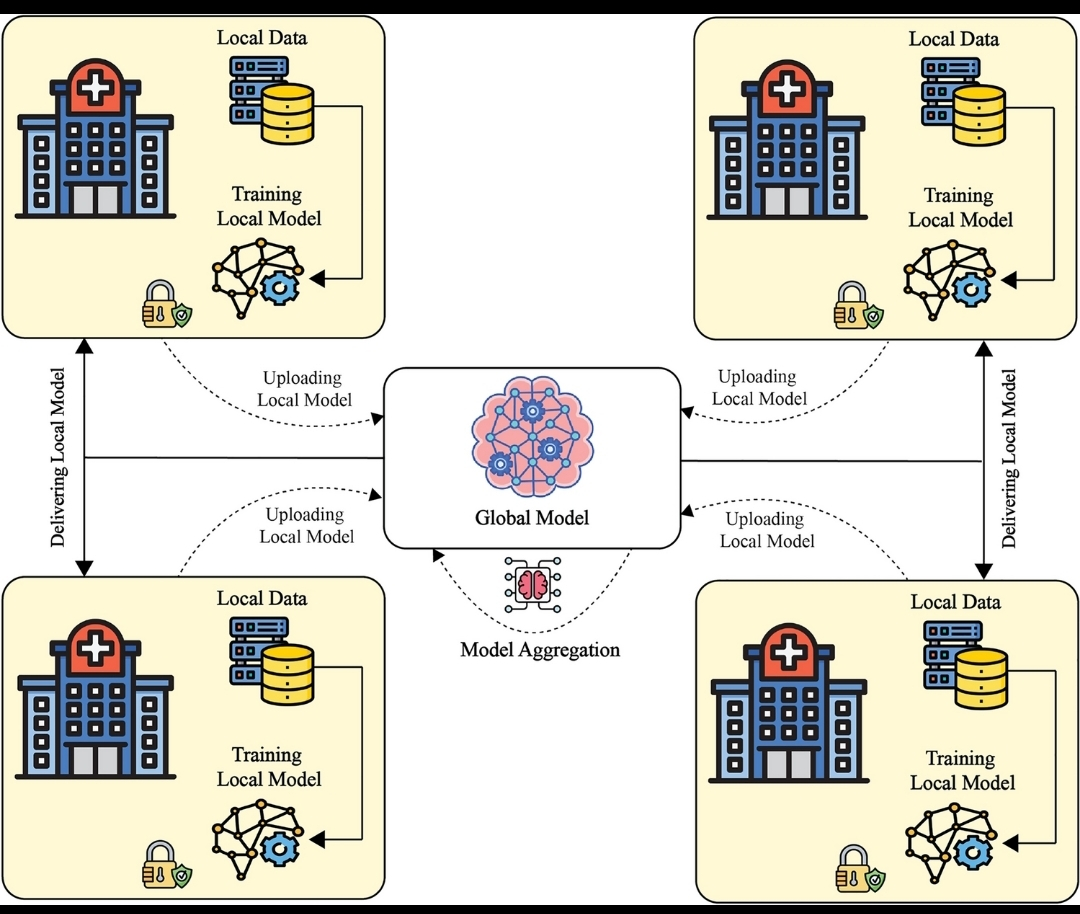

Mira podchodzi do tego z innej perspektywy niż większość zespołów. Zamiast próbować zbudować większy model lub mądrzejszy model, koncentruje się na weryfikacji wyników modeli. Dzieli generowane treści na mniejsze, testowalne roszczenia. Te roszczenia są następnie rozdzielane pomiędzy niezależnych walidatorów AI w zdecentralizowanej sieci.

Konsensus określa, co się utrzymuje.

Nie pewność oryginalnego modelu.

Ta zmiana jest większa, niż się wydaje.

W tej chwili AI jest w większości scentralizowane. Zadajesz pytanie modelowi. Otrzymujesz odpowiedź. Ufasz jej lub sprawdzasz ją ręcznie. Obciążenie weryfikacji spoczywa na użytkowniku.

Mira odwraca tę dynamikę.

Weryfikacja staje się odpowiedzialnością warstwy protokołu.

Część blockchaina nie jest tam tylko dla marki. To, co umożliwia koordynację bez zaufania. Walidatorzy stawiają wartość ekonomiczną za swoimi decyzjami weryfikacyjnymi. Jeśli zweryfikują nieprawidłowe roszczenia, są karani. Jeśli zweryfikują poprawnie, są nagradzani.

Prawda staje się ekonomicznie zaincentywowana.

To bardzo inna filozofia projektowania niż „ufaj dostawcy”.

To, co sprawiło, że to do mnie dotarło, to myślenie o autonomicznych agentach AI.

Dopóki ludzie są w pętli, halucynacje są irytujące, ale da się nimi zarządzać. Ale gdy agenci AI zaczną wykonywać działania — zatwierdzać transakcje, zarządzać funduszami, uruchamiać przepływy pracy — „prawdopodobnie poprawne” to za mało.

Potrzebujesz weryfikowalnej poprawności.

Potrzebujesz wyników, które mogą być kwestionowane.

I idealnie, potrzebujesz tego bez polegania na jednej scentralizowanej władzy, aby ogłosić coś prawdziwego.

Mira wydaje się pozycjonować jako ta warstwa weryfikacyjna — zdecentralizowany sędzia dla treści generowanych przez AI.

Oczywiście, mam zastrzeżenia.

Weryfikacja dodaje opóźnienia. Rozkładanie treści na atomowe roszczenia nie zawsze jest proste. Złożone łańcuchy rozumowania nie rozkładają się łatwo bez utraty niuansów. A antagonizm w sieciach walidatorów zawsze jest możliwy.

Jest też pytanie o projekt zachęt: jak zapewnić, by walidatorzy działali uczciwie w dłuższej perspektywie? Jak zapobiec przejęciu ekonomicznemu?

To są trudne problemy.

Ale kierunek wydaje się właściwy.

Spędziliśmy lata na poszukiwaniu mądrzejszych modeli. Może następny skok to nie mądrzejsza AI — to odpowiedzialna AI.

Mira nie próbuje sprawić, by AI była mniej kreatywna lub mniej potężna.

Próbuje to uczynić audytowalnym.

A jeśli AI ma dotknąć finansów, rządów, opieki zdrowotnej lub jakiegokolwiek krytycznego systemu, audytowalność jest nie do negocjacji.

Nie jestem przekonany, że rynek w pełni to docenia.

Ale w dniu, w którym agenci AI zaczną autonomicznie przenosić kapitał, weryfikacja nie będzie już opcjonalna.

A sieci takie jak Mira przestaną wyglądać teoretycznie — i zaczną wyglądać niezbędnie.