Negli ultimi anni, la conversazione sull'IA si è concentrata sul potere.

Quale modello scrive meglio?

Quale di queste ragioni è più profonda?

Chi ha addestrato il sistema più grande?

È stata una corsa di prestazioni. E a essere onesti, i progressi sono stati impressionanti. L'IA di oggi può redigere riassunti di ricerca, generare codice, progettare campagne e simulare analisi in secondi. I risultati sono rifiniti. Il linguaggio è fluido. La fiducia è integrata.

Ma una volta che passi dall'esperimentare con l'IA a fare davvero affidamento su di essa, qualcosa diventa ovvio.

Il vero collo di bottiglia non è l'intelligenza.

È certezza.

L'IA non ha più difficoltà a produrre risposte. Ha difficoltà a garantirle.

Quella differenza potrebbe sembrare sottile, ma rimodella l'intero problema. Una risposta che sembra corretta non è la stessa di una che può essere considerata affidabile. Quando l'IA viene utilizzata in modo casuale, errori occasionali sono gestibili. Quando entra in finanza, ricerca, sanità, logistica o sistemi autonomi, piccole imprecisioni si amplificano in rischi sistemici.

La supervisione umana funziona su piccola scala. Si rompe su larga scala.

E questo è dove l'idea dietro il Mira Protocol inizia a avere senso.

Cambiando la domanda

La maggior parte dei progetti di IA chiede:

Come costruiamo sistemi più intelligenti?

Mira chiede qualcosa di più fondamentale:

Come verifichiamo ciò che quei sistemi producono?

Invece di trattare gli output dell'IA come conclusioni finali, Mira li tratta come affermazioni. Un'affermazione non è assunta come vera. È qualcosa che può essere valutato.

Quella cornice cambia tutto.

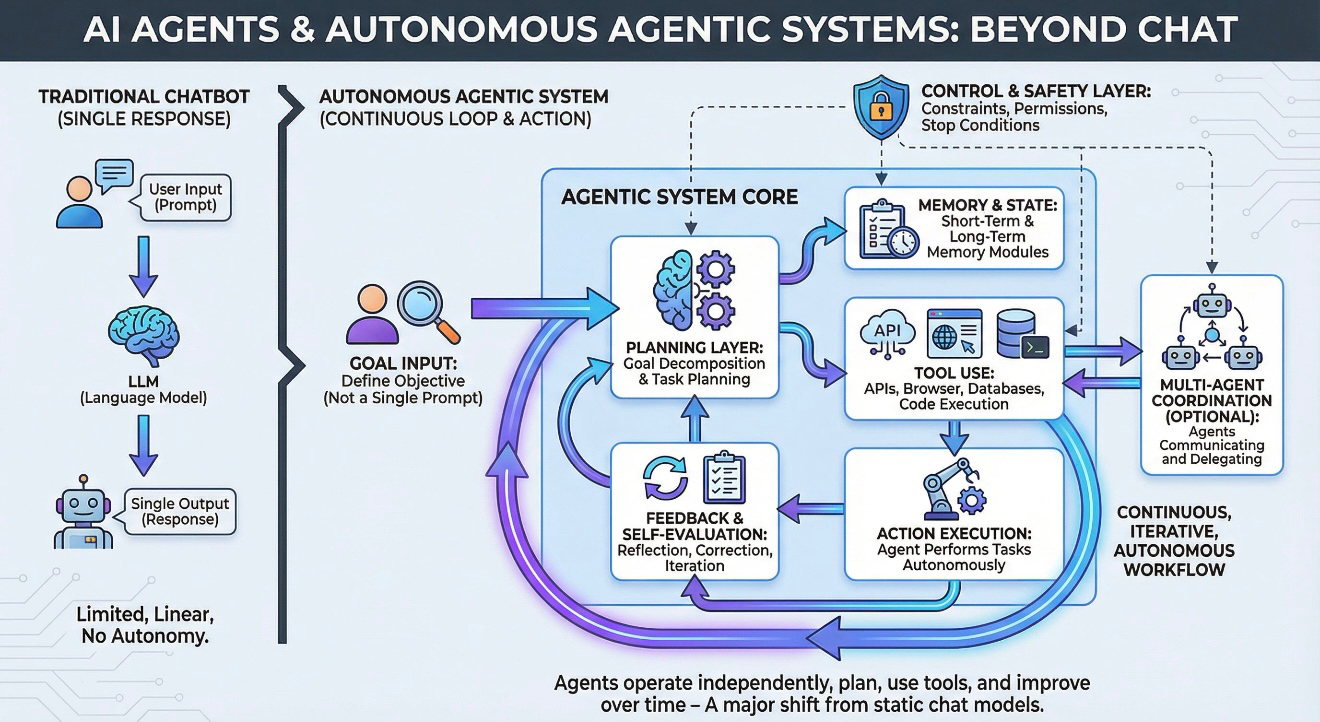

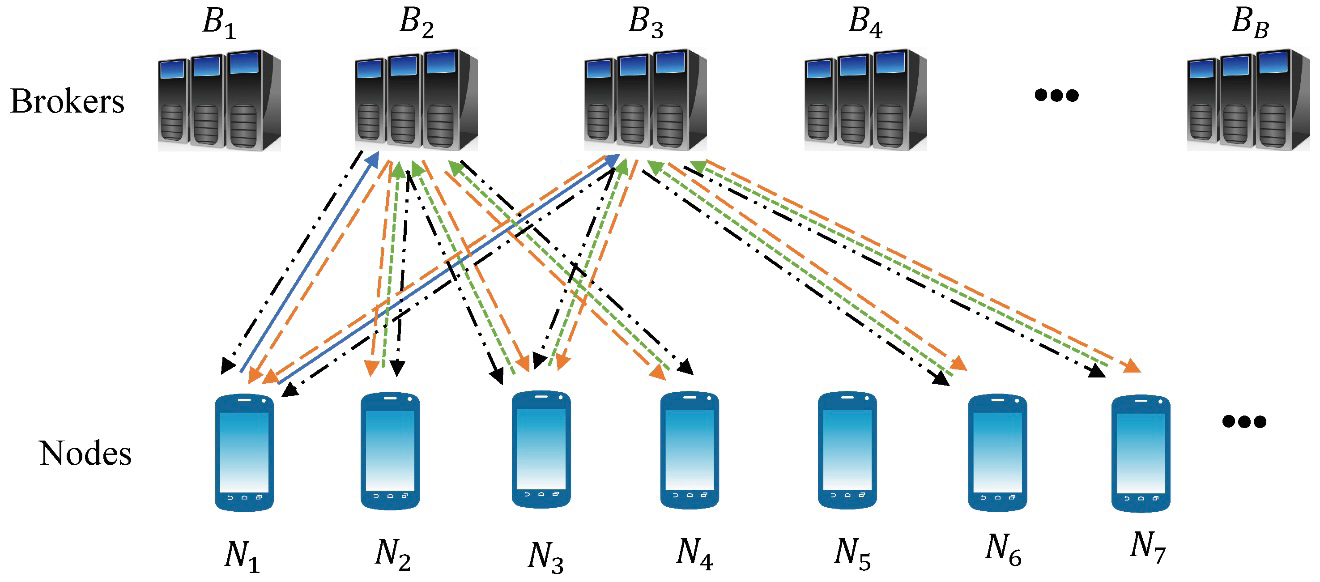

Invece di fidarsi dell'autorità di un singolo modello, il protocollo introduce una rete di verifica. Le affermazioni vengono distribuite a partecipanti indipendenti che valutano la loro validità. Invece di accettazione cieca, i risultati sono soggetti a consenso.

È concettualmente simile a ciò che la blockchain ha fatto per le transazioni digitali.

Prima dei registri decentralizzati, la fiducia dipendeva da istituzioni centralizzate che confermavano i registri. La blockchain ha ridistribuito quell'autorità in una rete dove il consenso ha sostituito la dipendenza da un singolo attore.

Mira estende quella logica dalle transazioni all'intelligenza.

Non verificare il denaro.

Verificare le informazioni.

Perché questo problema sta crescendo

I sistemi IA non operano più in isolamento.

I modelli ora interagiscono con altri modelli. Gli agenti chiamano strumenti esterni. Le applicazioni combinano più risultati in flussi decisionali. I livelli di automazione stanno iniziando a operare senza supervisione umana costante.

In questo ambiente, il rischio si moltiplica.

Se un'IA produce un'affermazione errata e un altro sistema si basa su di essa, gli errori si accumulano. Internet rischia di riempirsi di contenuti che sono espressi con sicurezza ma strutturalmente incerti.

Il problema non è l'intento malevolo. È la fragilità strutturale.

Senza infrastruttura di verifica, gli ecosistemi IA si basano su assunzioni piuttosto che su prove.

L'approccio di Mira introduce validatori che esaminano le affermazioni generate dall'IA. Questi validatori scommettono valore dietro le loro valutazioni. Quel meccanismo di scommessa significa che l'accuratezza non è semplicemente incoraggiata — è economicamente rinforzata. Nel tempo, i partecipanti che verificano correttamente guadagnano reputazione e ricompense, mentre la convalida errata comporta conseguenze.

La struttura degli incentivi cerca di allineare la verità con il comportamento economico.

Non è impeccabile. Non sarà banale scalare. Ma è una risposta logica a un divario crescente.

Infrastruttura che rimane invisibile

Uno degli aspetti più interessanti della posizione di Mira è che non è progettato per essere a contatto diretto con l'utente.

Se avrà successo, la maggior parte delle persone non interagirà direttamente con esso.

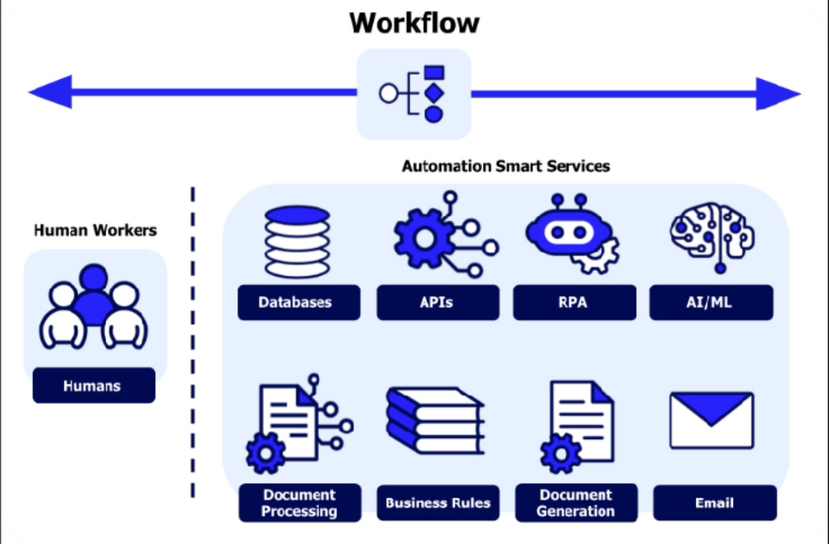

Invece, gli sviluppatori o le piattaforme IA potrebbero integrare la verifica nei loro sistemi in modo che i risultati siano valutati automaticamente prima di raggiungere gli utenti. Il processo diventa incorporato all'interno dei flussi di lavoro piuttosto che aggiunto come uno strato visibile.

Storicamente, l'infrastruttura che svanisce sullo sfondo tende a durare.

I server cloud, i protocolli di instradamento di internet, i sistemi di regolamento dei pagamenti — pochi utenti ci pensano quotidianamente. Eppure, i sistemi moderni collasserebbero senza di essi.

Se la verifica dell'IA diventa standard, potrebbe seguire lo stesso schema. L'intelligenza sembrerebbe semplicemente più affidabile. Lo strato di verifica opererebbe sotto la superficie.

Invisibile, ma essenziale.

Dalla curiosità alla responsabilità

L'adozione precoce dell'IA era guidata dall'esplorazione. Le persone volevano vedere cosa potevano generare le macchine. Creatività e novità dominavano la narrazione.

Ora la conversazione si sta evolvendo.

Man mano che le istituzioni integrano l'IA nelle operazioni, l'affidabilità diventa non negoziabile. La fabbricazione occasionale non è sostenibile in ambienti ad alta posta in gioco. I modelli hanno bisogno di auditabilità. I risultati hanno bisogno di tracciabilità.

Le organizzazioni chiederanno sempre di più non solo quale risposta è stata prodotta, ma perché dovrebbe essere considerata affidabile.

Mira si posiziona precisamente a quel incrocio.

Piuttosto che competere con i sistemi di IA esistenti, li completa. Modelli multipli, piattaforme o agenti autonomi potrebbero condividere una rete di verifica comune invece di costruire framework di fiducia isolati.

In questo senso, Mira riguarda meno la sostituzione dell'intelligenza e più la sua stabilizzazione.

Le parti difficili

La verifica sembra semplice quando si tratta di affermazioni fattuali chiare. Diventa più complessa quando si affrontano catene di ragionamento, interpretazioni o analisi soggettive.

I meccanismi di consenso dimostrati efficaci per le transazioni finanziarie potrebbero comportarsi in modo diverso quando applicati alla convalida della conoscenza. Determinare la verità in ambienti dinamici e sensibili al contesto è intrinsecamente più difficile che confermare un hash di transazione.

L'adozione presenta un'altra sfida. Gli sviluppatori devono considerare la verifica non come attrito, ma come infrastruttura necessaria. Se percepita come una complessità aggiunta senza beneficio immediato, l'integrazione potrebbe ritardare.

Tuttavia, i cambiamenti tecnologici spesso dipendono precisamente da queste transizioni quando le misure di sicurezza opzionali diventano standard attesi.

Il collo di bottiglia emergente

Man mano che l'IA diventa più integrata nei sistemi quotidiani, la fiducia potrebbe definire la prossima fase della sua evoluzione.

Maggiore velocità non significa automaticamente maggiore affidabilità. In effetti, accelerare la generazione di output può amplificare l'incertezza. Maggiore è il volume di contenuti generati dalle macchine, più difficile diventa separare conclusioni robuste da errori plausibili.

In quel panorama, uno strato di verifica smette di sembrare una caratteristica di lusso.

Inizia a sembrare come un'architettura mancante.

Un tipo diverso di progresso

Se la tesi di Mira si dimostra corretta, il prossimo grande salto nell'IA potrebbe non derivare dalla scalabilità dei parametri o dall'addestramento di modelli più grandi.

Potrebbe derivare dal rafforzare l'affidabilità.

Probabilmente non ci sarà una pietra miliare drammatica che segna quella transizione. Nessun singolo momento di svolta che catturi i titoli. Invece, gli strumenti di IA potrebbero gradualmente sembrare più sicuri. L'automazione potrebbe sembrare meno rischiosa. Le decisioni supportate dall'intelligenza delle macchine potrebbero richiedere meno ripensamenti.

E la maggior parte degli utenti potrebbe non notare mai perché.

L'evoluzione tecnologica spesso rafforza strati invisibili piuttosto che mettere in mostra rivoluzioni visibili.

Se l'IA definisce quest'era, allora la verifica — non solo la generazione — potrebbe definire la sua stabilità. Il Mira Protocol sta essenzialmente scommettendo che la fiducia diventerà l'infrastruttura centrale dell'intelligenza.

Se quella scommessa avrà successo dipende dall'adozione, dall'esecuzione e dal fatto che l'ecosistema più ampio riconosca che sistemi più intelligenti da soli non sono sufficienti.

Perché a lungo termine, la capacità attira attenzione.

Ma l'affidabilità sostiene i sistemi.

#Mira @Mira - Trust Layer of AI $MIRA