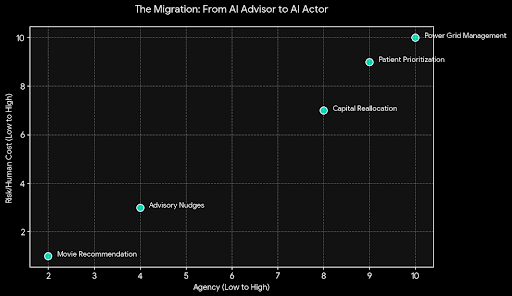

La IA solía quedarse sentada educadamente en el fondo, ofreciendo sugerencias y empujones. Ahora da un paso adelante, toma decisiones y, en algunos sistemas, firma el cheque. Esa migración de asesor a actor es urgente, emocionante y silenciosamente aterradora.

Cuando un algoritmo recomienda una película, una elección incorrecta es solo una molestia. Cuando reasigna capital, prioriza a un paciente o redirige energía, un solo error puede tener repercusiones reales con costos humanos. El problema no es la inteligencia como tal, sino la acción sin responsabilidad verificable.

Las alucinaciones, el desvío del modelo y los trucos adversariales ya no son errores teóricos; son vectores de daño. Una afirmación que suena confiada de un modelo puede traducirse directamente en una transacción, un descargo o un cambio de política si las salidas del sistema se les da agencia. Sin una forma de probar lo que realmente ocurrió, “la IA lo dijo” se convierte en un sustituto peligroso para la auditoría y la supervisión.

Por eso es importante verificar acciones, no solo resultados. No es suficiente inspeccionar lo que un sistema produjo en papel. Debemos verificar los cambios de estado: ¿se completó el comercio?, ¿se llenó la receta?, ¿se ajustó la red? Atestaciones verificables y evidentes de manipulaciones convierten reclamos en evidencia y narrativas en auditabilidad.

Las redes abiertas magnifican el problema de verificación. Cuando muchos agentes pueden presentar reclamos, las atestaciones de bajo costo invitan al spam, al juego y a la falsa confianza. Una capa de verificación que sea gratuita para todos se ahogará en ruido y será manipulada por aquellos que se benefician del engaño.

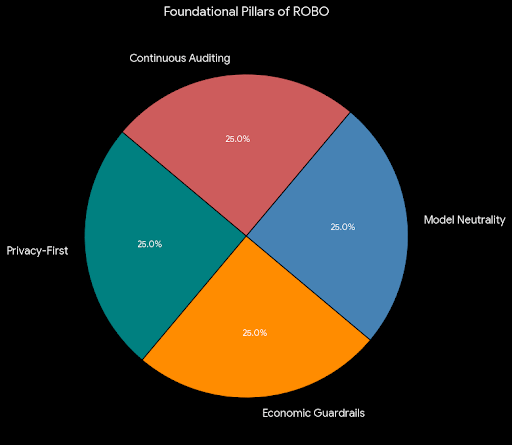

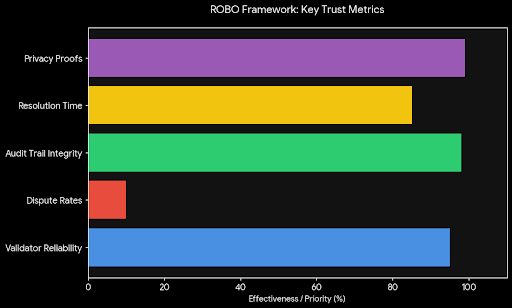

ROBO responde esto con salvaguardias económicas y reputacionales. Los validadores apuestan recursos, ganan recompensas por atestaciones honestas y enfrentan penalizaciones por fraude. Cuando la verificación cuesta algo real: dinero, reputación u oportunidad, el sistema desalienta reclamos frívolos y recompensa la precisión.

La privacidad debe estar integrada en cualquier esquema de responsabilidad. La atención médica y las finanzas están llenas de secretos que no pueden ser revelados por el bien de la verificación. Pruebas criptográficas que confirman condiciones sin exponer datos subyacentes nos permiten verificar sin vigilar. Puedes probar que se cumplió un umbral sin revelar todo el registro; puedes confirmar el cumplimiento sin publicar estrategias propietarias.

La neutralidad es otra piedra angular. Una capa de verificación que favorece a un solo proveedor o arquitectura simplemente recrea los riesgos de concentración que esperábamos que la descentralización evitaría. La verificación de reclamos agnóstica al modelo y reutilizable hace que las atestaciones sean portátiles y composables. La confianza viaja con la prueba, no con el proveedor, y los sistemas interoperen en lugar de bloquearse entre sí.

La verificación no es un evento; es una práctica. Los sistemas autónomos aprenden, actualizan y cambian su comportamiento. La verificación debe ser continua: atestaciones en tiempo real, auditorías en curso y métricas de confianza en vivo en lugar de sellos de un solo punto. Esa visibilidad continua hace surgir desviaciones, revela patrones y hace que la confianza sea medible.

Las métricas de confianza claras cambian cómo se comportan las organizaciones. En lugar de reclamos de marketing sobre “precisión probada”, los equipos muestran historias: fiabilidad de los validadores, tasas de disputa, trazas de auditoría y tiempos de resolución. Estas métricas hacen que la responsabilidad sea auditable y crean incentivos para mejorar la fiabilidad a largo plazo en lugar de la apariencia a corto plazo.

La defensa nunca es estática. A medida que los actores malintencionados inventan nuevas formas de engañar, la verificación debe evolucionar en consecuencia. Reglas adaptativas, estándares impulsados por la comunidad y supervisión en capas, desde verificaciones criptográficas hasta revisiones humanas cuando sea apropiado, hacen que la manipulación sea más difícil y la detección más rápida.

La verificación descentralizada también eleva la barra para la desinformación. En un mundo donde el contenido sintético y los deepfakes son comunes, las atestaciones criptográficas actúan como anclas de procedencia. Cuando un registro es atestado, lleva un contexto verificable; cuando no lo es, el escepticismo está justificado. Esa binariedad de demostrable versus no probado restaura una medida de higiene epistémica.

Poner pruebas verificables en el centro de la autonomía no significa rendirse a la velocidad o la innovación. Significa incorporar la responsabilidad en los canales donde los agentes transaccionan. Las máquinas aún pueden negociar, optimizar y actuar; solo que muestran sus recibos después de una manera que otros agentes y humanos pueden validar.

Esto cambia los incentivos en todo el ecosistema. Los proveedores que producen resultados verificables y auditables ganan confianza. Los reguladores y auditores obtienen registros objetivos. Los usuarios e instituciones pueden elegir agentes basándose en la fiabilidad demostrada en lugar de la publicidad. La responsabilidad se convierte en una señal de mercado, no solo en una casilla de cumplimiento.

El cambio más importante es cultural. Pasamos de tratar a la IA como un oráculo cuyas proclamaciones son aceptadas por fe, a tratar a la IA como un actor cuyos actos deben ser verificables. Ese cambio reformula las conversaciones sobre autonomía: de “¿Puede el modelo hacerlo?” a “¿Puede el modelo probar que lo hizo?”

El enfoque agnóstico al modelo, primero en privacidad y alineado económicamente de ROBO establece las bases para esa transición cultural. Protege datos sensibles, resiste el spam y el abuso, y hace que la confianza sea medible y portátil. No garantiza perfección, pero construye un sistema donde los fracasos son visibles, responsables y aprendibles.

Al final, la pregunta que tenemos ante nosotros es simple y contundente. ¿Dejamos que los sistemas autónomos actúen en nuestro nombre sin recibos, o exigimos pruebas y construimos una infraestructura que insiste en ello? La elección determina si la IA se convierte en un peligro no responsable o en una base confiable.

Debemos elegir la responsabilidad demostrable. Cuando las máquinas pueden mostrar, de maneras criptográficas y auditables, lo que hicieron y por qué, la confianza deja de ser un salto de fe y se convierte en una métrica que podemos gestionar. Así es como pasamos de la dependencia ciega a la autonomía responsable, y cómo aseguramos que los sistemas poderosos sirvan a las personas en lugar de sorprenderlas.

\u003cm-78/\u003e\u003cc-79/\u003e \u003ct-81/\u003e