Es gibt einen zutiefst menschlichen Moment, der in der Stille passiert, einen Moment, in dem eine künstliche Intelligenz eine Antwort liefert, die makellos, poliert und absolut klingt, doch etwas im Inneren des Zuhörers zieht sich unbehaglich zusammen, denn alleinige Zuversicht bedeutet nicht Wahrheit und der Instinkt weiß das. Dieses stille Unbehagen entsteht nicht aus Unkenntnis, sondern aus Erfahrung, aus dem Verständnis, dass ein einzelner falscher Satz Entscheidungen fehlleiten, Überzeugungen formen oder stillschweigend Leben schädigen kann, und genau in diesem fragilen emotionalen Raum findet das Mira Network seine Bedeutung, nicht als ein weiteres technisches System, sondern als eine Antwort auf eine wachsende kollektive Angst, Maschinen zu vertrauen, die niemals zögern, selbst wenn sie falsch liegen.

Moderne künstliche Intelligenz verhält sich oft wie ein überzeugender Erzähler, der ohne Zweifel spricht, genaue Einsichten und erfundene Details so nahtlos verbindet, dass selbst Experten Schwierigkeiten haben können zu erkennen, wo die Wahrheit endet und die Annahme beginnt, und während dies in der informellen Nutzung harmlos erscheinen mag, wird es tief beunruhigend, wenn KI beginnt, Medizin, Recht, Finanzen, Governance und persönliche Entscheidungen zu beeinflussen. Die Angst ist nicht, dass KI mächtig ist, sondern dass sie mächtig ist, ohne Verantwortung zu tragen, in der Lage, überzeugende Fehlinformationen zu produzieren, ohne das Gewicht ihrer eigenen Worte zu erkennen. Mira beginnt, indem sie diese unangenehme Realität akzeptiert, sich entscheidet, die Illusion eines perfekten Modells nicht zu verfolgen, sondern stattdessen einen viel ehrlicheren Ansatz zu verfolgen: Wahrheit sollte niemals von einer einzigen Stimme abhängen, egal wie intelligent diese Stimme erscheint.

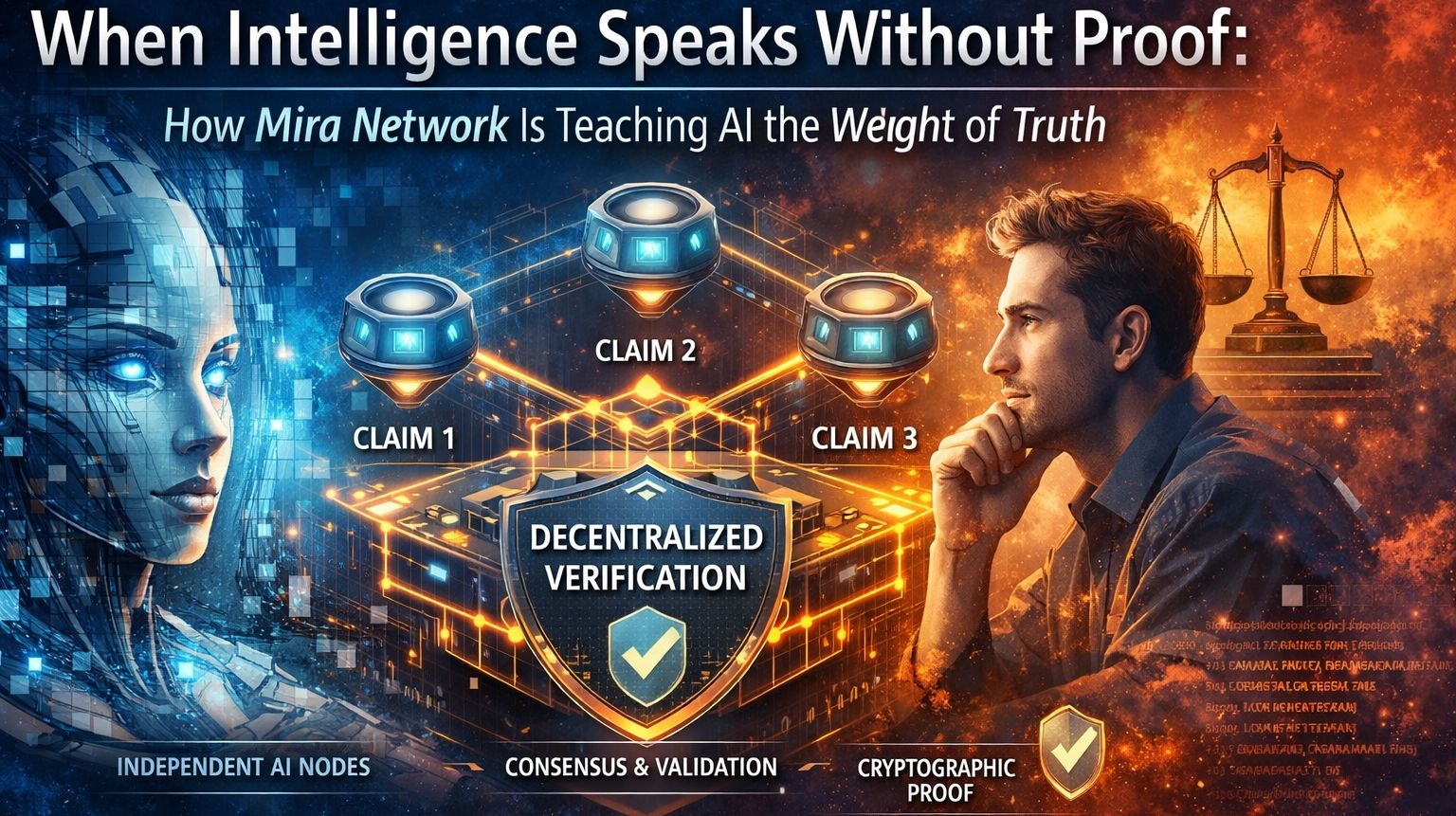

Wenn Informationen durch Mira fließen, werden sie nicht für bare Münze genommen oder als endgültig behandelt; sie werden sorgfältig entpackt, in einzelne Ansprüche zerlegt, die untersucht, hinterfragt und angefochten werden können, genau wie es ein sorgfältiger Mensch tun würde, wenn etwas wirklich wichtig ist. Jeder Anspruch wird dann in ein dezentrales Netzwerk von unabhängigen KI-Verifizierern freigegeben, die alle unterschiedlich aufgebaut, unterschiedlich trainiert und incentiviert sind, kritisch zu denken, anstatt blind zuzustimmen. In dieser Struktur steckt etwas zutiefst Menschliches, denn sie spiegelt wider, wie Vertrauen immer in der Gesellschaft gebildet wurde, durch multiple Perspektiven, geteilte Verantwortung und die stille Beruhigung, dass die Wahrheit stärker ist, wenn sie die Prüfung übersteht.

Was aus diesem Prozess hervorgeht, ist keine hastige Gewissheit, sondern erlangtes Vertrauen, denn eine Einigung wird nur erreicht, wenn eine starke Mehrheit unabhängig zu demselben Schluss kommt, und diese Einigung wird mit kryptografischem Beweis besiegelt, der nicht stillschweigend geändert oder verborgen werden kann. Ebenso wichtig ist, dass, wenn kein Konsens erreicht werden kann, Unsicherheit nicht mit geschliffener Sprache oder künstlichem Vertrauen maskiert wird; Zweifel werden offen gelegt, sodass die Menschen sehen können, wo Wissen endet und Mehrdeutigkeit beginnt. In einer digitalen Welt, die süchtig nach sofortigen Antworten ist, fühlt sich diese Weigerung zu tun, als ob es fast radikal ist, weil es das menschliche Recht respektiert, nicht nur zu wissen, was wahr ist, sondern auch, was noch unbekannt ist.

Unter dieser Verifizierungsschicht liegt ein Wirtschaftssystem, das Integrität auf subtile, aber kraftvolle Weise verstärkt, diejenigen belohnt, die ehrlich verifizieren, und diejenigen bestraft, die versuchen, Ergebnisse zu manipulieren, und sicherstellt, dass die Wahrheit nicht nur durch Ideale geschützt wird, sondern durch greifbare Konsequenzen. Diese Ausrichtung der Anreize verwandelt die Verifizierung von einem theoretischen Ziel in eine gelebte Verantwortung, wo Genauigkeit wertvoll wird und Unehrlichkeit kostspielig wird, was eine einfache menschliche Wahrheit widerspiegelt, dass Verhalten Verantwortung folgt.

Was letztendlich diesen Ansatz anders erscheinen lässt, ist der emotionale Wandel, den er zwischen Menschen und Maschinen schafft, weil er die Benutzer nicht auffordert, ihr Urteil aufzugeben oder blindes Vertrauen in die Technologie zu setzen, sondern stattdessen eine Partnerschaft anbietet, die auf Transparenz und Beweis basiert. Es stellt ein Gefühl von Würde in der Interaktion mit KI wieder her, ersetzt unbehagliche Abhängigkeit durch vorsichtigen Vertrauen und ersetzt stilles Zweifeln durch sichtbare Verifizierung. Wenn künstliche Intelligenz näher zur Autonomie und tiefer ins menschliche Leben vordringt, wird die Kosten für Fehler mit jedem Schritt schwerer, und diese Vision steht als Erinnerung, dass Fortschritt ohne Vertrauen hohl ist, dass Intelligenz ohne Verifizierung zerbrechlich ist und dass die Zukunft, die wir mit Maschinen aufbauen, immer noch das menschliche Bedürfnis nach Wahrheit, Verantwortung und Beruhigung ehren muss.