Warum unabhängige KI-Verifizierung während Krieg und Krise entscheidend wird

Große Sprachmodelle werden auf umfangreichen Datenpools aus dem Internet trainiert. Diese Daten sind nicht neutral. Sie spiegeln das politische, kulturelle und institutionelle Gewicht der Regionen wider, die den größten Teil des Inhalts produzieren. Wenn ein dominanter Anteil des Trainingsmaterials aus einem bestimmten Land oder Medienökosystem stammt, können Muster der Rahmung, Terminologie und narrative Voreingenommenheit im Modell verankert werden.

Das erfordert nicht böswillige Absicht. Es ist strukturell. Modelle lernen statistische Beziehungen. Wenn bestimmte Standpunkte häufiger wiederholt werden, erhalten diese Standpunkte probabilistische Priorität in den Antworten.

In stabilen Zeiten mag dies als subtile kulturelle Neigung erscheinen. Während des Krieges oder geopolitischer Krisen wird es viel ernster.

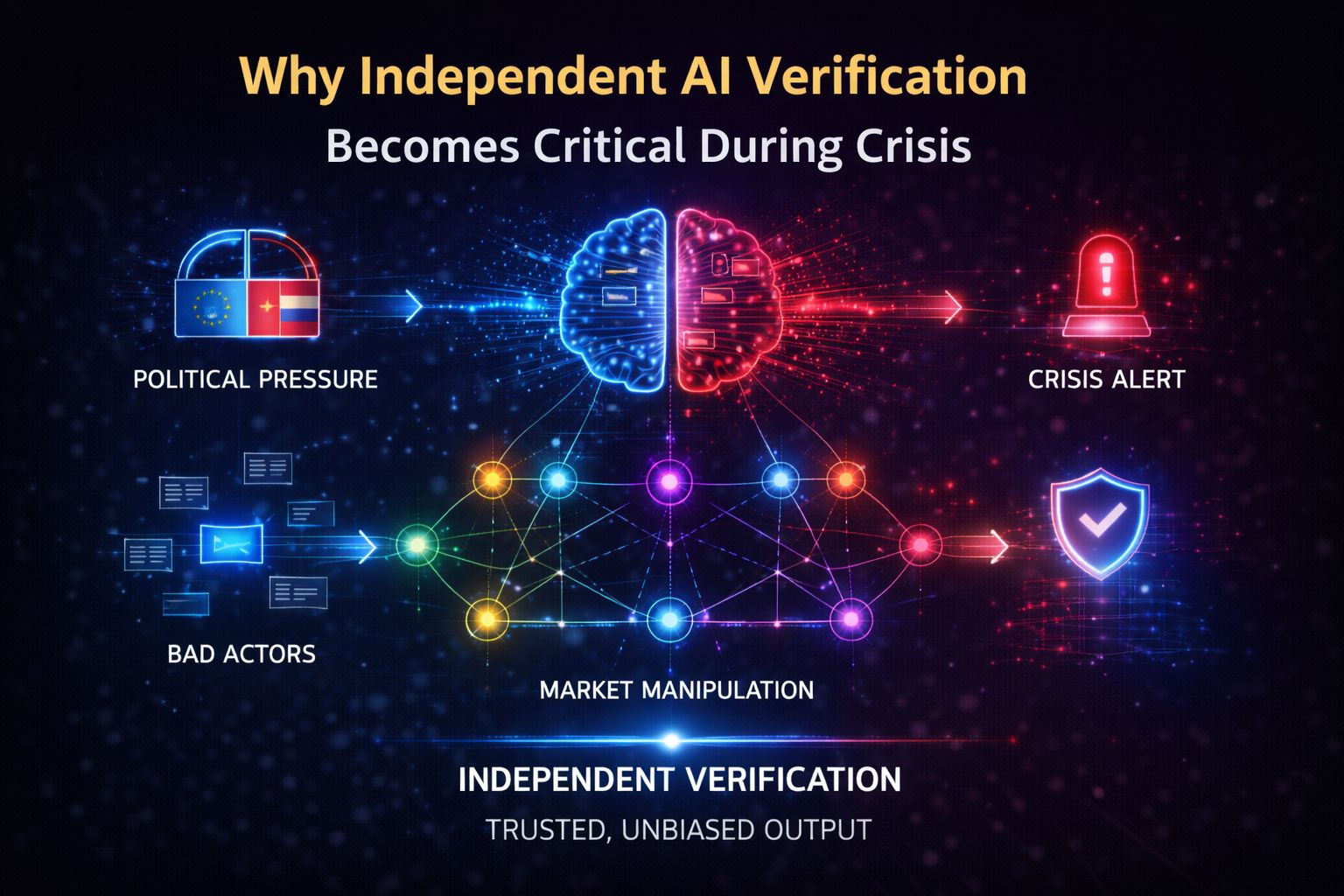

Informationen werden zu einem strategischen Gut. Erzählungen formen Märkte, öffentliche Meinungen und sogar die Wahrnehmung auf dem Schlachtfeld. Wenn KI-Systeme, die von Händlern, Journalisten, Analysten oder politischen Entscheidungsträgern verwendet werden, eine konzentrierte regionale Voreingenommenheit widerspiegeln, skaliert die Konsequenz schnell. Finanzmärkte können auf verzerrte Zusammenfassungen reagieren. Risikobewertungen können narrative Ungleichgewichte erben. Autonome Systeme könnten auf unvollständiger oder gerahmter Intelligenz basieren.

Die Gefahr besteht nicht darin, dass KI absichtlich Propaganda verbreitet. Die Gefahr besteht darin, dass sie unbeabsichtigt dominante Erzählungen aufgrund der Trainingsverteilung und Verstärkungsmechanismen verstärken kann.

Unabhängige Faktenvalidierung wird unter diesen Bedingungen unerlässlich.

Hier wird die dezentrale Verifizierungsarchitektur relevant. Anstatt einem einzelnen Modell zu vertrauen, das unter einer institutionellen Linse trainiert wurde, können Ausgaben in diskrete faktische Ansprüche zerlegt werden. Jeder Anspruch kann dann unabhängig von verschiedenen Verifier-Knoten bewertet werden, die mit wirtschaftlichen Anreizen arbeiten, die auf Genauigkeit und nicht auf narrative Loyalität ausgerichtet sind.

@Mira - Trust Layer of AI genau diese Art von Struktur.

Anstatt anzunehmen, dass ein einzelnes Modell seine eigene Voreingenommenheit beseitigen kann, $MIRA führt ein System ein, in dem mehrere Modelle an der Konsensvalidierung teilnehmen. Validatoren setzen Werte ein, um teilzunehmen, und schaffen Verantwortung. Wenn sie konsequent in einer Weise divergieren, die auf nachlässige oder unehrliche Verifizierung hindeutet, riskieren sie wirtschaftliche Strafen.

Vielfalt spielt eine Schlüsselrolle. Ein dezentrales Netzwerk fördert heterogene Modellarchitekturen, vielfältige Trainingskorpora und geografisch verteilte Betreiber. Im Laufe der Zeit verringert dies die Wahrscheinlichkeit, dass eine einzige dominante Perspektive das Ergebnis kontrolliert.

Ein weiterer kritischer Faktor während einer Krise ist die Privatsphäre. Sensible Dokumente, Geheimdienstzusammenfassungen oder Finanzanalysen dürfen nicht breit veröffentlicht werden. Miras Ansatz, Inhalte in granulare Ansprüche zu zerlegen und sie über Knoten zu verteilen, bedeutet, dass kein einzelner Validator das gesamte Dokument rekonstruieren kann, wodurch Vertraulichkeit geschützt und die Integrität der Verifizierung gewahrt bleibt.

In Kriegszeiten oder in geopolitischen Spannungen wird neutrale Information zur Infrastruktur. Märkte sind darauf angewiesen. Institutionen sind darauf angewiesen. Bürger sind darauf angewiesen.

KI wird zunehmend in Forschungspipelines, Handelsbot-Systeme und automatisierte Entscheidungsflüsse und Workflows integriert. Mit der zunehmenden Abhängigkeit steigt auch der Bedarf an überprüfbarer Neutralität.

Unabhängige Faktenvalidierung ist nicht mehr optional. Sie wird zu einem Stabilitätsmechanismus.

$MIRA und das #Mira Verifizierungsframework zielen darauf ab, eine Anreiz-angepasste Vertrauensschicht zu schaffen, die strukturelle Voreingenommenheit verringert und das Vertrauen in KI-Ausgaben erhöht, wenn Genauigkeit am wichtigsten ist.