Mira Network macht mehr Sinn, wenn Sie aufhören, über schnellere Modelle nachzudenken und anfangen, über Verifizierung nachzudenken. Nach dem Durchlesen ihrer Dokumentation und dem Verfolgen von Updates von @Mira - Trust Layer of AI , fällt auf, dass es nicht ein weiterer Versuch ist, ein besseres KI-Modell zu bauen, sondern ein Versuch, die bereits existierenden zu überprüfen.

Das Kernproblem ist einfach. KI-Systeme generieren Texte, Code, Analysen, sogar finanzielle Einblicke. Aber sie halluzinieren auch. Sie mischen Fakten mit überzeugenden Fehlern. Sie spiegeln verborgene Vorurteile in den Trainingsdaten wider. Heute erfolgt die meisten Validierungen innerhalb zentralisierter Plattformen. Ein Unternehmen baut das Modell, bewertet es intern und entscheidet, was zuverlässig ist. Das funktioniert bis zu einem gewissen Punkt, aber es schafft einen einzigen Punkt der Beurteilung. Wenn diese Validierungsschicht fehlerhaft ist, skaliert der Fehler mit dem Modell.

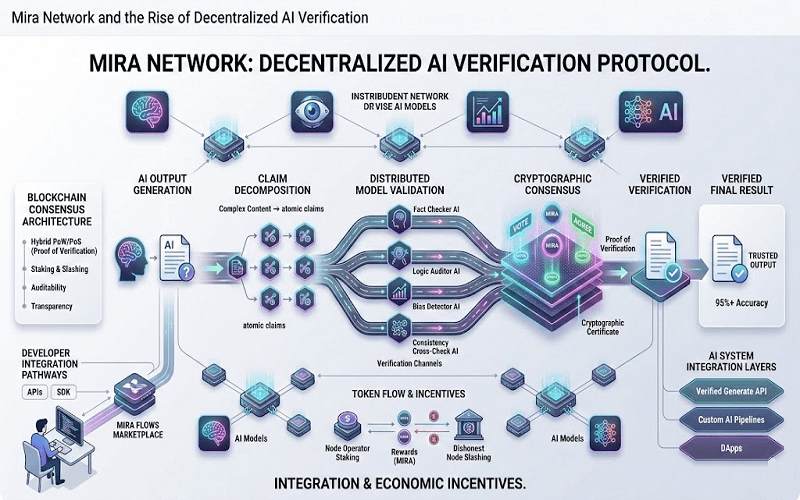

#Mira geht dies anders an. Anstatt einer Autorität zu vertrauen, die entscheidet, ob eine KI-Ausgabe korrekt ist, schlägt es eine dezentrale Überprüfungsschicht vor. Der interessante Teil ist, wie dies geschieht. KI-Ausgaben werden in kleinere, testbare Ansprüche zerlegt. Jeder Anspruch kann dann unabhängig von mehreren KI-Modellen bewertet werden, die nicht vom selben Betreiber kontrolliert werden. Denk daran wie an ein Netzwerk von Faktenprüfern, die nicht für dieselbe Nachrichtenredaktion arbeiten.

Wenn mehrere unabhängige Modelle einem Anspruch zustimmen, steigt das Vertrauen. Wenn sie nicht übereinstimmen, wird diese Meinungsverschiedenheit sichtbar und messbar. Das endgültige Ergebnis ist keine blinde Akzeptanz, sondern ein strukturierter Vertrauensscore, der in der Validierung über Modelle hinweg verankert ist.

Hier wird Blockchain praktisch, statt symbolisch. Mira Network zeichnet Überprüfungsergebnisse on-chain auf, verwendet Konsens und kryptografische Beweise, um sicherzustellen, dass der Validierungsprozess selbst nicht stillschweigend geändert werden kann. Anstatt zu sagen: 'Vertraue uns, wir haben es getestet', macht das System die Überprüfung transparent und manipulationssicher. Die Blockchain-Schicht fungiert wie ein öffentliches Prüfprotokoll für Entscheidungen zur KI-Zuverlässigkeit.

Der Token $MIRA spielt eine Rolle bei der Ausrichtung der Anreize. Validatoren werden für ehrliche Überprüfungsarbeiten belohnt und für Manipulation bestraft. Theoretisch schafft dies eine wirtschaftliche Struktur, die Genauigkeit über Geschwindigkeit fördert. In zentralisierten Systemen gewinnt oft die Geschwindigkeit, da das Nutzerwachstum wichtiger ist als Präzision. Hier versucht das Design, sorgfältige Validierung wirtschaftlich rational zu gestalten.

Was ich an Mira Network bodenständiger finde, ist, dass es nicht verspricht, Halluzinationen zu beseitigen. Es erkennt an, dass große Sprachmodelle weiterhin Fehler machen werden. Das Ziel ist es, blindes Vertrauen in Ausgaben von Einzelmodellen zu reduzieren. In praktischen Begriffen könnte das in Bereichen wie KI-unterstützter Forschung, Finanzberichterstattung oder automatisierten Compliance-Prüfungen von Bedeutung sein, wo kleine Ungenauigkeiten sich zu größeren Risiken summieren können.

Zur gleichen Zeit ist der Ansatz nicht leichtgewichtig. Ausgaben in strukturierte Ansprüche aufzuteilen, sie über mehrere Modelle laufen zu lassen und die Ergebnisse on-chain aufzuzeichnen, erfordert Berechnungen. Das führt zu Kosten und Latenz. Es gibt auch Koordinationskomplexität. Unabhängige Validatoren benötigen standardisierte Bewertungsmethoden, und Anreize müssen sorgfältig austariert werden, um Kollusion zu verhindern. Der breitere dezentralisierte KI-Infrastrukturraum wird ebenfalls wettbewerbsfähig, sodass Mira nicht isoliert operiert.

Trotzdem fühlt sich die Hauptidee hinter #MiraNetwork bodenständig an: Behandle KI-Ausgaben als Hypothesen anstatt als Schlussfolgerungen und verifiziere sie durch verteilten Konsens statt zentraler Autorität. Es reframed die Zuverlässigkeit von KI als ein Koordinationsproblem statt eines Modells Trainingsproblems.

Ob dieses Modell effizient skalierbar ist, bleibt eine offene Frage. Aber während KI-Systeme zunehmend in die tägliche Entscheidungsfindung eingebettet werden, beginnt eine separate Überprüfungsschicht weniger optional und notwendiger zu erscheinen.